Estrategias de Control de Acceso en Sistemas GenAI y LLM

A medida que la Inteligencia Artificial Generativa y los Modelos de Lenguaje Extenso (LLMs) se vuelven parte integral de las operaciones empresariales, asegurar el acceso a sus datos subyacentes ya no es opcional. Estos sistemas ingieren, procesan y generan conocimientos basados en conjuntos de datos de alto valor, que a menudo incluyen información personal, propietaria o regulada. Sin un control de acceso efectivo, las organizaciones se arriesgan a fugas de datos, violaciones de cumplimiento y contaminación de modelos aguas abajo.

Desafíos del Control de Acceso en GenAI

A diferencia de las bases de datos tradicionales, los sistemas GenAI operan con datos no estructurados y semiestructurados, lo que hace que los controles basados en perímetros sean insuficientes. Una sola solicitud puede desencadenar múltiples capas de búsquedas vectoriales, generación aumentada por recuperación (RAG) y resúmenes. El acceso debe ser gobernado en cada etapa: ingesta de la solicitud, consulta en el almacén vectorial, procesamiento del modelo y salida del resultado. Esta complejidad exige estrategias de seguridad granulares y adaptativas.

La necesidad de controles en múltiples capas en cargas de trabajo de IA se refleja en recursos como el Marco de IA Seguro (SAIF) de Google y el Marco de Gestión de Riesgos de IA del NIST, que recomiendan la transparencia, gobernanza y trazabilidad como principios fundamentales.

Controles de Acceso Dinámicos con Auditoría en Tiempo Real

Los sistemas modernos de IA se benefician del monitoreo en tiempo real de la actividad de la base de datos, permitiendo a las organizaciones detectar y bloquear consultas no autorizadas en cuanto ocurren. La auditoría en tiempo real no sólo registra cada interacción, sino que también habilita alertas basadas en el comportamiento y la aplicación de políticas. Por ejemplo, si un usuario consulta inesperadamente registros de alta sensibilidad o utiliza una estructura de entrada inusual, el sistema puede suspender la ejecución o enmascarar automáticamente las salidas.

-- Ejemplo de regla de auditoría impulsada por políticas en PostgreSQL con pgAudit

ALTER SYSTEM SET pgaudit.log = 'all';

-- En combinación con el registro del almacén vectorial:

INSERT INTO audit_logs (timestamp, user_id, action, query)

VALUES (NOW(), current_user, 'embedding_lookup', 'SELECT * FROM vector_index WHERE ...');

Los registros de auditoría pueden ser enviados a sistemas SIEM o integrarse con soluciones como las reglas de aprendizaje y funciones de alerta de DataSunrise para una defensa proactiva. Para aplicaciones LLM nativas en la nube, plataformas como Azure Monitor y Amazon CloudWatch también soportan la inspección y remediación en tiempo real.

Enmascaramiento Dinámico de Datos para la Protección de Entradas y Salidas

Un método efectivo para proteger el contenido sensible tanto en entradas como en salidas es el enmascaramiento dinámico de datos. Por ejemplo, cuando una solicitud incluye identificadores personales o registros financieros, el enmascaramiento asegura que los LLMs puedan realizar tareas relevantes (como clasificación o resumen) sin exponer los datos en crudo a los usuarios o incluso al modelo en forma legible.

-- Regla pseudo para enmascarar el número de tarjeta de crédito antes de alimentarlo al modelo

IF query CONTAINS 'credit_card_number' THEN

MASK 'credit_card_number' USING 'XXXX-XXXX-XXXX-####';

END IF;

Este enfoque permite que los LLMs mantengan su funcionalidad mientras se minimiza la exposición, siendo especialmente útil en flujos de trabajo de servicio al cliente, recursos humanos y documentos legales. Proyectos de código abierto como Presidio de Microsoft demuestran cómo el enmascaramiento y la anonimización pueden integrarse en los procesos de PLN.

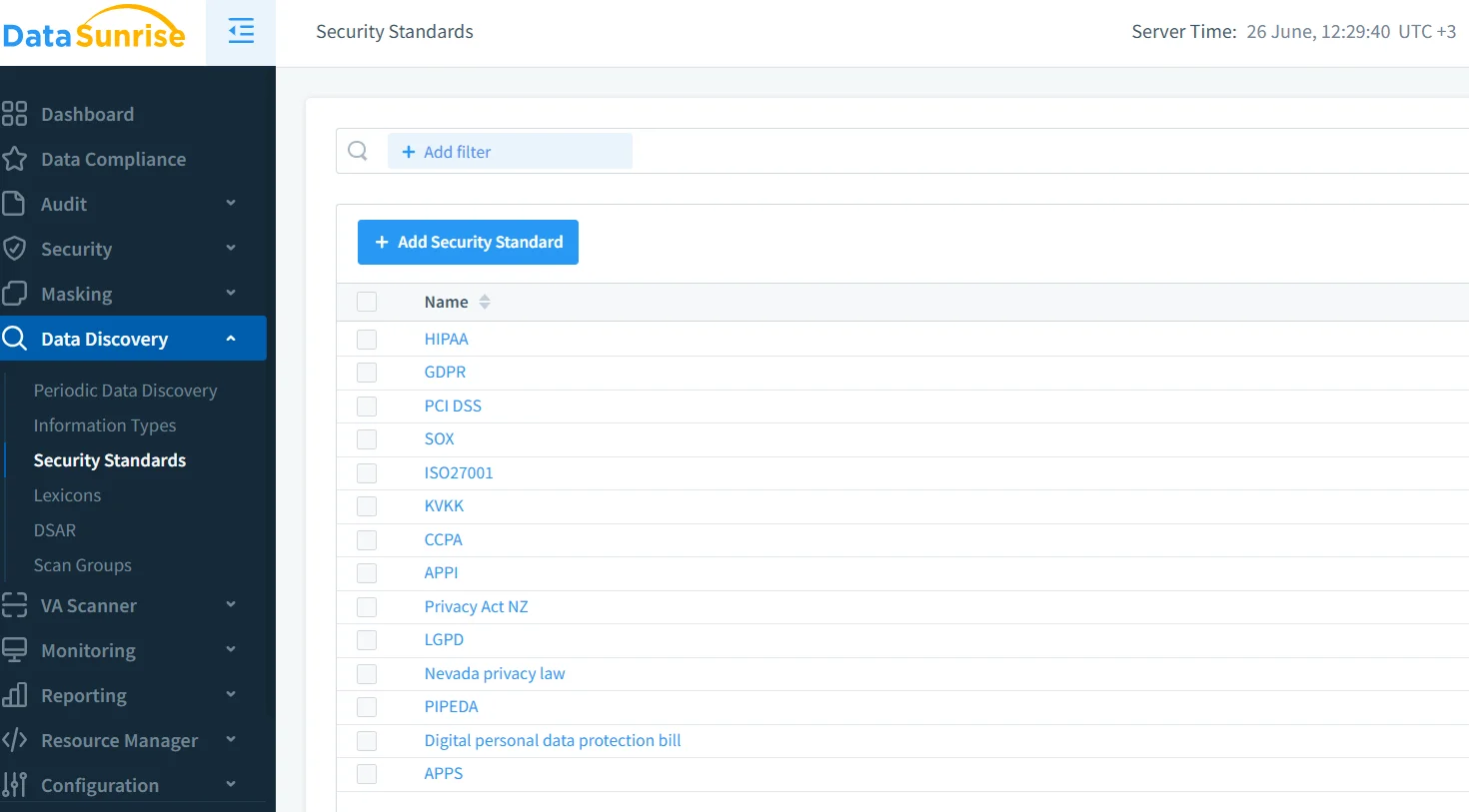

Descubrimiento de Datos para Clasificar y Gobernar Fuentes de Entrada

El control de acceso comienza con la visibilidad. Las herramientas de descubrimiento de datos pueden escanear automáticamente bases de datos, almacenes de objetos y repositorios de documentos para clasificar campos sensibles antes de que lleguen al modelo. Esto incluye PII, PHI, datos financieros, código fuente o propiedad intelectual.

Cuando se combina con pipelines de IA, los activos descubiertos pueden ser etiquetados, segmentados o dirigidos a través de diferentes flujos de procesamiento según su clasificación. Esto asegura que los documentos no sensibles se manejen con mayor libertad, mientras que el contenido de alto riesgo active políticas más estrictas. Principios similares se describen en el Manual de Gobernanza de IA de IBM para gestionar datos estructurados y no estructurados en industrias reguladas.

Alineación con el Cumplimiento y Aplicación de Políticas

Regulaciones como GDPR, HIPAA y PCI DSS imponen reglas específicas sobre el acceso, retención y manejo de datos. Para los sistemas de IA, estos requisitos se extienden a conjuntos de datos de entrenamiento, inferencias de modelos y registros. Los gestores de cumplimiento deben incorporar estos requisitos directamente en la lógica de control de acceso.

Por ejemplo, una plataforma LLM alineada con el GDPR podría:

- Redactar los identificadores de usuario de las solicitudes a menos que se otorgue un consentimiento explícito

- Expirar los registros de inferencias después de 30 días

- Restringir el uso del modelo por región o dominio legal

Utilizando herramientas automatizadas de cumplimiento, las organizaciones pueden imponer estas políticas a gran escala sin introducir sobrecarga operativa. Se dispone de más orientación en las recomendaciones de cumplimiento de IA del EDPB y en la guía del ICO sobre IA y protección de datos.

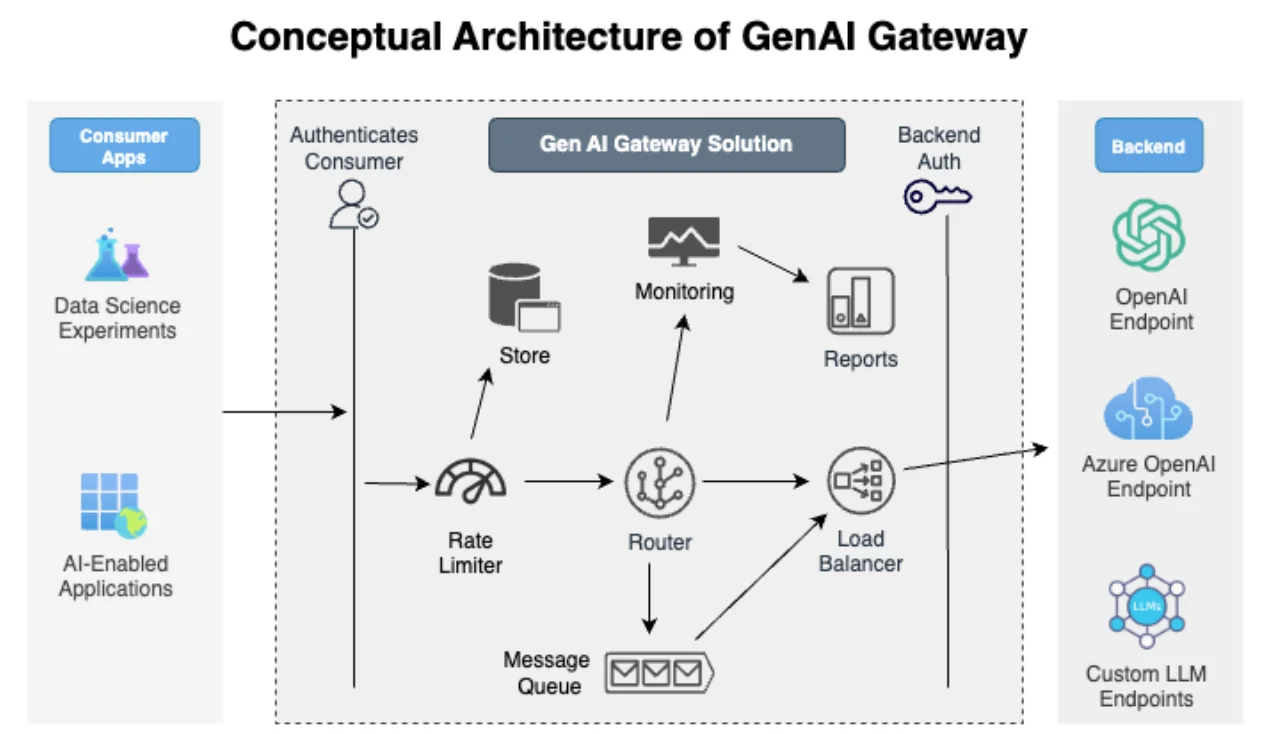

Arquitectura GenAI con Seguridad como Prioridad

Las estrategias de control de acceso efectivas no se añaden como una capa posterior, sino que se integran en la arquitectura del sistema. Esto incluye:

- Firewalls basados en proxy que inspeccionan las cargas útiles de las solicitudes

- Control de Acceso Basado en Roles (RBAC) que limita quién puede consultar qué modelos y conjuntos de datos

- Diseño de mínimos privilegios en claves API, ámbitos de acceso a modelos y uso de conjuntos de datos

Por ejemplo, los desarrolladores que trabajan en un modelo de chatbot pueden acceder únicamente a muestras de datos sintéticos o enmascarados, mientras que los oficiales de cumplimiento pueden ver los registros completos de auditoría, pero no el texto en crudo de la solicitud. Esto se alinea con las prácticas descritas en el Marco de Seguridad de IA de MITRE para proteger los sistemas de aprendizaje contra la inyección de solicitudes y el uso indebido del modelo.

Conclusión

Implementar robustas Estrategias de Control de Acceso en Sistemas GenAI y LLM requiere una combinación de descubrimiento, aplicación, monitoreo y gobernanza. Los registros de auditoría en tiempo real, el enmascaramiento dinámico de datos y las políticas impulsadas por la clasificación deben trabajar en armonía para proteger los datos tanto en tránsito como en reposo.

Soluciones como el motor de auditoría y enmascaramiento de DataSunrise proporcionan la flexibilidad e inteligencia necesarias para proteger los ecosistemas GenAI sin comprometer el rendimiento ni el cumplimiento. A medida que más empresas integran los LLMs en sus flujos de trabajo, la capacidad de adaptar dinámicamente los controles de acceso será clave tanto para la innovación como para la responsabilidad.

Más información está disponible en la guía de referencia de seguridad de LLM, en los principios básicos de seguridad de datos y en marcos como el mapa de conocimiento de OpenCRE sobre amenazas de IA.

Protege tus datos con DataSunrise

Protege tus datos en cada capa con DataSunrise. Detecta amenazas en tiempo real con Monitoreo de Actividad, Enmascaramiento de Datos y Firewall para Bases de Datos. Garantiza el Cumplimiento de Datos, descubre información sensible y protege cargas de trabajo en más de 50 integraciones de fuentes de datos compatibles en la nube, en instalaciones y sistemas de IA.

Empieza a proteger tus datos críticos hoy

Solicita una Demostración Descargar Ahora