Seguridad del Agente LLM en Escenarios RAG/RLHF

Los agentes de Modelos de Lenguaje a Gran Escala (LLM) están ganando terreno en los flujos de trabajo de Generación Aumentada por Recuperación (RAG) y Aprendizaje por Refuerzo a partir de Retroalimentación Humana (RLHF). Estos agentes inteligentes mejoran la comprensión del contexto, automatizan los flujos de datos y proporcionan respuestas adaptativas. Sin embargo, su integración en canalizaciones de datos sensibles introduce riesgos de seguridad y cumplimiento que deben gestionarse de manera proactiva.

Vulnerabilidades de seguridad introducidas por los agentes LLM

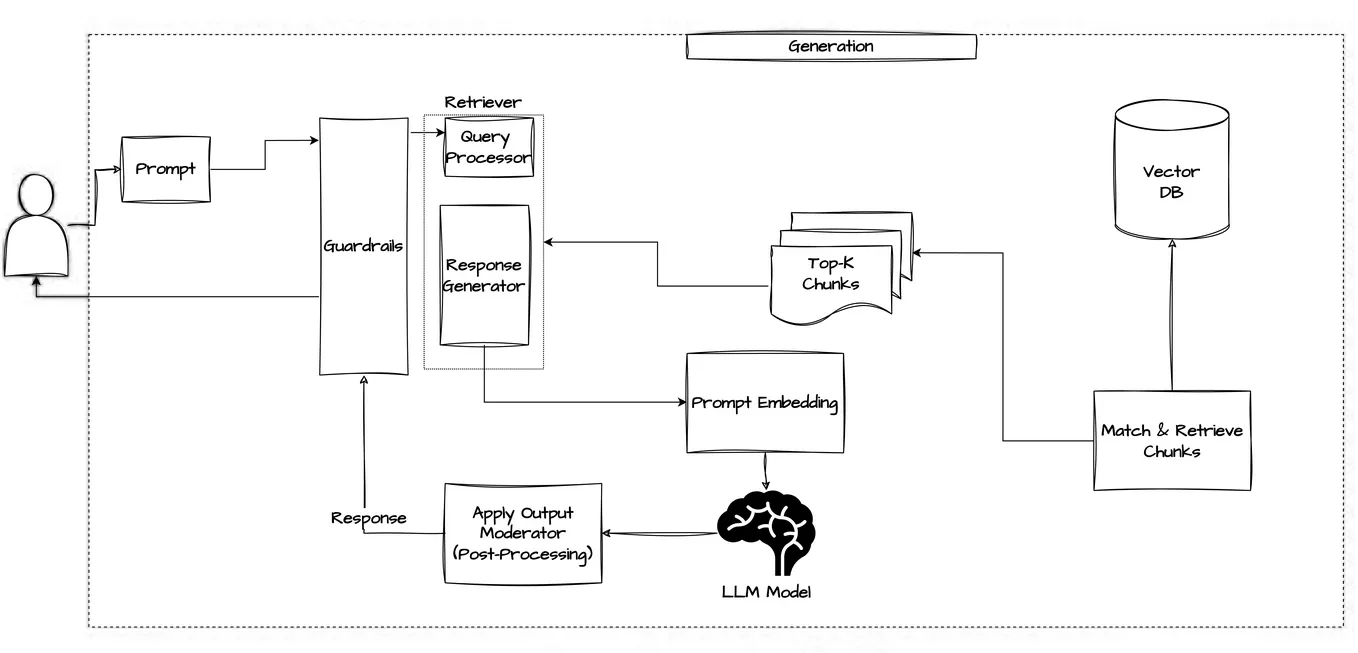

Los LLM a menudo operan sobre datos heterogéneos extraídos en tiempo real de repositorios internos y bases de conocimiento externas. En los flujos de trabajo RAG, los agentes consultan bases de datos vectoriales y añaden el contexto recuperado a las indicaciones. En las canalizaciones RLHF, interactúan con datos de entrenamiento etiquetados manualmente o con registros de retroalimentación. Esta amplia superficie de acceso abre riesgos de inyección de indicaciones, filtración de datos y replicación de comportamientos no controlados.

Sin controles adecuados, los agentes LLM pueden acceder y exponer datos empresariales sensibles, propagar retroalimentación manipulada o interactuar con conjuntos de datos que no cumplen con las normativas. Estos riesgos requieren un monitoreo continuo, enmascaramiento de datos y aplicación de políticas en los ciclos de inferencia y retroalimentación del LLM. Como se destaca en el diseño de sistemas de IA segura de Google, estos desafíos deben abordarse de manera proactiva desde la etapa de diseño.

Auditoría en tiempo real de las interacciones de LLM

Para rastrear cómo operan los agentes y qué datos tocan, la auditoría en tiempo real es esencial. Esto incluye el seguimiento del contenido de las consultas, las asociaciones entre usuario y agente, los resultados vectoriales recuperados, las estructuras de las indicaciones y las completaciones resultantes. Registrar estos metadatos ayuda a detectar comportamientos anómalos, reconstruir las cadenas de toma de decisiones y demostrar el cumplimiento con HIPAA, GDPR y PCI DSS.

Soluciones como la plataforma Data Audit de DataSunrise lo permiten mediante reglas de auditoría personalizables que monitorean la actividad de consultas estructuradas y no estructuradas. Las reglas de auditoría se pueden configurar para marcar palabras clave específicas, intentos de acceso o cargas vectoriales inyectadas en las indicaciones. De manera similar, Azure Monitor para LLM de Microsoft muestra cómo los eventos en tiempo de ejecución pueden registrarse y visualizarse a escala.

Enmascaramiento dinámico de datos para canalizaciones GenAI

El enmascaramiento dinámico de datos garantiza que campos sensibles como nombres, correos electrónicos o números de cuenta sean reemplazados en tiempo de ejecución antes de ser pasados al modelo. Esto es especialmente crucial en configuraciones RAG, donde un agente recupera datos que pueden incluir atributos confidenciales.

Con el enmascaramiento dinámico, los datos fuente originales permanecen intactos mientras que diferentes usuarios o tipos de agentes obtienen vistas personalizadas basadas en el rol o el contexto. Por ejemplo:

SELECT full_name, credit_card FROM customers;

-- se convierte en --

SELECT '***ENMASCARADO***' AS full_name, 'XXXX-XXXX-XXXX-1234' AS credit_card;

Esto protege la privacidad al permitir que el modelo interactúe con puntos de datos realistas pero anonimizados. El enmascaramiento también es una parte esencial de la guía de mitigación de riesgos GenAI del NIST.

Descubrimiento de datos como base de la seguridad

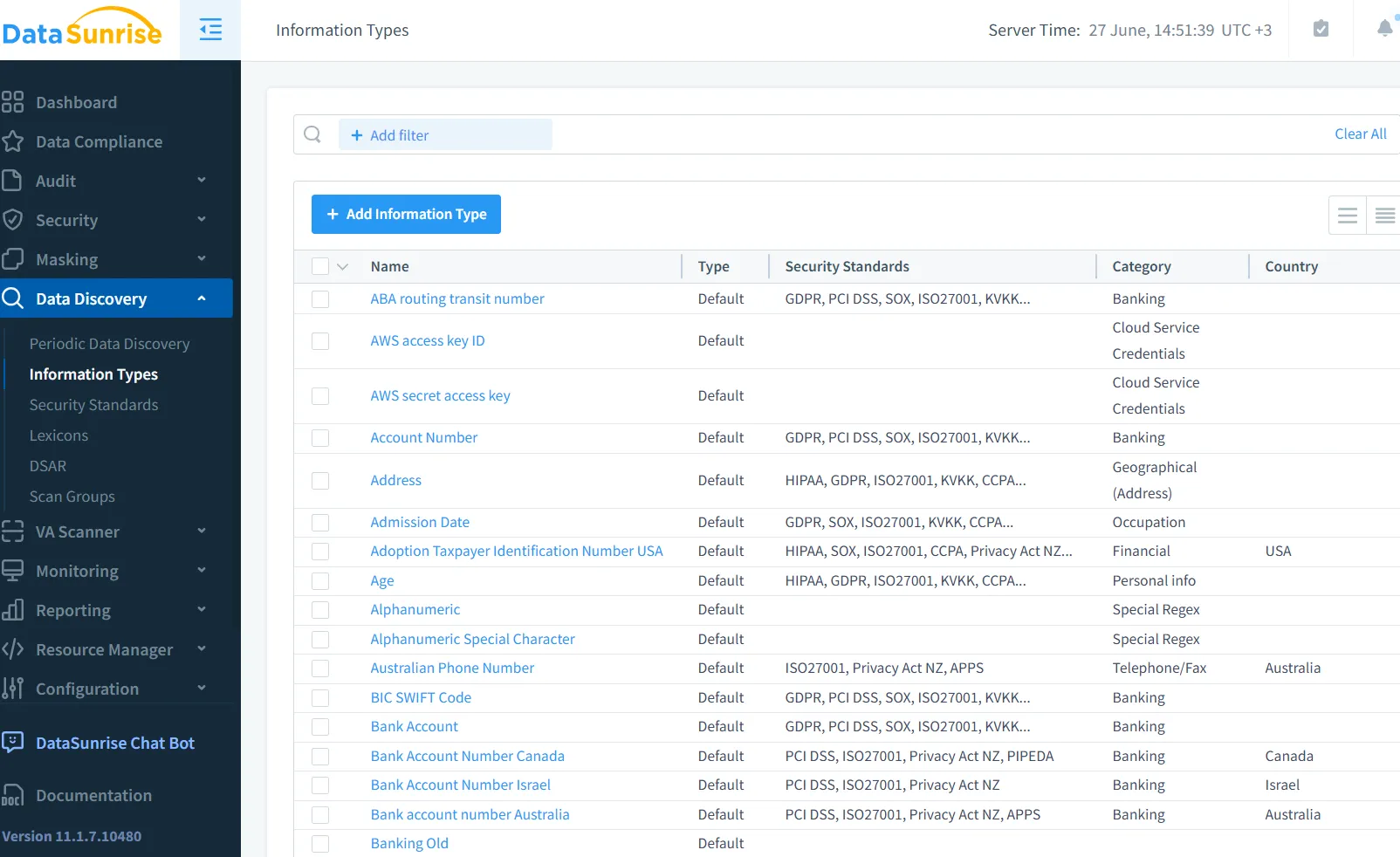

Antes de aplicar cualquier política de enmascaramiento o acceso, es fundamental descubrir dónde se encuentran los datos. Las herramientas de descubrimiento de datos pueden escanear bases de datos, almacenes vectoriales y registros no estructurados en busca de tipos de datos sensibles. Esto es particularmente valioso al construir LLM sobre sistemas heredados donde la documentación es limitada.

El motor de descubrimiento de DataSunrise soporta la clasificación basada en patrones, búsquedas en diccionarios y la clasificación asistida por IA de tipos de datos novedosos. Una vez mapeado, este inventario informa el diseño de políticas y ayuda a establecer umbrales adecuados de enmascaramiento, registro o alerta. De manera similar, AWS Macie puede ayudar a identificar datos sensibles en los buckets S3 utilizados por los recuperadores vectoriales.

Aplicación de reglas de acceso para la seguridad

La seguridad debe operar en múltiples niveles: la base de datos, la puerta de enlace API y el punto de servicio del modelo. Definir y aplicar reglas de acceso—como bloquear IPs no confiables, restringir uniones entre dominios de datos o limitar la longitud de las indicaciones—ayuda a prevenir abusos.

El motor de reglas de seguridad de DataSunrise permite a los equipos establecer controles precisos contra inyección, exfiltración o uso indebido. Los agentes LLM pueden ser incluidos en listas blancas o recibir acceso basado en roles para tipos específicos de consultas, limitando sus capacidades y minimizando la exposición.

Esto también ayuda a mitigar los ataques de inyección de indicaciones, en los que los agentes intentan escapar de sus restricciones para acceder a la lógica o los datos internos. Para obtener orientación sobre cómo defenderse contra dichos ataques, consulte los principales 10 riesgos de LLM de OWASP.

Mapeo de cumplimiento y aseguramiento continuo

Con los modelos GenAI ahora integrados en sistemas de producción, la supervisión regulatoria está en aumento. Alinear las canalizaciones de LLM con los estándares de cumplimiento requiere clasificación de datos, documentación, seguimiento de consentimientos, limitación de exposiciones y reportes periódicos.

El Compliance Manager de DataSunrise respalda esto al vincular registros de auditoría, configuraciones de enmascaramiento y jerarquías de roles en una interfaz centralizada de cumplimiento. Ofrece plantillas preconfiguradas para HIPAA, PCI DSS, SOX y GDPR, simplificando los controles internos y las auditorías externas.

Además, consulte las directrices de la Ley de IA de la UE para comprender las nuevas obligaciones legales para modelos fundamentales y sistemas de IA que interactúan con datos sensibles o regulados.

Aplicación de estas herramientas en flujos de trabajo RAG/RLHF

En un escenario práctico RAG, un agente LLM podría emitir una búsqueda vectorial para casos legales que contengan un estatuto específico. El almacén vectorial puede incluir tanto documentos legales públicos como internos. Para proteger el cumplimiento, el descubrimiento marca registros sensibles, el enmascaramiento redacta los identificadores de clientes, los registros de auditoría capturan el contexto de las consultas y las reglas de acceso restringen operaciones inseguras.

En las canalizaciones RLHF, la retroalimentación humana a menudo contiene comentarios o etiquetas confidenciales de los usuarios. Estos deben ser enmascarados, auditados y almacenados de acuerdo con la política. Por ejemplo, el documento técnico de RLHF de Anthropic ilustra cómo deben estructurarse las canalizaciones de retroalimentación teniendo en cuenta la privacidad.

Reflexiones finales

La seguridad de los agentes LLM en escenarios RAG/RLHF requiere más que afinación de modelos o validación humana. El control en tiempo real sobre el flujo de datos—lo que se recupera, enmascara y registra—es fundamental. Al combinar registros de auditoría, estrategias de enmascaramiento, escaneos de descubrimiento y control de acceso con automatización del cumplimiento, las organizaciones pueden implementar sistemas GenAI seguros y responsables.

Explore más sobre la automatización del cumplimiento de datos o revise las herramientas de seguridad para bases de datos conscientes de LLM para preparar su infraestructura para una IA de nivel producción.

Protege tus datos con DataSunrise

Protege tus datos en cada capa con DataSunrise. Detecta amenazas en tiempo real con Monitoreo de Actividad, Enmascaramiento de Datos y Firewall para Bases de Datos. Garantiza el Cumplimiento de Datos, descubre información sensible y protege cargas de trabajo en más de 50 integraciones de fuentes de datos compatibles en la nube, en instalaciones y sistemas de IA.

Empieza a proteger tus datos críticos hoy

Solicita una Demostración Descargar Ahora