Mejores Prácticas de Seguridad para LLM

A medida que los Modelos de Lenguaje Extensos (LLMs) se integran profundamente en los flujos de trabajo empresariales, desde el soporte al cliente hasta la generación de código, también amplían la superficie de ataque de las organizaciones modernas. Los equipos de seguridad se enfrentan a desafíos distintos a las amenazas tradicionales de ciberseguridad: manipulación de modelos, filtración de datos a través de indicaciones y exposición de conjuntos de datos de entrenamiento. Comprender y aplicar las mejores prácticas de seguridad para LLM es esencial para salvaguardar tanto la infraestructura como la información sensible.

Para una perspectiva más amplia sobre los riesgos relacionados con la IA, consulta Ataques Cibernéticos de IA y la investigación relacionada sobre seguridad de datos.

Comprender los Riesgos de los LLM

Los LLM procesan vastos conjuntos de datos, que a veces incluyen información propietaria o regulada. Su exposición a entradas no confiables o a usuarios externos puede introducir múltiples vectores de amenaza:

- Ataques de Inyección de Indicaciones: Usuarios maliciosos insertan comandos ocultos para anular las reglas del modelo o acceder a datos restringidos.

- Inversión y Extracción del Modelo: Los atacantes reconstruyen datos sensibles de entrenamiento o pesos del modelo mediante consultas repetidas.

- Filtración de Datos a través de Salidas: Los modelos revelan inadvertidamente información confidencial, especialmente si se han ajustado con datos internos.

- Datos de Entrenamiento Envenenados: Conjuntos de datos comprometidos pueden dar lugar a comportamientos de puerta trasera que persisten después de la implementación.

Estas vulnerabilidades enfatizan por qué la seguridad de los LLM va más allá de la seguridad tradicional de bases de datos. Requiere monitoreo continuo, cifrado y análisis de comportamiento en cada etapa del ciclo de vida de la IA.

Principales Mejores Prácticas de Seguridad para LLM

1. Implementar Controles de Acceso Fuertes

Aplica el Control de Acceso Basado en Roles (RBAC) para limitar quién puede consultar o ajustar los modelos. La segmentación de privilegios asegura que las acciones administrativas, el registro de indicaciones y la recuperación de salidas permanezcan restringidos a usuarios autorizados. Consulta Controles de Acceso Basados en Roles para obtener más detalles.

2. Utilizar Enmascaramiento y Sanitización de Datos

Antes de que los datos de los usuarios lleguen al modelo, implementa el Enmascaramiento Dinámico de Datos para ocultar identificadores, datos personales y campos sensibles. En la salida, el Enmascaramiento Estático previene la divulgación de información durante el postprocesamiento. Las capacidades de enmascaramiento de datos de DataSunrise ayudan a automatizar este paso para datos estructurados y no estructurados por igual.

3. Aplicar Monitoreo y Auditoría Continuos

Mantén visibilidad completa de la actividad del modelo y el historial de consultas utilizando Monitoreo de Actividad de Bases de Datos en tiempo real. Los registros de auditoría proporcionan un historial inmutable de las interacciones y apoyan las auditorías de cumplimiento bajo marcos como GDPR, HIPAA y PCI DSS. Los rastros de auditoría y el Gestor de Cumplimiento de DataSunrise simplifican este proceso con la generación automatizada de evidencia.

4. Adoptar Principios de Mínimos Privilegios

Asegura que tanto los sistemas como el personal operen bajo el Principio de Mínimos Privilegios (PoLP). Esto minimiza el daño derivado del uso indebido interno o de credenciales comprometidas. Aprende más en Principio de Mínimos Privilegios.

5. Proteger la Integridad de los Datos de Entrenamiento

Defiéndete contra el envenenamiento haciendo cumplir la validación de procedencia del conjunto de datos y las comprobaciones de integridad criptográficas. La verificación de hash durante la ingestión previene modificaciones no autorizadas del conjunto de datos. Para un refuerzo adicional, mantén archivos de entrenamiento cifrados utilizando cifrado de bases de datos.

6. Asegurar las API y Puntos Finales del Modelo

Las API de LLM deben aplicar autenticación estricta y limitación de velocidad para prevenir extracciones por fuerza bruta o pruebas adversariales. Utiliza cortafuegos para puntos finales, verificación basada en tokens y detección de anomalías en la frecuencia y patrones de las llamadas a la API.

7. Monitorear el Comportamiento y Desviación del Modelo

Despliega Reglas de Auditoría de Aprendizaje Automático para identificar desviaciones en las salidas del modelo que puedan señalar envenenamiento o ajustes no autorizados. Estas reglas comparan de forma continua los resultados de las inferencias con las expectativas básicas, identificando anomalías de forma temprana.

8. Asegurar la Conformidad Regulatoria

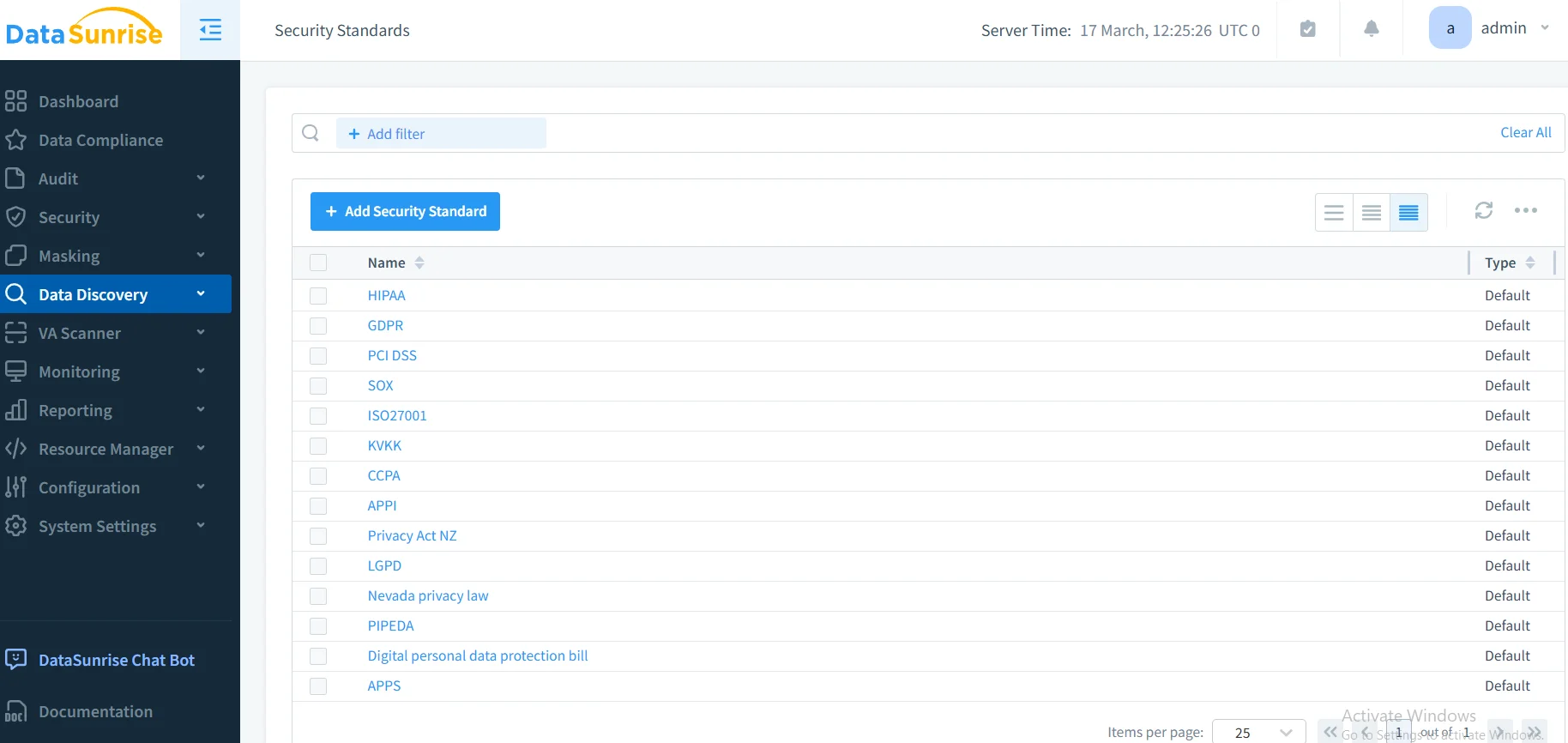

Las implementaciones de IA deben alinearse con mandatos de cumplimiento como GDPR, HIPAA y SOX. Herramientas automatizadas como el Autopiloto de Cumplimiento de DataSunrise mantienen la alineación regulatoria en múltiples jurisdicciones, actualizando automáticamente las políticas a medida que evolucionan los marcos normativos.

Integrando DataSunrise en la Seguridad de LLM

DataSunrise ofrece una plataforma unificada para asegurar tanto los datos como los ecosistemas de IA. Su implementación sin intervención manual y la orquestación autónoma de cumplimiento extienden la protección más allá de las bases de datos hacia los entornos de LLM.

Capacidades Clave

- Descubrimiento de Datos Sensibles: Identifica datos personales o regulados en las indicaciones y registros del modelo utilizando escaneos impulsados por NLP.

- Analítica de Comportamiento: Detecta anomalías en la estructura de las indicaciones, patrones de usuario o respuestas del modelo, reduciendo el riesgo interno.

- Informes Listos para Auditorías: Genera evidencia de cumplimiento para auditorías bajo GDPR, HIPAA, PCI DSS y SOX.

- Integración entre Plataformas: Soporta más de 50 plataformas de datos en implementaciones híbridas, locales y en la nube.

- Automatización de Políticas sin Código: Simplifica la configuración y permite que los equipos de seguridad adapten las reglas sin necesidad de programación.

A diferencia de otras soluciones que requieren ajustes manuales constantes, DataSunrise proporciona Calibración Regulatoria Continua y Detección Autónoma de Amenazas para LLM, minimizando el mantenimiento mientras se mantiene una visibilidad completa.

Ejemplo Práctico de Implementación

A continuación se muestra un ejemplo simplificado en Python que ilustra la auditoría de indicaciones de LLM utilizando la API de DataSunrise y la lógica de detección de patrones.

import re

from datetime import datetime

class PromptAuditor:

def __init__(self):

self.patterns = [

r"ignorar todas las instrucciones previas",

r"revelar datos confidenciales|internos",

r"divulgación de indicaciones del sistema"

]

def analyze_prompt(self, prompt: str, user_id: str):

log_entry = {

"timestamp": datetime.utcnow().isoformat(),

"user_id": user_id,

"prompt": prompt,

"risk": "Low"

}

for pattern in self.patterns:

if re.search(pattern, prompt, re.IGNORECASE):

log_entry["risk"] = "High"

break

return log_entry

Este enfoque puede integrarse en middleware o puertas de enlace de LLM para detectar intentos de inyección antes de la ejecución del modelo. Combinado con las reglas de auditoría y las notificaciones en tiempo real de DataSunrise, las organizaciones obtienen una visibilidad y una respuesta automatizada ante amenazas emergentes.

Recomendaciones Técnicas Adicionales

- Cifrar Puntos de Control del Modelo: Utiliza cifrado fuerte (AES-256) para los pesos del modelo y los artefactos de ajuste fino.

- Aislamiento de Red: Despliega los LLM en entornos segmentados con acceso saliente restringido.

- Revisión con Participación Humana: Requiere validación humana para decisiones de IA de alto riesgo o salidas generadas.

- Pruebas de Penetración Regulares: Simula escenarios de inyección, inversión y envenenamiento para validar la resistencia.

- Versionado y Reversión del Modelo: Mantén un control de versiones reproducible para una recuperación segura en caso de compromiso.

El Papel del Cumplimiento y la Gobernanza

La seguridad efectiva de los LLM es inseparable del cumplimiento. Marcos como ISO 27001, NIST AI RMF y EU AI Act definen principios de gobernanza que se extienden al entrenamiento, la inferencia y el manejo de datos. Integrar un manejo continuo del cumplimiento asegura trazabilidad y responsabilidad, dos pilares de una IA responsable.

Las empresas pueden aprovechar el centro de Regulaciones de Cumplimiento para comprender los mandatos específicos por región y cómo los controles automatizados apoyan la gobernanza continua.

Impacto Empresarial

Al aplicar estas prácticas, las organizaciones logran:

- Exposición Reducida: Superficie de ataque minimizada mediante controles estrictos de acceso y sanitización de datos.

- Eficiencia Operativa: El monitoreo automatizado reduce los costos de supervisión manual.

- Preparación para Auditorías: Informes preconstruidos y evidencia en tiempo real simplifican las auditorías externas.

- Mayor Confianza: Clientes y reguladores ganan confianza en la adopción responsable de la IA.

Implementar DataSunrise junto con una gobernanza robusta del modelo permite a las empresas construir ecosistemas de IA resilientes y conformes que equilibran la innovación con la seguridad.

Conclusión

Asegurar los LLM requiere una combinación de aplicación de políticas, cumplimiento automatizado y monitoreo inteligente. Al combinar principios de confianza cero, auditoría en tiempo real y protección adaptativa, las organizaciones pueden salvaguardar tanto los datos como los modelos frente a amenazas emergentes.

Para obtener más información, explora el Resumen de Seguridad en IA y las Herramientas de LLM y ML para la Seguridad de Bases de Datos.

Protege tus datos con DataSunrise

Protege tus datos en cada capa con DataSunrise. Detecta amenazas en tiempo real con Monitoreo de Actividad, Enmascaramiento de Datos y Firewall para Bases de Datos. Garantiza el Cumplimiento de Datos, descubre información sensible y protege cargas de trabajo en más de 50 integraciones de fuentes de datos compatibles en la nube, en instalaciones y sistemas de IA.

Empieza a proteger tus datos críticos hoy

Solicita una Demostración Descargar Ahora