Gestión de Riesgos de IA en Sistemas LLM

A medida que la inteligencia artificial transforma las operaciones empresariales, el 78% de las organizaciones están implementando sistemas de Modelos de Lenguaje Extendido (LLM) en flujos de trabajo críticos. Aunque los LLM ofrecen capacidades sin precedentes, introducen sofisticados desafíos en la gestión de riesgos que los marcos tradicionales no pueden abordar adecuadamente.

Esta guía examina los requisitos para la gestión de riesgos de IA en sistemas LLM, explorando estrategias integrales que permiten a las organizaciones aprovechar el potencial de los LLM mientras mantienen controles de riesgo sólidos.

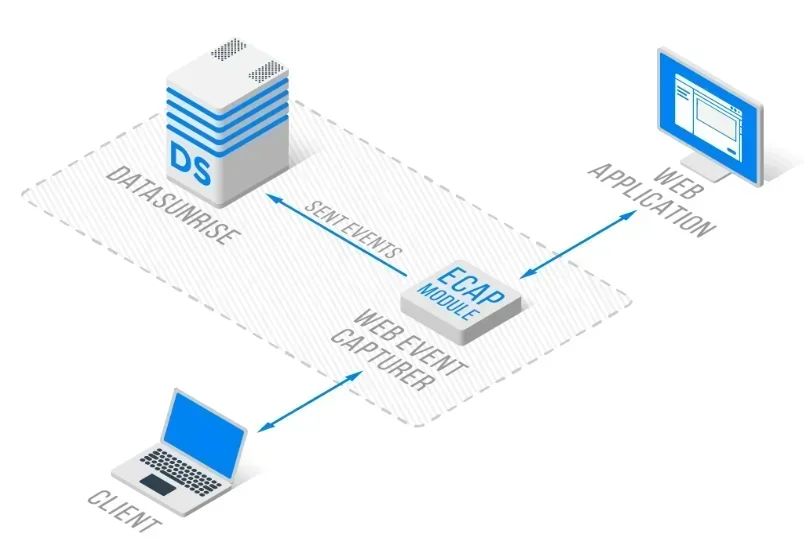

La avanzada plataforma de gestión de riesgos de IA de DataSunrise ofrece Orquestación de Riesgos sin Intervención (Zero-Touch) con Detección Autónoma de Amenazas en todas las principales plataformas LLM. Nuestro Marco Centralizado de Gestión de Riesgos de IA integra de manera fluida la gestión de riesgos con controles técnicos, proporcionando una supervisión de riesgos con Precisión Quirúrgica para una protección integral de los LLM.

Comprendiendo los Paisajes de Riesgo en los LLM

Los Modelos de Lenguaje Extendido operan a través de complejas redes neuronales que procesan grandes cantidades de datos no estructurados, toman decisiones de manera autónoma y generan contenido dinámico. Esto crea vulnerabilidades de seguridad sin precedentes, que requieren enfoques integrales de gestión de riesgos y capacidades de detección de amenazas.

La gestión de riesgos en LLM abarca la identificación de amenazas, la evaluación de vulnerabilidades y estrategias de mitigación a lo largo de todo el ciclo de vida de la inteligencia artificial. A diferencia de los sistemas tradicionales, los LLM presentan perfiles de riesgo en constante evolución que requieren monitoreo continuo y medidas adaptativas de protección de datos junto con la implementación de reglas de seguridad.

Categorías Críticas de Riesgos en LLM

Riesgos de Seguridad del Modelo

Los sistemas LLM enfrentan ataques sofisticados que incluyen indicaciones adversariales diseñadas para manipular el comportamiento del modelo, envenenamiento de datos de entrenamiento que influye en los resultados, e intentos de extracción del modelo para robar propiedad intelectual mediante técnicas de elusión del firewall de bases de datos y tentativas de inyección SQL.

Riesgos de Privacidad de Datos y de Cumplimiento Normativo

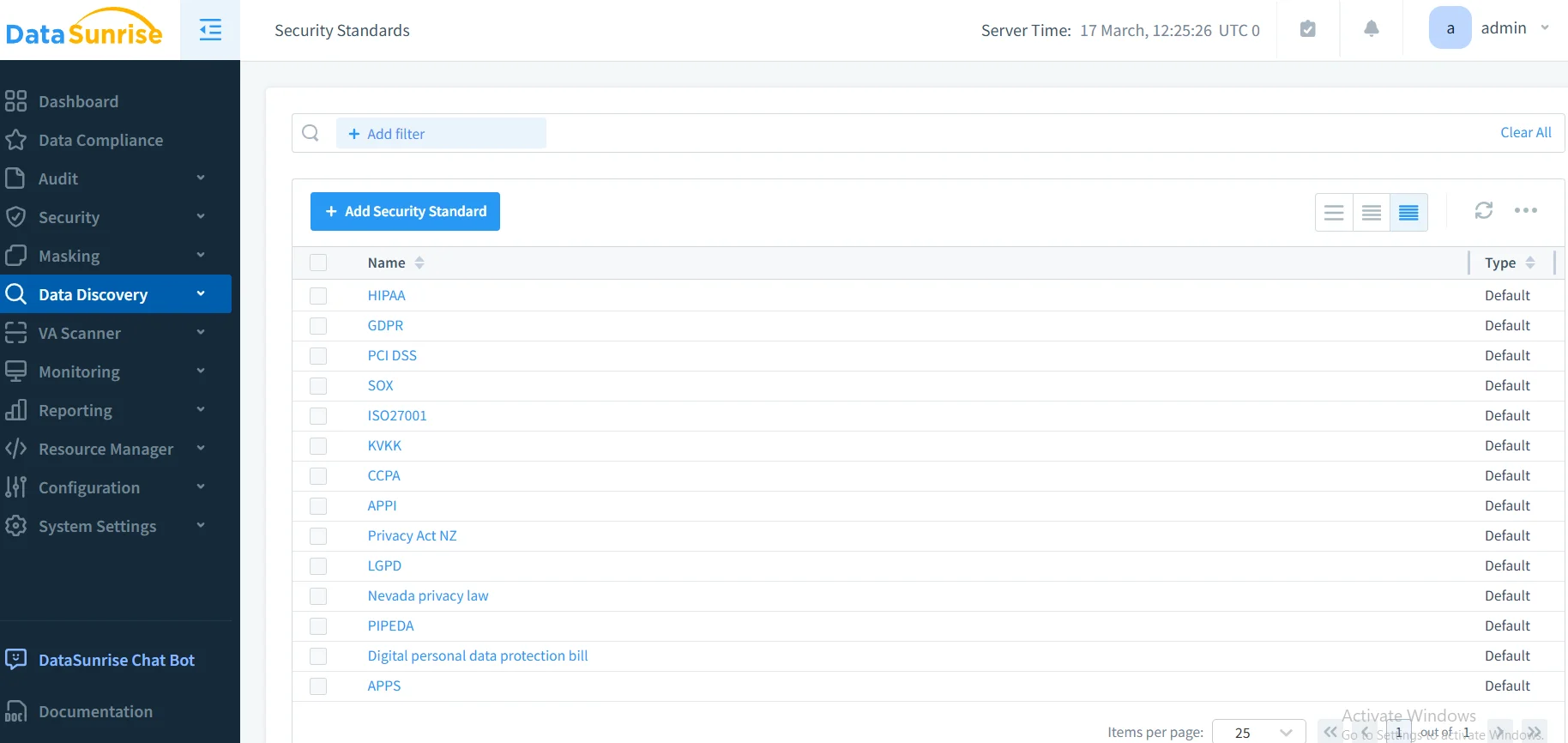

Los LLM que procesan información sensible generan riesgos significativos de violación de datos debido a la divulgación involuntaria de PII, fugas de información entre conversaciones y el incumplimiento regulatorio en marcos como GDPR, HIPAA y PCI DSS, lo que requiere el cumplimiento de regulaciones de cumplimiento.

Riesgos Operativos y Éticos

El despliegue de LLM crea desafíos operativos que incluyen desviaciones del modelo que afectan el rendimiento, problemas de escalabilidad y preocupaciones éticas relacionadas con resultados sesgados, lo que requiere el uso de análisis de comportamiento para la detección y mitigación.

Implementación de Evaluación de Riesgos

La gestión efectiva de riesgos en LLM requiere enfoques de evaluación sistemáticos:

import re

from datetime import datetime

class LLMRiskAssessment:

def assess_interaction(self, prompt: str, response: str):

"""Evaluación de riesgos para interacciones en LLM"""

pii_risk = self._detect_pii(prompt + response)

injection_risk = self._detect_injection(prompt)

overall_risk = max(pii_risk, injection_risk)

return {

'risk_level': 'HIGH' if overall_risk > 0.7 else 'MEDIUM' if overall_risk > 0.4 else 'LOW',

'mitigation_required': overall_risk > 0.6

}

def _detect_pii(self, text: str) -> float:

"""Detectar patrones de PII"""

patterns = [r'\b[\w._%+-]+@[\w.-]+\.[A-Z|a-z]{2,}\b', r'\b\d{3}-\d{2}-\d{4}\b']

detected = sum(1 for p in patterns if re.search(p, text))

return min(detected / len(patterns), 1.0)

Mejores Prácticas de Implementación

Para las Organizaciones:

- Establecer Gobernanza de Riesgos: Crear comités de riesgo de IA con responsabilidades claras y políticas de seguridad de datos junto con procedimientos de reglas de aprendizaje y auditoría

- Desplegar Monitoreo Continuo: Implementar el monitoreo en tiempo real de la actividad de bases de datos para todas las interacciones LLM

- Mantener la Documentación de Riesgos: Documentar riesgos, estrategias de mitigación y registros de auditoría con la optimización del almacenamiento de auditoría

Para Equipos Técnicos:

- Seguridad de Múltiples Capas: Implementar controles de acceso y enmascaramiento dinámico de datos

- Respuesta Automatizada: Configurar notificaciones en tiempo real y respuesta ante incidentes

- Monitoreo de Rendimiento: Asegurarse de que los controles de riesgo no afecten el rendimiento de los LLM

DataSunrise: Solución Integral de Gestión de Riesgos en LLM

DataSunrise ofrece una gestión de riesgos de grado empresarial, diseñada específicamente para entornos LLM. Nuestra solución proporciona Orquestación Autónoma de Riesgos con Detección de Amenazas en Tiempo Real en ChatGPT, Amazon Bedrock, Azure OpenAI, Qdrant y despliegues LLM personalizados.

Características Clave:

- Evaluación de Riesgos en Tiempo Real: Detección de Amenazas Potenciada por ML con Protección Contextualizada

- Monitoreo Integral: Monitoreo de IA sin Intervención (Zero-Touch) con registros de auditoría detallados

- Protección Avanzada de Datos: Enmascaramiento de Datos con Precisión Quirúrgica y detección de PII

- Cobertura Multiplataforma: Gestión de riesgos unificada en más de 50 plataformas compatibles

- Integración de Cumplimiento: Reporte de cumplimiento automatizado para los principales marcos regulatorios

Los Modos de Despliegue Flexibles de DataSunrise soportan entornos locales, en la nube e híbridos con implementación sin intervención (Zero-Touch). Las organizaciones logran una reducción del 85% en incidentes de seguridad de IA y una mejora en la postura de cumplimiento gracias al reporte regulatorio automatizado.

Conclusión: Gestión Proactiva de Riesgos en LLM

Una gestión efectiva de riesgos de IA en sistemas LLM requiere estrategias integrales que aborden dimensiones técnicas, operativas y regulatorias. Las organizaciones que implementan marcos robustos de riesgo se posicionan para aprovechar las capacidades de los LLM, manteniendo la confianza de los interesados y la resiliencia operativa.

A medida que la adopción de LLM se acelera, la gestión de riesgos se transforma de una supervisión opcional a una capacidad empresarial esencial. Al implementar marcos comprobados y soluciones de monitoreo continuo, las organizaciones pueden avanzar con confianza en innovaciones LLM mientras protegen sus activos.

DataSunrise: Tu Socio en Gestión de Riesgos en LLM

DataSunrise lidera en soluciones de gestión de riesgos en LLM, proporcionando Protección Integral de IA con Análisis Avanzados de Riesgos. Nuestra plataforma rentable y escalable atiende a organizaciones que van desde startups hasta empresas Fortune 500.

Experimenta nuestra Orquestación Autónoma de Seguridad y descubre cómo DataSunrise ofrece una Reducción Cuantificable de Riesgos. Programa tu demostración para explorar nuestras capacidades de gestión de riesgos en LLM.