Gestión de datos sensibles en modelos de IA y LLM

A medida que la inteligencia artificial transforma las operaciones empresariales, el 91% de las organizaciones está implementando modelos de IA y LLM en flujos de trabajo críticos que procesan grandes cantidades de información sensible. Aunque estas tecnologías ofrecen capacidades sin precedentes, introducen desafíos complejos en la protección de datos que los marcos de seguridad tradicionales no pueden abordar adecuadamente.

Esta guía examina estrategias integrales para la gestión de datos sensibles en modelos de IA y LLM, explorando técnicas de implementación que permiten a las organizaciones aprovechar el potencial de la IA mientras mantienen una protección robusta para la información confidencial.

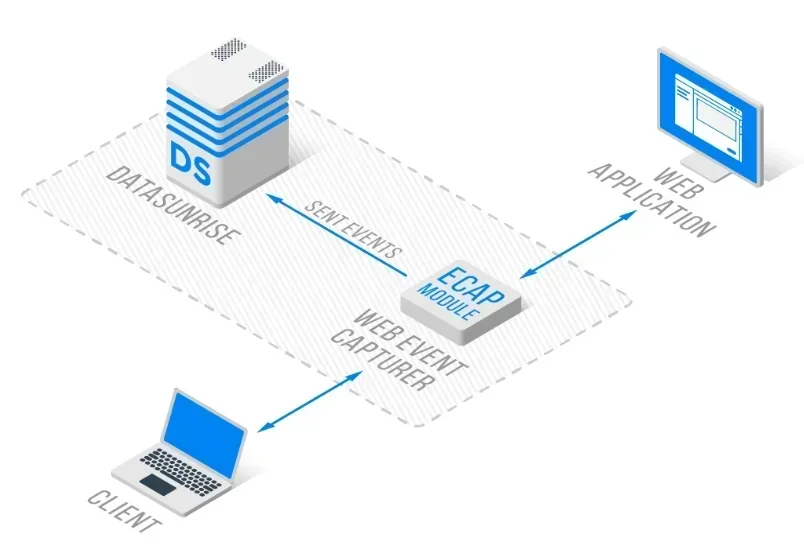

La avanzada plataforma de protección de datos de IA de DataSunrise ofrece una Gestión de Datos Sensibles sin intervención con Orquestación Autónoma de Privacidad en todas las principales plataformas de IA. Nuestra Protección Contextual integra sin problemas el manejo de datos sensibles con controles técnicos, proporcionando una protección de datos de precisión quirúrgica para una seguridad integral en IA y LLM.

Comprendiendo los desafíos de los datos sensibles en los sistemas de IA

Los modelos de IA y LLM operan de manera diferente a las aplicaciones tradicionales al manejar información sensible. Estos sistemas procesan, aprenden de y potencialmente memorizan conjuntos de datos extensos que contienen información de identificación personal (PII), registros financieros, datos de salud e información empresarial propietaria.

La naturaleza dinámica de los sistemas de IA crea vulnerabilidades únicas, donde los datos sensibles pueden ser expuestos inadvertidamente a través de las salidas del modelo, fugas de datos de entrenamiento o contaminación cruzada entre conversaciones. Las organizaciones deben implementar marcos integrales de seguridad de datos que aborden tanto los requisitos técnicos como los regulatorios mediante medidas de seguridad en bases de datos.

Categorías críticas de datos sensibles

Información personal y financiera

Los modelos de IA procesan frecuentemente datos personales que incluyen nombres, direcciones, números de seguridad social e información de pagos, lo que requiere técnicas especializadas de enmascaramiento de datos. Las organizaciones deben implementar enmascaramiento dinámico de datos para proteger la PII mientras mantienen la funcionalidad del modelo con reglas de seguridad y capacidades de detección de amenazas.

Datos de salud y empresariales

Las aplicaciones de IA manejan información de salud protegida (PHI) e información empresarial propietaria, lo que requiere el cumplimiento de normas HIPAA y una robusta protección de la propiedad intelectual mediante controles de acceso basados en roles y la implementación de políticas de seguridad.

Ejemplos de implementación

Detección y enmascaramiento de datos sensibles

Este ejemplo demuestra cómo detectar y enmascarar automáticamente la información sensible en las entradas de la IA antes de su procesamiento. El sistema utiliza expresiones regulares para identificar patrones comunes de PII y los reemplaza con tokens enmascarados, asegurando que los datos sensibles no lleguen al modelo de IA mientras se mantiene la estructura del texto para su procesamiento.

import re

from typing import Dict, List, Tuple

class SensitiveDataProtector:

def __init__(self):

self.pii_patterns = {

'ssn': r'\b\d{3}-\d{2}-\d{4}\b',

'email': r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b',

'credit_card': r'\b(?:\d{4}[-\s]?){3}\d{4}\b'

}

def validate_ai_input(self, prompt: str) -> Dict[str, any]:

"""Validar y enmascarar la entrada de IA para datos sensibles"""

masked_prompt = prompt

detected_types = []

for pii_type, pattern in self.pii_patterns.items():

if re.search(pattern, prompt):

detected_types.append(pii_type)

masked_prompt = re.sub(pattern, f'[{pii_type.upper()}_MASKED]', masked_prompt)

return {

'masked_prompt': masked_prompt,

'pii_detected': detected_types,

'safe_for_processing': len(detected_types) == 0

}

Saneamiento de la salida de IA

Esta implementación muestra cómo sanear las respuestas del modelo de IA para prevenir la exposición accidental de información sensible. El sistema analiza las salidas en busca de palabras clave potencialmente sensibles y patrones de PII, reemplazándolos con alternativas seguras mientras se mantiene la coherencia de la respuesta.

from datetime import datetime

class AIOutputSanitizer:

def __init__(self):

self.sensitive_keywords = ['contraseña', 'secreto', 'confidencial', 'privado']

def sanitize_response(self, response: str, user_id: str) -> Dict[str, any]:

"""Sanear la respuesta de IA para contenido sensible"""

sanitized = response

violations = []

# Verificar palabras clave sensibles

for keyword in self.sensitive_keywords:

if keyword.lower() in response.lower():

violations.append(keyword)

sanitized = sanitized.replace(keyword, f"[{keyword.upper()}_REDACTED]")

# Registrar evento de saneamiento

audit_entry = {

'timestamp': datetime.utcnow().isoformat(),

'user_id': user_id,

'violations': violations,

'sanitized': len(violations) > 0

}

return {

'sanitized_response': sanitized,

'safe_for_output': len(violations) == 0,

'audit_log': audit_entry

}

Mejores prácticas de implementación

Para las organizaciones:

- Clasificación de datos: Implementar la identificación automatizada de datos sensibles con herramientas de descubrimiento de datos y protocolos de enmascaramiento estático de datos

- Privacidad desde el diseño: Incorporar la protección en la arquitectura de IA con controles de acceso y protección mediante firewall de base de datos

- Monitoreo continuo: Desplegar el monitoreo en tiempo real de la actividad de bases de datos con seguimiento mediante monitorización de actividad y registros de auditoría

Para equipos técnicos:

- Protección multinivel: Implementar validación de entradas y saneamiento de salidas con protocolos de evaluación de vulnerabilidades

- Detección automatizada: Desplegar detección de datos sensibles potenciada por ML con capacidades de encriptación de bases de datos

- Documentación de auditoría: Mantener registros de auditoría y sistemas de reporte de cumplimiento integrales con trazas de auditoría

DataSunrise: Solución integral de protección de datos para IA

DataSunrise ofrece una protección de datos sensibles de nivel empresarial diseñada específicamente para entornos de IA y LLM. Nuestra solución proporciona Cumplimiento de IA por defecto con Máxima Protección de Privacidad en ChatGPT, Amazon Bedrock, Azure OpenAI y despliegues personalizados de IA.

Características clave:

- Detección de datos en tiempo real: Identificación avanzada de PII con Protección Contextual

- Enmascaramiento de precisión quirúrgica: Enmascaramiento inteligente que preserva la funcionalidad del modelo

- Cobertura multiplataforma: Protección unificada en más de 50 plataformas compatibles

- Análisis potenciado por ML: Análisis de comportamiento para la detección de anomalías

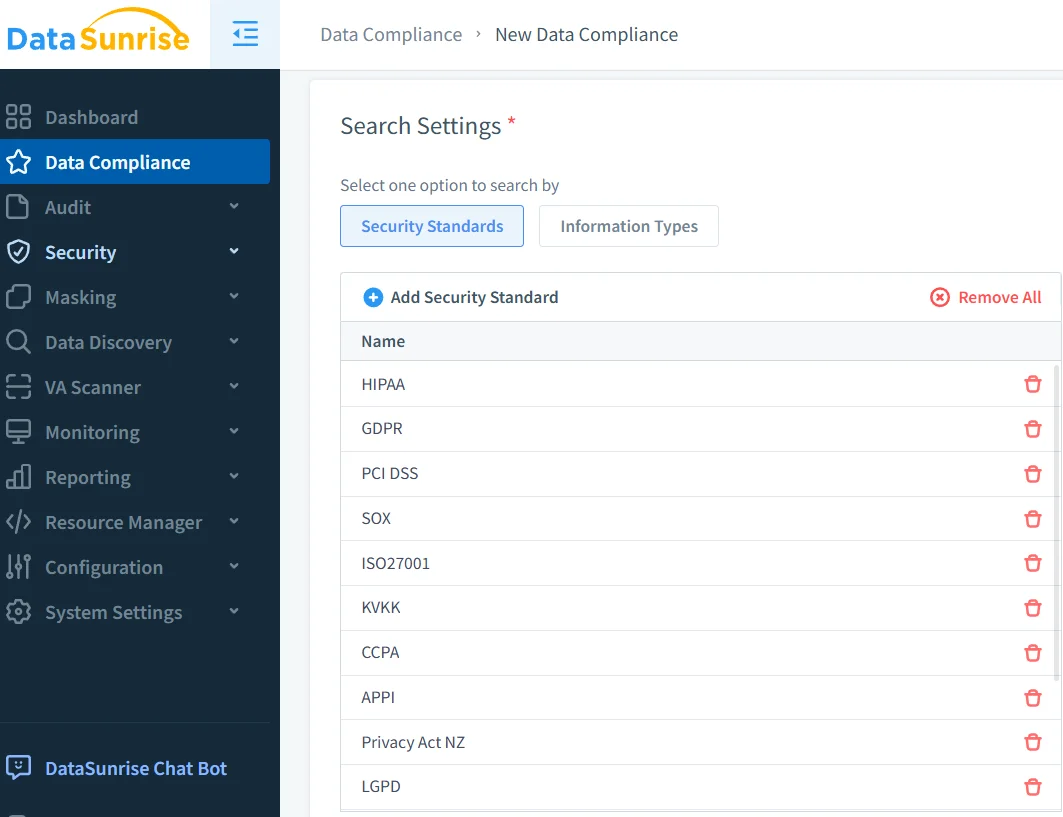

- Cumplimiento automatizado: Reporte de cumplimiento con un solo clic para los principales marcos regulatorios

Los modos de despliegue flexibles de DataSunrise soportan entornos locales, en la nube e híbridos con una implementación sin intervención. Las organizaciones logran una reducción significativa en los incidentes de exposición de datos sensibles a través de mecanismos de protección automatizados.

Consideraciones sobre el cumplimiento normativo

El manejo de datos sensibles en los sistemas de IA debe abordar requisitos regulatorios integrales:

- Cumplimiento de GDPR: Minimización de datos y gestión del consentimiento para el procesamiento de datos personales en IA

- Requisitos de HIPAA: Protección de PHI en aplicaciones de IA en el sector salud

- Estándares PCI DSS: Manejo seguro de datos de pago en sistemas financieros de IA

- Cumplimiento de SOX: Controles internos para sistemas de IA que procesan información financiera

Conclusión: Asegurando la IA a través de la protección de datos

El manejo de datos sensibles en modelos de IA y LLM requiere marcos sofisticados que aborden la identificación, protección y gobernanza de datos a lo largo del ciclo de vida de la IA. Las organizaciones que implementan estrategias robustas de protección de datos sensibles se posicionan para aprovechar el potencial transformador de la IA, al mismo tiempo que mantienen la confianza de las partes interesadas.

A medida que los sistemas de IA se vuelven cada vez más sofisticados, la protección de datos evoluciona de una mejora opcional a una capacidad empresarial esencial. Al implementar marcos de protección integrales, las organizaciones pueden desplegar innovaciones en IA con confianza, protegiendo al mismo tiempo sus activos de información.

Protege tus datos con DataSunrise

Protege tus datos en cada capa con DataSunrise. Detecta amenazas en tiempo real con Monitoreo de Actividad, Enmascaramiento de Datos y Firewall para Bases de Datos. Garantiza el Cumplimiento de Datos, descubre información sensible y protege cargas de trabajo en más de 50 integraciones de fuentes de datos compatibles en la nube, en instalaciones y sistemas de IA.

Empieza a proteger tus datos críticos hoy

Solicita una Demostración Descargar Ahora