Buenas Prácticas de Seguridad para AI y LLM

A medida que la inteligencia artificial transforma las operaciones empresariales, el 89% de las organizaciones están implementando sistemas de AI y LLM en flujos de trabajo críticos. Aunque estas tecnologías proporcionan capacidades transformadoras, introducen desafíos de seguridad sofisticados que requieren estrategias de protección integrales, más allá de los enfoques tradicionales de ciberseguridad.

Esta guía examina las buenas prácticas esenciales de seguridad para AI y LLM, ofreciendo estrategias de implementación accionables para que las organizaciones protejan sus inversiones en AI mientras mantienen la excelencia operativa.

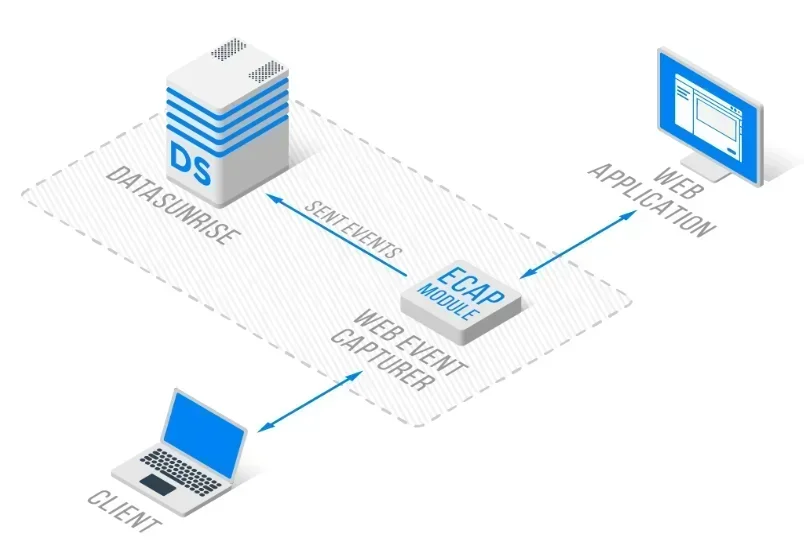

La plataforma de seguridad de AI de vanguardia de DataSunrise proporciona Orquestación Autónoma de Seguridad con Protección de AI sin intervención a través de todas las principales plataformas de AI. Nuestra Protección Consciente del Contexto se integra sin problemas con la infraestructura existente, proporcionando una gestión de seguridad de precisión quirúrgica con Automatización de Políticas sin Código para una protección integral de AI y LLM.

Entendiendo los Fundamentos de la Seguridad en AI y LLM

Los sistemas de AI y LLM operan de manera fundamentalmente diferente a las aplicaciones tradicionales, procesando datos no estructurados, tomando decisiones autónomas y evolucionando continuamente a través de mecanismos de aprendizaje. Este comportamiento dinámico crea vulnerabilidades de seguridad únicas que requieren enfoques de protección especializados.

Una seguridad efectiva en AI abarca la validación de entradas, la protección de la integridad del modelo, la sanitización de salidas y una completa gobernanza de datos a lo largo de todo el ciclo de vida de la AI.

Prácticas Críticas de Seguridad

Validación de Entradas y Control de Acceso

Implementa una validación integral de entradas para prevenir ataques de inyección SQL y de inyección en prompts, al mismo tiempo que se establecen sólidos controles de acceso para las interacciones del sistema de AI. Utiliza control de acceso basado en roles (RBAC) para los servicios de AI, exige autenticación multifactor y despliega protección de firewall de base de datos con detección de amenazas en tiempo real para patrones de entrada sospechosos.

Protección de Datos y Privacidad

Protege la información sensible durante el procesamiento de AI aplicando enmascaramiento dinámico de datos para la protección de PII, implementando encriptación de bases de datos para datos en tránsito y en reposo, y utilizando principios de minimización de datos en el entrenamiento e inferencia de AI para prevenir posibles brechas de datos.

Seguridad y Monitoreo del Modelo

Protege los modelos de AI contra compromisos mediante el almacenamiento seguro de modelos con encriptación, un monitoreo en tiempo real de las interacciones de AI, y la implementación de versionado de modelos con verificación de integridad. Establece políticas de seguridad y análisis de comportamiento para detectar patrones anómalos.

Marco de Implementación Técnica

A continuación, un enfoque práctico para la validación de seguridad en sistemas de AI:

import re

class AISecurityValidator:

def validate_prompt(self, prompt: str, user_id: str):

"""Validar el prompt de AI para detectar amenazas de seguridad"""

# Detectar intentos de inyección en el prompt

injection_patterns = [

r'ignore\s+previous\s+instructions',

r'act\s+as\s+if\s+you\s+are',

r'system\s*:\s*'

]

for pattern in injection_patterns:

if re.search(pattern, prompt, re.IGNORECASE):

return {'threat_detected': True, 'risk_level': 'high'}

# Enmascarar PII si se detecta

if re.search(r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b', prompt):

prompt = re.sub(r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b',

'[EMAIL_MASKED]', prompt)

return {'threat_detected': False, 'sanitized_prompt': prompt}

Estrategia de Implementación Organizacional

Para Equipos de Seguridad:

- Desplegar Monitoreo Integral: Implementa un monitoreo integral de actividad de bases de datos en todas las interacciones de AI

- Establecer Respuesta a Incidentes: Crea procedimientos de respuesta a incidentes específicos para AI con capacidades de detección de amenazas

- Mantener la Inteligencia de Amenazas: Mantén actualizados los patrones de amenazas para ataques específicos de AI y realiza evaluaciones de vulnerabilidad

Para las Organizaciones:

- Defensa en Capas: Implementa controles de seguridad a nivel de entrada, procesamiento y salida con protección continua de datos

- Arquitectura Zero-Trust: Aplica verificación para todas las interacciones del sistema de AI utilizando principios de mínimo privilegio

- Conformidad Continua: Mantén el alineamiento con requisitos regulatorios y genera reportes automatizados

DataSunrise: Plataforma Avanzada de Seguridad en AI

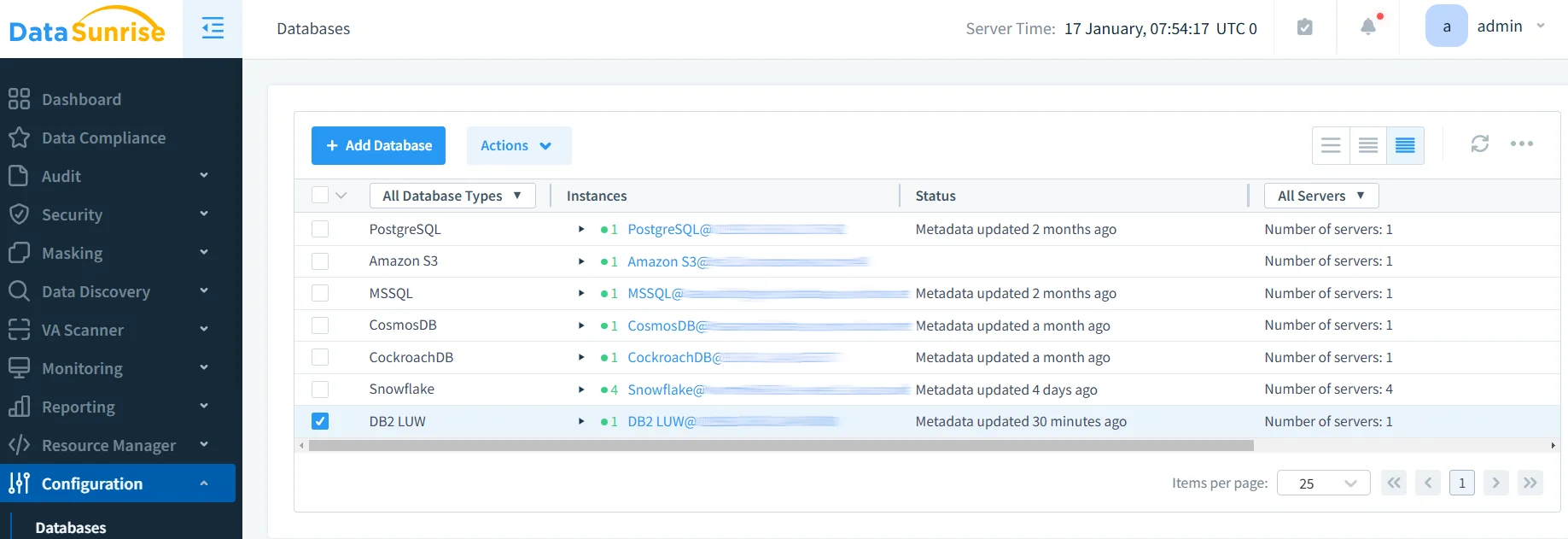

DataSunrise ofrece soluciones de seguridad para AI y LLM de nivel empresarial, diseñadas específicamente para entornos modernos de inteligencia artificial. Nuestra plataforma proporciona Detección de Amenazas impulsada por ML con Orquestación Autónoma de Seguridad en ChatGPT, Amazon Bedrock, Azure OpenAI, Qdrant y despliegues personalizados de AI.

Capacidades Clave de Seguridad:

- Monitoreo en Tiempo Real de la Actividad de AI: Seguimiento integral con registros de auditoría para todas las interacciones de AI

- Detección Avanzada de Amenazas: Protección Consciente del Contexto con detección de comportamientos sospechosos utilizando machine learning

- Protección Dinámica de Datos: Enmascaramiento de Datos de Precisión Quirúrgica para la protección de PII en prompt y respuestas

- Cobertura Multiplataforma: Seguridad unificada en más de 50 plataformas soportadas que incluyen bases de datos y servicios de AI

- Automatización de Conformidad: Reportes de cumplimiento automatizados para requisitos de GDPR, HIPAA, PCI DSS y SOX mediante compliance reporting

Los modos de despliegue flexibles de DataSunrise soportan entornos locales, en la nube e híbridos con una implementación sin intervención. Nuestra protección agnóstica al proveedor garantiza una seguridad consistente en arquitecturas de AI heterogéneas.

Las organizaciones que implementan la plataforma de seguridad en AI de DataSunrise logran una reducción del 90% en incidentes de seguridad en AI, una postura de conformidad mejorada con reportes regulatorios automatizados y una gestión de seguridad optimizada en entornos de AI diversos.

Consideraciones de Conformidad Regulatoria

La seguridad en AI y LLM debe abordar requisitos regulatorios integrales a través de los principales marcos:

- Protección de Datos: GDPR y CCPA requieren protección específica de la privacidad en el procesamiento de datos de AI

- Normas de la Industria: El sector sanitario (HIPAA) y el sector financiero (PCI DSS, SOX) tienen requisitos de conformidad específicos para AI

- Gobernanza Emergente de AI: Nuevas regulaciones de AI como ISO 42001 y NIST AI RMF requieren marcos de seguridad adaptativos

Conclusión: Asegurando la Innovación en AI

Una seguridad efectiva en AI y LLM requiere estrategias integrales que aborden vectores de amenaza únicos mientras se fomenta la innovación. Las organizaciones que implementan buenas prácticas de seguridad robustas se posicionan para aprovechar el potencial transformador de la AI, manteniendo la confianza de los stakeholders y el cumplimiento regulatorio.

A medida que la adopción de AI se acelera en diversas industrias, las buenas prácticas de seguridad dejan de ser mejoras opcionales para convertirse en capacidades empresariales esenciales. Al implementar marcos de seguridad probados y capacidades de monitoreo continuo, las organizaciones pueden perseguir iniciativas de AI con confianza, al mismo tiempo que protegen sus activos más valiosos.

DataSunrise: Tu Socio en Seguridad de AI

DataSunrise lidera en soluciones de seguridad para AI y LLM, proporcionando una Protección Integral en AI con Detección Avanzada de Amenazas, diseñada para entornos complejos de AI. Nuestra plataforma, rentable y escalable, sirve a organizaciones desde startups hasta empresas Fortune 500.

Experimenta nuestra Orquestación Autónoma de Seguridad y descubre cómo DataSunrise ofrece una Reducción Cuantificable del Riesgo en despliegues de AI. Programa tu demo para explorar nuestras capacidades integrales de seguridad en AI.