pgvector: Protegiendo datos de la exposición a través de incrustaciones vectoriales

El riesgo oculto de las incrustaciones vectoriales

Las incrustaciones vectoriales potencian las aplicaciones de GenAI, permitiendo la búsqueda semántica, los sistemas de recomendación y conocimientos impulsados por IA. En PostgreSQL, la extensión pgvector posibilita almacenar y consultar incrustaciones de alta dimensión de manera eficiente, mejorando las aplicaciones impulsadas por IA con una búsqueda rápida por similitud. Pero a pesar de ser solo números tras la incrustación, todavía pueden filtrar datos sensibles.

¿Pueden las incrustaciones vectoriales exponer realmente información sensible?

Las incrustaciones vectoriales funcionan como coordenadas en un espacio de alta dimensión: no contienen datos sensibles de forma directa, pero aún pueden ser explotadas para reconstruir patrones. Proteger la información sensible significa controlar lo que se introduce en las incrustaciones y monitorear cómo se realizan las consultas.

Si las incrustaciones se generan a partir de texto sin procesar que contiene información de identificación personal (PII), como nombres, números de seguro social o direcciones, el modelo puede codificar patrones que expongan dicha información de forma indirecta. Los atacantes pueden explotar búsquedas de vecinos más cercanos para reconstruir datos sensibles, lo que conduce a violaciones de cumplimiento y amenazas de seguridad.

Entonces, ¿pueden las incrustaciones vectoriales exponer realmente información sensible? Sí: la información sensible puede ser expuesta a través de las incrustaciones bajo ciertas circunstancias. Además, aunque las incrustaciones no almacenan datos sin procesar, la forma en que codifican las relaciones entre los puntos de datos implica que la información sensible podría inferirse con consultas ingeniosas. Dependiendo de cómo se generen las incrustaciones y qué información se utilice para crearlas, esto es lo que puede suceder:

🔍 Cómo la información sensible puede ser expuesta en las incrustaciones

1. Codificación Directa

- Si las incrustaciones se crean a partir de texto sin procesar que contiene información sensible (por ejemplo, números de seguro social, nombres o direcciones), el modelo puede codificar patrones que los revelen de forma indirecta.

➡️Ejemplo: Si SSN: 123-45-6789 forma parte del perfil de un empleado utilizado para la generación de incrustaciones, un modelo puede generar incrustaciones que, al consultarse de manera específica, podrían devolver vectores que se asemejan o correlacionan con patrones de datos sensibles.

2. Correlación Implícita de Datos

- Si las incrustaciones se entrenan con datos estructurados (por ejemplo, roles, salarios y departamentos de empleados), los patrones en estos datos podrían correlacionarse con la PII.

➡️Ejemplo: Si el número de seguro social de un empleado se utiliza en el entrenamiento vectorial junto con salario y departamento, un sistema de IA podría revelar detalles salariales al buscar incrustaciones similares.

3. Memorización por Modelos de IA

- Si un modelo de IA entrenado con datos sensibles genera incrustaciones, puede memorizar y regurgitar detalles específicos cuando se le solicita de manera ingeniosa.

➡️Ejemplo: Si las incrustaciones almacenan nombres y roles de empleados, un modelo podría recuperar vectores similares que contengan información personal al ser consultado sobre “empleados en finanzas que ganan más de $100K”.

4. Riesgos de Reconstrucción

- En algunos casos, las incrustaciones pueden ser sometidas a ingeniería inversa mediante ataques adversariales, reconstruyendo partes de los datos originales.

➡️Ejemplo: Si un atacante consulta el sistema con patrones de entrada específicos, podría extraer datos significativos de las incrustaciones.

🔓 Cómo la información sensible puede ser expuesta desde las incrustaciones

Atacantes o consultas no intencionadas pueden exponer PII a través de:

- Búsquedas de vecinos más cercanos – Encontrar las incrustaciones más próximas a patrones de datos sensibles.

- Agrupamiento de vectores – Agrupar incrustaciones similares para inferir detalles personales relacionados.

- Inyección de indicaciones – Engañar al sistema para que revele contenido sensible almacenado.

- Ataques adversariales – Explotar debilidades del modelo para reconstruir la entrada original.

Resumen

Sí, la información sensible puede filtrarse a las incrustaciones si se generan sin las medidas de seguridad adecuadas. Si un sistema de IA utiliza incrustaciones creadas a partir de datos sensibles sin procesar, podría devolver información similar cuando se consulta de forma inteligente.

Mejor práctica: Nunca incrustar campos sensibles sin procesar y siempre sanear los datos antes de la vectorización.

Técnicas para prevenir la filtración de PII a partir de incrustaciones vectoriales

1. Saneamiento de datos antes de la generación de incrustaciones

Antes de convertir los datos en incrustaciones vectoriales, elimina o transforma la información sensible para que nunca ingrese al espacio vectorial.

Eliminar campos PII – Evita incrustar datos sin procesar como números de seguro social, nombres y direcciones.

Generalizar datos – En lugar de almacenar salarios exactos, categorizarlos en rangos.

Tokenización – Reemplaza datos sensibles con identificadores no reversibles.

Ejemplo: En lugar de incrustar:

“John Doe, SSN: 123-45-6789, earns $120,000”

Almacenar: “Empleado X, gana entre $100K y $150K”

Esto asegura que la PII nunca ingrese al almacén vectorial en primer lugar.

2. Enmascaramiento de datos sensibles en consultas y respuestas

Incluso si se incrustan datos PII sin procesar o las incrustaciones codifican patrones relacionados con la PII, puedes enmascarar u ofuscar la información sensible durante la recuperación.

Enmascaramiento Dinámico de Datos – Redacta o transforma la salida sensible antes de que llegue a los usuarios.

Filtrado de consultas en tiempo real – Bloquea búsquedas de similitud no autorizadas sobre las incrustaciones.

Control de Acceso y Restricciones basadas en Roles – Limita el acceso a la búsqueda vectorial a usuarios de confianza.

Ejemplo: Si un usuario consulta las incrustaciones y recupera un fragmento de datos que contiene PII:

Salida original: “El salario de John Doe es $120,000”

Salida enmascarada: “El salario del Empleado X es $1XX,000”

Esto previene la exposición involuntaria de información sensible.

Enfoques proactivos vs. reactivos para la seguridad de datos en incrustaciones vectoriales

1️⃣ Seguridad proactiva – Aplicando la protección PII antes de la incrustación

Este enfoque asegura que la información sensible nunca ingrese a la incrustación vectorial en primer lugar.

¿Cómo?

Sanea los datos estructurados antes de la vectorización. ✅

Enmascara la información sensible antes de la incrustación. ✅

Utiliza la tokenización para reemplazar valores identificables. ✅

Aplica técnicas de privacidad diferencial para introducir ruido. ✅

Beneficio: Este enfoque elimina los riesgos en la fuente, haciendo imposible que las consultas sobre las incrustaciones revelen PII.

2️⃣ Seguridad reactiva – Auditoría y enmascaramiento después de la incrustación

Este enfoque asume que las incrustaciones ya contienen referencias a información sensible y se centra en detectar y enmascarar la PII durante la recuperación.

¿Cómo?

Detecta la información sensible utilizada en la creación de las incrustaciones. ✅

Aplica enmascaramiento en tiempo real antes de mostrar los datos recuperados. ✅

Restringe las consultas no autorizadas que accedan a las incrustaciones sensibles. ✅

Monitorea las consultas de similitud vectorial para detectar patrones anómalos de acceso. ✅

Beneficio: Incluso si la información sensible ya existe en las incrustaciones, este método asegura que nunca se exponga durante la recuperación.

🎯 ¿La mejor estrategia de seguridad? – Usa AMBOS

La seguridad más robusta proviene de combinar ambos métodos:

- Proactivo – el saneamiento previene la inclusión de datos sensibles en las incrustaciones.

- Reactivo – el monitoreo garantiza que las incrustaciones existentes no filtren PII.

Cómo DataSunrise asegura los datos detrás de la incrustación vectorial

DataSunrise ofrece una solución de seguridad integral para proteger los datos referenciados por las incrustaciones de pgvector antes y después de que sean creadas.

🛡️ Protección proactiva: Asegurando los datos fuente antes de la incrustación

Para organizaciones que manejan grandes cantidades de datos estructurados y no estructurados, DataSunrise ayuda mediante:

- Detectar PII antes de que forme parte de una incrustación.

- Enmascarar datos sensibles antes de la vectorización.

- Utilizar técnicas de anonimización de datos para eliminar detalles personales específicos.

Ejemplo: Antes de incrustar perfiles de clientes, DataSunrise puede analizar el almacenamiento de datos en busca de información sensible, eliminar números de seguro social, anonimizar direcciones y generalizar datos financieros, asegurando que la representación vectorial no contenga detalles privados.

🛡️ Protección reactiva: Asegurando los datos fuente con incrustaciones existentes y aplicaciones de IA

Si una aplicación de IA ya se ejecuta con incrustaciones que contienen referencias a datos sensibles, DataSunrise ofrece:

- Descubrimiento de datos sensibles para los datos utilizados en la creación de las incrustaciones.

- Enmascaramiento dinámico de los resultados sensibles de las consultas.

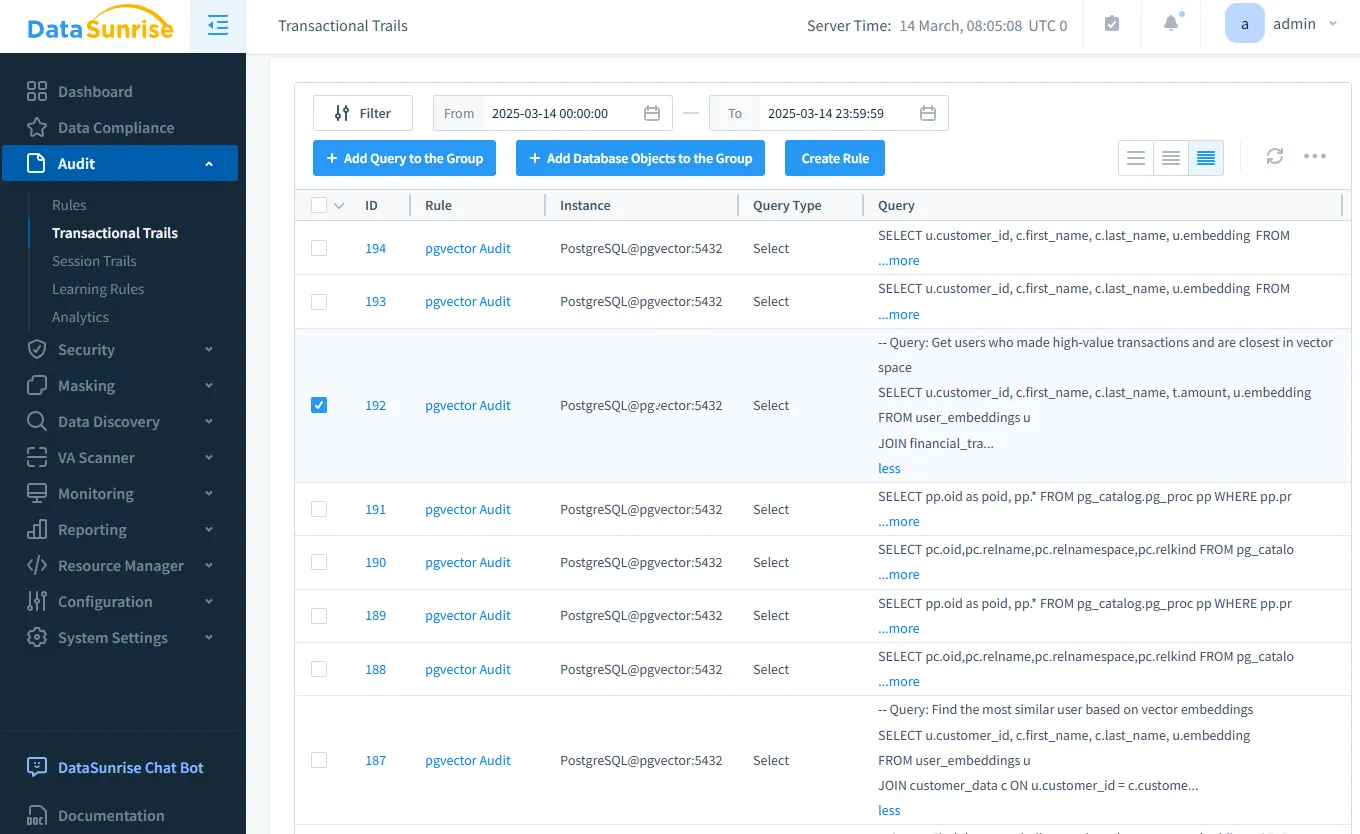

- Auditoría en tiempo real para detectar búsquedas vectoriales no autorizadas.

Ejemplo: Si un atacante intenta consultar incrustaciones de datos que puedan contener PII, DataSunrise rastrea y monitorea tales intentos y enmascara la información sensible antes de que se exponga.

La siguiente tabla ilustra el enfoque integral de DataSunrise para asegurar las incrustaciones vectoriales, abordando tanto la prevención como la detección de la exposición de datos sensibles:

| Característica | Protección Proactiva | Protección Reactiva |

|---|---|---|

| Descubrimiento de Datos | Identifica datos sensibles antes de la incrustación | Analiza las fuentes de las incrustaciones para detectar una posible exposición de PII |

| Auditoría de Datos | Registra la generación de incrustaciones | Detecta consultas sospechosas |

| Seguridad de Datos | Previene la inclusión de PII en las incrustaciones | Bloquea búsquedas vectoriales no autorizadas |

| Enmascaramiento de Datos | Oculta datos sensibles antes de la incrustación | Enmascara la información sensible durante la recuperación |

Conclusión: Un enfoque de seguridad de doble capa

Las incrustaciones vectoriales en pgvector son potentes, pero pueden exponer datos sensibles si no se manejan correctamente. El mejor enfoque es combinar técnicas de seguridad proactivas y reactivas para minimizar los riesgos.

🔹 Antes de que se creen las incrustaciones – Sanea, enmascara y controla el acceso a los datos.

🔹 Después de que existan las incrustaciones – Audita, monitorea y enmascara la PII en las respuestas de GenAI.

Para asegurar las incrustaciones vectoriales en PostgreSQL con pgvector, las organizaciones deben:

- ✅ Utilizar medidas proactivas para evitar que la PII ingrese a las incrustaciones.

- ✅ Implementar seguridad reactiva para monitorear y enmascarar la información recuperada.

- 🛡️ Aprovechar DataSunrise para detectar, proteger y prevenir la exposición de datos sensibles en cada etapa.

DataSunrise habilita ambas estrategias, asegurando que las aplicaciones impulsadas por IA se mantengan seguras y en cumplimiento. Ya sea que estés construyendo un nuevo sistema de IA o asegurando uno existente, DataSunrise proporciona protección integral para los datos vectorizados sensibles.

Al integrar las Características de Seguridad de DataSunrise, las empresas pueden utilizar sus datos para incrustaciones vectoriales sin arriesgar violaciones a la privacidad de los datos.

¿Necesitas asegurar tus datos de incrustaciones vectoriales? Agenda una demostración de DataSunrise hoy para proteger tus aplicaciones de GenAI!