Generative KI-Prüfung

Generative KI treibt rasante Innovationen in der Technologielandschaft voran und bildet die Grundlage für Tools wie OpenAIs ChatGPT, Amazon Bedrock und eine Welle neuer Plattformen. Während diese Technologien die Interaktion zwischen Mensch und Maschine neu definieren, werfen sie auch ernsthafte Datenschutzbedenken auf – insbesondere im Hinblick auf die Nutzung und Offenlegung von personenbezogenen Informationen (PII).

Dieser Artikel untersucht die weiterreichenden Implikationen generativer KI-Prüfungen und hebt wesentliche Datenschutzrisiken sowie Strategien zur Stärkung der Prüfung und Datensicherheitspraktiken hervor.

Die sich erweiternde Welt der generativen KI-Prüfung

Generative KI hat sich über eine einzelne Plattform hinaus entwickelt. Heute beobachten wir ein vielfältiges Ökosystem:

- ChatGPT von OpenAI: Eine konversationale KI, die zu einem Synonym für generative Fähigkeiten geworden ist.

- Amazon Bedrock: Ein vollständig verwalteter Dienst, der die einfache Integration von Grundmodellen in Anwendungen ermöglicht.

- Bard von Google: Ein experimenteller konversationaler KI-Dienst, angetrieben von LaMDA.

- Microsoft Azure OpenAI Service: Bietet Zugang zu den Modellen von OpenAI mit den zusätzlichen Sicherheits- und Unternehmensfunktionen von Azure.

Diese Plattformen bieten API-Zugang für Entwickler sowie webbasierte Schnittstellen für Benutzer. Dies erhöht das Risiko von Datenverstößen erheblich.

Datenschutzrisiken in der Landschaft der generativen KI

Die weit verbreitete Einführung generativer KI führt zu mehreren Datenschutzbedenken:

- Datenaufbewahrung: KI-Modelle könnten Eingaben zur Verbesserung speichern, was möglicherweise auch sensible Informationen umfasst.

- Unbeabsichtigte Informationsweitergabe: Benutzer könnten während der Interaktionen versehentlich personenbezogene Daten preisgeben.

- Modell-Ausbeutung: Komplexe Angriffe könnten theoretisch darauf abzielen, Trainingsdaten aus den Modellen zu extrahieren.

- Plattformübergreifende Datenaggregation: Die Nutzung mehrerer KI-Dienste könnte zu umfassenden Nutzerprofilen führen.

- API-Schwachstellen: Unsichere API-Implementierungen könnten Nutzerdaten offenlegen.

Allgemeine Strategien zur Minderung von Datenschutzrisiken

Um diese Bedenken auszuräumen, sollten Organisationen die folgenden Ansätze in Betracht ziehen:

- Datenminimierung: Begrenzen Sie die Menge an personenbezogenen Daten, die von KI-Systemen verarbeitet werden.

- Anonymisierung und Pseudonymisierung: Transformieren Sie Daten, um identifizierende Informationen zu entfernen oder zu verschleiern.

- Verschlüsselung: Setzen Sie eine starke Verschlüsselung für Daten während der Übertragung und im Ruhezustand ein.

- Zugriffskontrollen: Verwalten Sie strikt, wer auf KI-Systeme und gespeicherte Daten zugreifen kann.

- Regelmäßige Sicherheitsüberprüfungen: Führen Sie umfassende Überprüfungen der KI-Systeme und ihrer Datenhandhabungspraktiken durch.

- Benutzeraufklärung: Informieren Sie Benutzer über die Risiken und bewährten Praktiken beim Umgang mit KI.

- Compliance-Rahmenwerke: Richten Sie den Einsatz von KI nach Vorschriften wie DSGVO, CCPA und branchenspezifischen Standards aus.

Überprüfung generativer KI-Interaktionen: Schlüsselaspekte

Eine effektive Prüfung ist entscheidend für die Aufrechterhaltung von Sicherheit und Compliance. Wesentliche Aspekte sind:

- Umfassende Protokollierung: Erfassen Sie alle Interaktionen, einschließlich Benutzereingaben und KI-Antworten.

- Echtzeitüberwachung: Setzen Sie Systeme ein, die potenzielle Datenschutzverletzungen sofort erkennen und melden.

- Musteranalyse: Nutzen Sie maschinelles Lernen, um ungewöhnliche Nutzungsmuster zu identifizieren, die auf Missbrauch hindeuten könnten.

- Periodische Überprüfungen: Untersuchen Sie regelmäßig Protokolle und Nutzungsmuster, um die Einhaltung von Vorschriften zu gewährleisten und potenzielle Risiken zu identifizieren.

- Drittanbieter-Audits: Ziehen Sie externe Experten hinzu, um eine neutrale Bewertung Ihres KI-Einsatzes und der Sicherheitsmaßnahmen zu erhalten.

DataSunrise: Eine umfassende Lösung für KI-Prüfungen

DataSunrise bietet eine robuste Lösung für die Überprüfung generativer KI-Interaktionen über verschiedene Plattformen hinweg. Unser System integriert sich nahtlos in unterschiedliche KI-Dienste und bietet einen einheitlichen Ansatz für Sicherheit und Compliance.

Schlüsselkomponenten der KI-Prüflösung von DataSunrise:

- Proxy-Service: Fängt den Datenverkehr zwischen Benutzern und KI-Plattformen ab und analysiert ihn.

- Datenerkennung: Identifiziert und klassifiziert automatisch sensible Informationen in KI-Interaktionen.

- Echtzeitüberwachung: Bietet sofortige Warnungen bei potenziellen Datenschutzverletzungen.

- Audit-Protokollierung: Erstellt detaillierte, manipulationssichere Protokolle aller KI-Interaktionen.

- Compliance-Berichterstattung: Erstellt Berichte, die auf verschiedene regulatorische Anforderungen zugeschnitten sind.

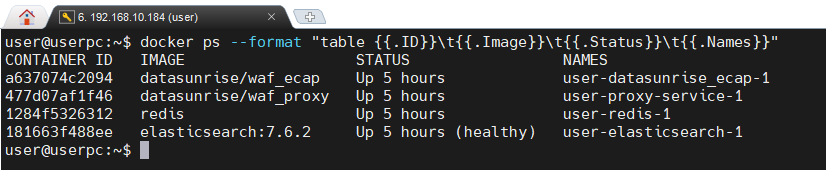

Das untenstehende Bild zeigt vier laufende Docker-Container. Diese Container bieten DataSunrise Web Application Firewall-Funktionalitäten und erhöhen die Sicherheit des dargestellten Systems.

Beispielaufbau mit DataSunrise

Eine typische DataSunrise-Bereitstellung für KI-Prüfungen könnte folgendes beinhalten:

- DataSunrise Proxy: Als Reverse-Proxy vor KI-Diensten eingesetzt.

- Redis: Für Caching und Sitzungsverwaltung, zur Leistungsverbesserung.

- Elasticsearch: Für effiziente Speicherung und Abruf von Audit-Protokollen.

- Kibana: Zur Visualisierung von Audit-Daten und Erstellung benutzerdefinierter Dashboards.

- DataSunrise Management Console: Zur Konfiguration von Richtlinien und zur Anzeige von Berichten.

Dieser Aufbau kann einfach unter Verwendung von Container-Orchestrierungstools wie Docker und Kubernetes bereitgestellt werden, was Skalierbarkeit und einfache Verwaltung gewährleistet.

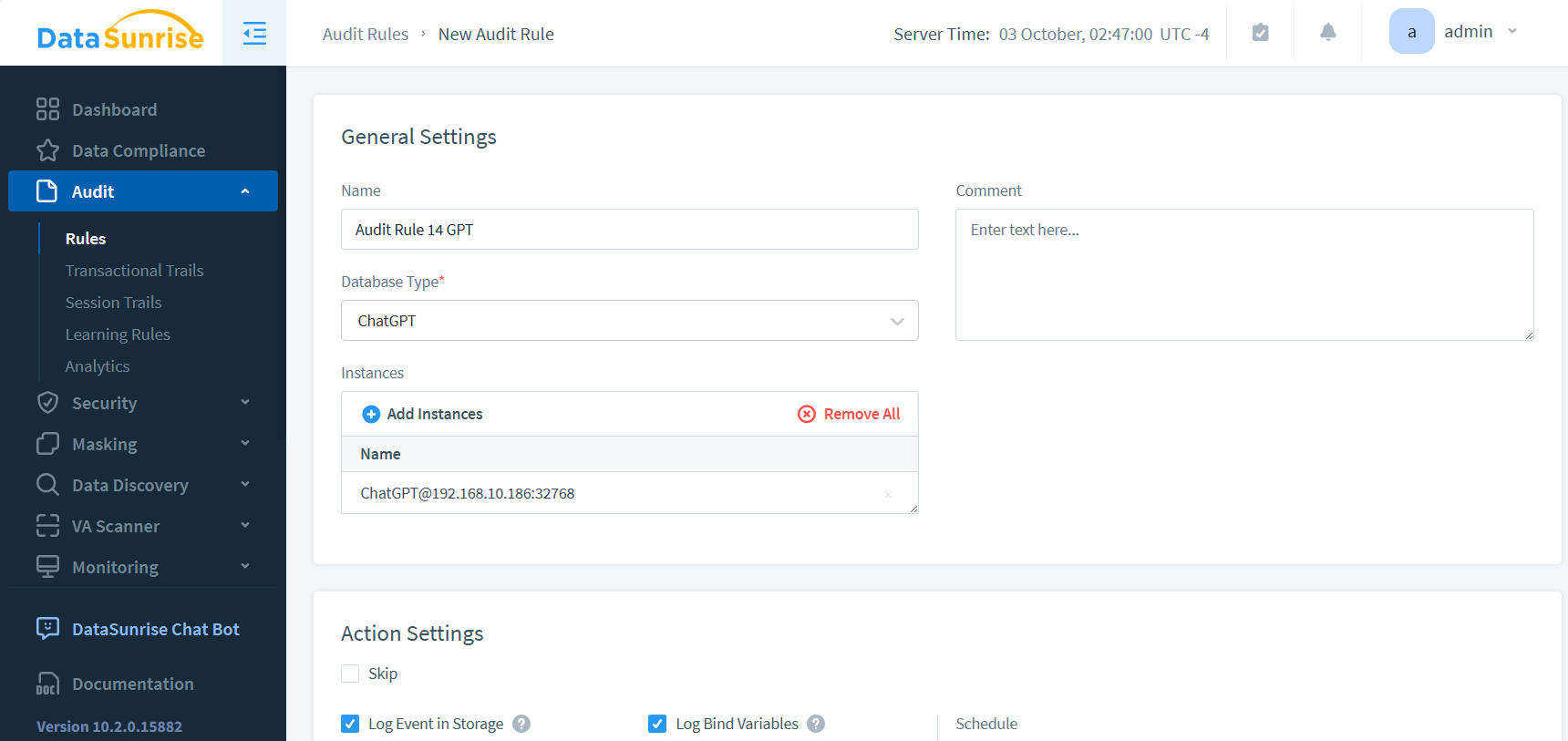

Das Einrichten von Audit-Regeln ist unkompliziert. In diesem Fall wählen wir die relevante Instanz aus, die nicht eine Datenbank, sondern vielmehr ChatGPT, eine Webanwendung darstellt. Dieser Prozess demonstriert die Flexibilität des Auditsystems im Umgang mit verschiedenen Arten von Anwendungen.

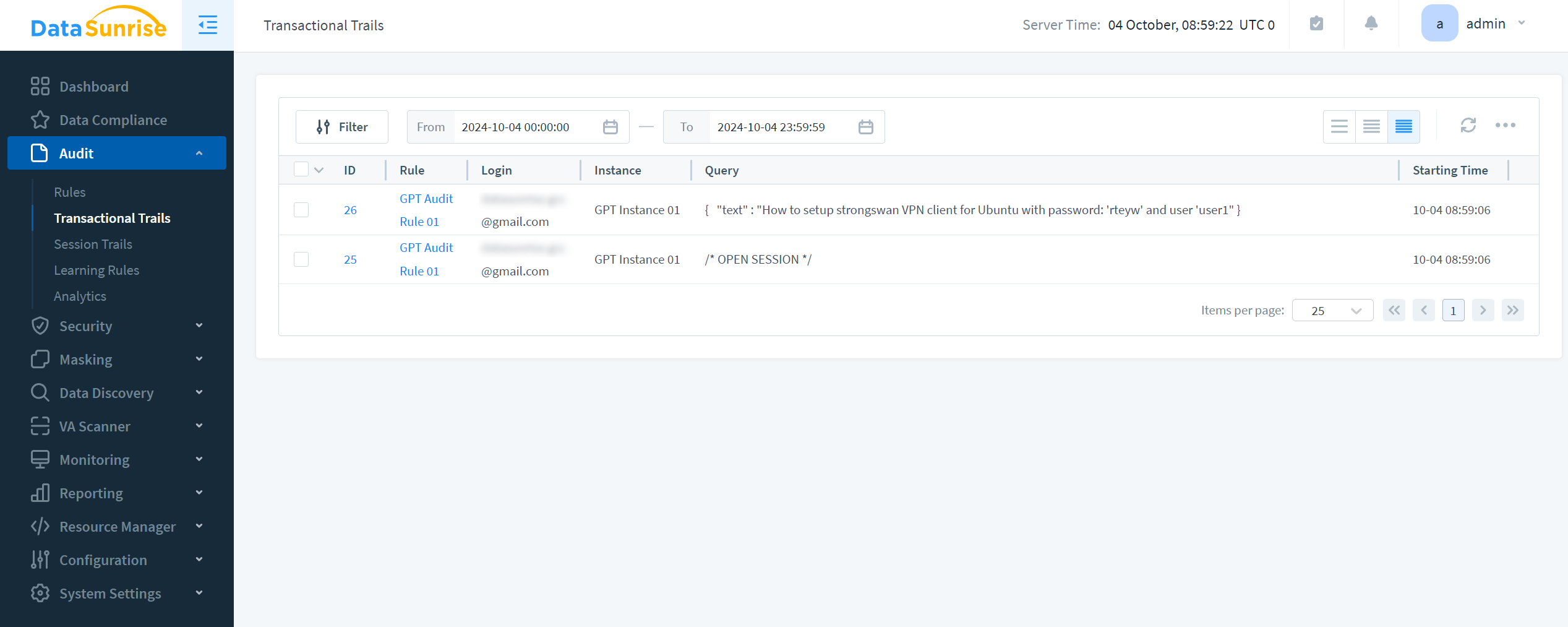

Die Prüfungsergebnisse und die entsprechende GPT-Eingabeaufforderung lauten wie folgt:

Fazit: KI mit Vertrauen annehmen

Generative KI wird zu einem Teil unseres täglichen Lebens und unserer Geschäftsabläufe. Mit fortschreitender Entwicklung benötigen wir starke Prüf- und Sicherheitsmaßnahmen, die unerlässlich sind, um Sicherheit zu gewährleisten.

Durch den Einsatz klarer Strategien und fortschrittlicher Tools von DataSunrise können Organisationen KI effektiv nutzen, Daten sicher verwalten und den Datenschutz gewährleisten.

Die Zukunft der KI ist vielversprechend, muss jedoch auf einem Fundament aus Vertrauen und Sicherheit aufgebaut sein. Durch den Einsatz angemessener Prüf- und Datenschutzmaßnahmen können wir das volle Potenzial der generativen KI erschließen und die Rechte sowie die Informationen von Einzelpersonen und Organisationen schützen.

DataSunrise: Ihr Partner in der KI-Sicherheit

DataSunrise führt im Bereich der KI-Sicherheit. Es bietet nicht nur Audit-Tools, sondern auch ein vollständiges Funktionsspektrum, das Ihre Daten auf verschiedenen Plattformen und in Datenbanken schützt.

Unsere Lösung passt sich den spezifischen Herausforderungen der generativen KI an und hilft Ihrer Organisation, möglichen Bedrohungen stets einen Schritt voraus zu sein.

Wir laden Sie ein, zu erkunden, wie DataSunrise Ihre KI-Sicherheitsarchitektur verbessern kann. Besuchen Sie die DataSunrise-Website, um eine Demo zu vereinbaren, und erfahren Sie, wie unsere fortschrittlichen Lösungen Sie bei der Verwaltung von KI-Governance und Datenschutz unterstützen können.