LLM Modelle für Cybersecurity Anwendungsfälle

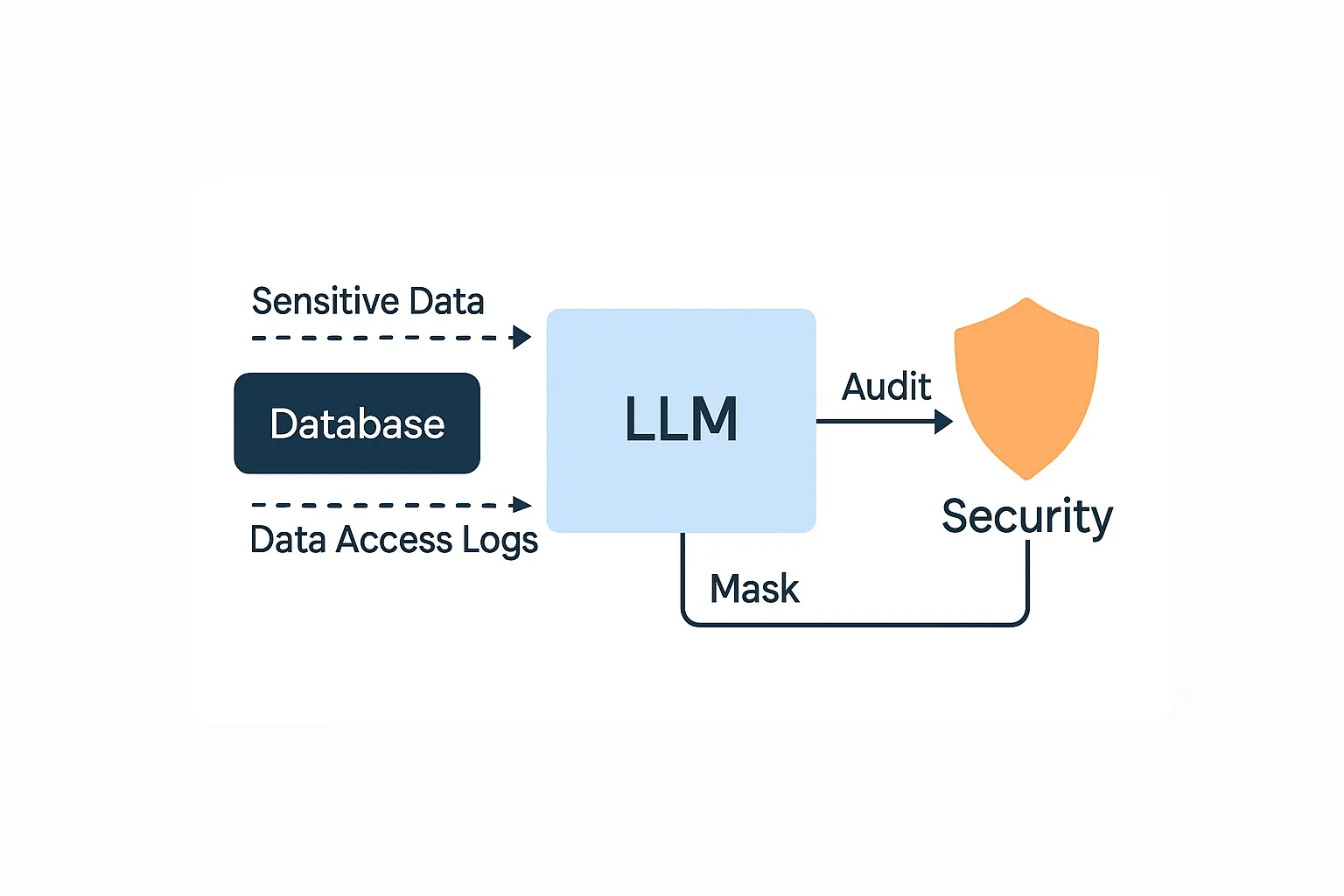

Große Sprachmodelle (LLMs) transformieren, wie Organisationen Cybersicherheit angehen. Ihre Fähigkeit, unstrukturierte Daten zu analysieren, den Kontext zu interpretieren und bei Entscheidungsprozessen zu unterstützen, macht sie zu wertvollen Werkzeugen zur Verbesserung von Echtzeit-Audits, dynamischer Datenmaskierung, Entdeckung und Compliance-Workflows.

Einführung in LLMs in der Cybersicherheit

Traditionelle Sicherheitswerkzeuge sind starr und regelbasiert. LLMs hingegen bringen Anpassungsfähigkeit, wie in diesem systematischen Review zu LLMs in der Cybersicherheit detailliert beschrieben. Sie interpretieren Protokolle und Abfragen in natürlicher Sprache, fassen das Benutzerverhalten zusammen und identifizieren Anomalien in strukturierten und unstrukturierten Daten.

Ihre Integration in Cybersecurity-Frameworks ermöglicht schnellere Reaktionszeiten, verbesserte Compliance-Berichterstattung und präzisere Zugriffsentscheidungen.

Echtzeit-Auditierung und LLM-Unterstützung

Echtzeit-Auditierung ist der Schlüssel zur proaktiven Bedrohungserkennung. LLMs können Audit-Workflows optimieren, indem sie Datenbankabfragen automatisch interpretieren, Alarmzusammenfassungen generieren und verdächtige Ereignisse in einfacher Sprache erklären.

SELECT user, action, table, event_time

FROM audit_log

WHERE action = 'DELETE' AND event_time > current_date - interval '1 day';

LLM-Ausgabe: “Benutzer X versuchte unbefugte Löschungen von Zahlungsdaten außerhalb genehmigter Zeiten.”

Dieser Ansatz ist besonders effektiv in Kombination mit detaillierten Audit-Protokollen und robusten Datenbankaktivitätsüberwachung, die Benutzerinteraktionen und Zugriffsmuster in Echtzeit verfolgen.

Dynamische Maskierung in GenAI-Pipelines

Dynamische Datenmaskierung stellt sicher, dass sensible Daten je nach Rolle und Kontext verborgen bleiben, und ihre Vorteile gegenüber der Tokenisierung werden in dieser vergleichenden Analyse erläutert. Wenn sie in Abfragesysteme integriert werden, erkennen LLMs die Absicht, auf sensible Felder zuzugreifen, wenden Maskierungsregeln dynamisch an und erklären Maskierungsentscheidungen im Kontext.

Diese Strategie stimmt gut mit den Prinzipien der dynamischen Datenmaskierung überein, bei der die Sichtbarkeit basierend auf Benutzerkontext und Absicht angepasst wird.

Datenerkennung mit LLMs

LLMs unterstützen die Datenerkennung, indem sie Felder basierend auf Inhalt und Kontext klassifizieren und kennzeichnen, was das Auffinden ungetaggter sensibler Daten, das Zuordnen von Datenflüssen und das Identifizieren von Schema-Lücken vereinfacht.

Dieser Prozess profitiert erheblich von Techniken der Datenerkennung, die LLMs nutzen, um das Schema-Verständnis zu vertiefen und sensible Daten in verschiedenen Umgebungen zu erkennen.

Automatisierung von Compliance- und Richtlinienprüfungen

LLMs unterstützen Compliance-Teams, indem sie regulatorische Rahmenwerke wie GDPR, HIPAA oder PCI-DSS interpretieren, die Umsetzung von Kontrollen zusammenfassen und Richtliniendokumentationen oder Nachweise zu Kontrollen entwerfen, wie in diesem mehrstufigen Compliance-Framework mit LLMs besprochen.

Die Integration mit dem Compliance Manager ermöglicht es, diese Aufgaben zu automatisieren und mit Audit-Trails in Einklang zu bringen.

Verwandt: GDPR-Compliance | Datenschutz-Compliance-Vorschriften

Vorfallreaktion und Zusammenfassung

Sicherheitsteams sind oft von Alarmmüdigkeit betroffen. LLMs können Protokolle zusammenfassen, anomale Aktivitäten hervorheben und basierend auf kontextuellen Bedrohungsmodellen Handlungsempfehlungen geben, ähnlich wie Ansätze wie Audit-LLM zur Erkennung von Insider-Bedrohungen.

Beispielabfrage:

SELECT * FROM cloudtrail_logs

WHERE eventName IN ('ConsoleLogin', 'CreateUser')

AND sourceIPAddress NOT IN (SELECT known_ips FROM whitelist)

AND eventTime > now() - interval '3 hours';

LLM-Zusammenfassung: “Drei Anmeldeversuche von neuen IPs deuten auf einen möglichen Missbrauch von Anmeldedaten hin.”

Praktische Einsatzmuster

| Muster | Zweck |

|---|---|

| SOC Copilot | Protokolle erklären und Handlungen vorschlagen |

| Data Governor | Sensible Daten identifizieren und kennzeichnen |

| Audit Summarizer | Lesbare Zusammenfassungen für Berichte erstellen |

| Data Classifier | Schemata basierend auf Feldsemantik anreichern |

| Threat Model Assistant | Szenarien modellieren, Kontrollen vorschlagen |

Bereitstellungsoptionen umfassen lokal feinabgestimmte Modelle oder gesicherten Zugriff auf verwaltete APIs wie Azure OpenAI oder AWS Bedrock, müssen jedoch Best Practices für den Umgang mit sensiblen Daten mit LLMs berücksichtigen.

Herausforderungen und Überlegungen

Obwohl vielversprechend, müssen LLMs mit Vorsicht eingesetzt werden. Es ist entscheidend, rohe personenbezogene Daten (PII) in Eingabeaufforderungen zu vermeiden, LLM-Ausgaben mit deterministischen Regeln zu kombinieren und alle modellgenerierten Sicherheitsempfehlungen zu validieren.

Um konform zu bleiben, nutzen Sie Tools wie DataSunrise Security Rules

Fazit

LLM-Modelle definieren neu, wie wir Cybersicherheit angehen. Von Echtzeit-Audits und dynamischer Maskierung bis hin zur Richtliniendurchsetzung und Vorfallreaktion ermöglichen sie intelligentere, schnellere und anpassungsfähigere Sicherheitsoperationen.

In Verbindung mit vertrauenswürdigen Plattformen wie DataSunrise helfen LLMs dabei, konforme und robuste Infrastrukturen zu schaffen, die für moderne Datenumgebungen geeignet sind.