Sicherheit von LLM-Agenten in RAG/RLHF-Szenarien

Große Sprachmodell-Agenten (LLM-Agenten) gewinnen in den Arbeitsabläufen der Retrieval-Augmented Generation (RAG) und des Reinforcement Learning from Human Feedback (RLHF) zunehmend an Bedeutung. Diese intelligenten Agenten verbessern das Kontextverständnis, automatisieren Datenflüsse und liefern adaptive Antworten. Allerdings führt ihre Integration in sensible Datenpipelines zu Sicherheits- und Compliance-Risiken, die proaktiv gemanagt werden müssen.

Sicherheitslücken durch LLM-Agenten

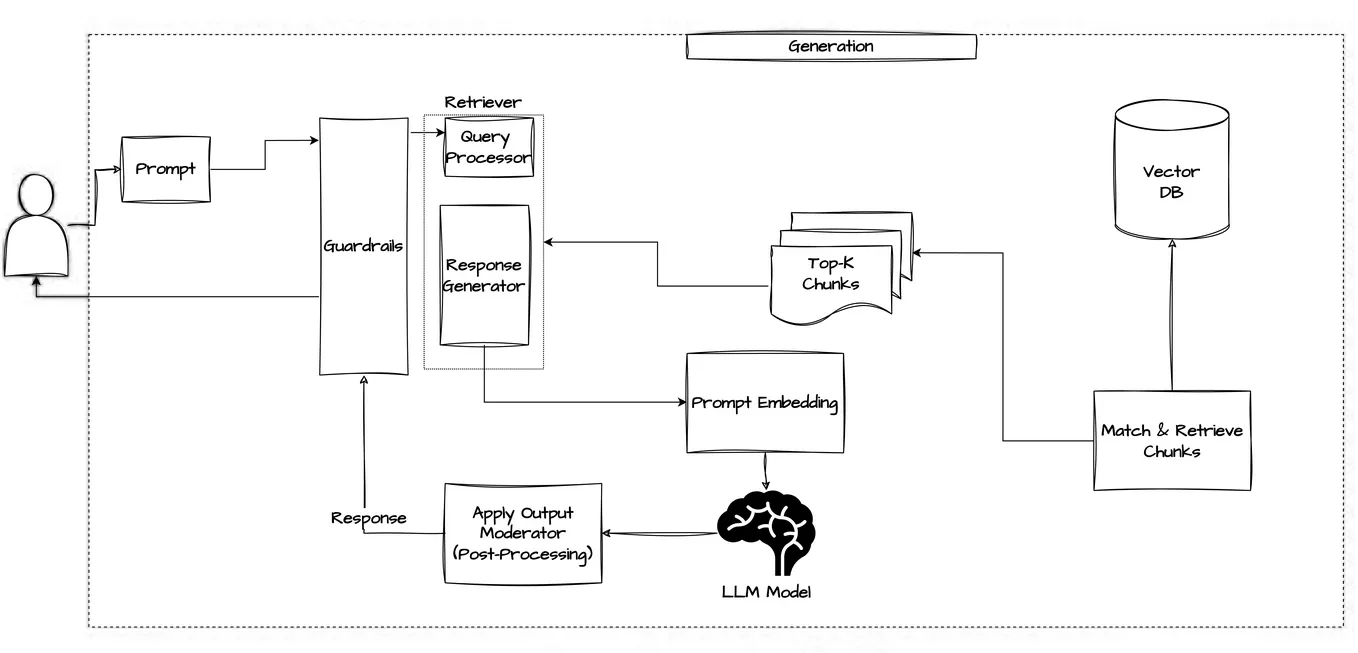

LLMs arbeiten oft mit heterogenen Daten, die in Echtzeit aus internen Repositorien und externen Wissensdatenbanken bezogen werden. In RAG-Arbeitsabläufen befragen die Agenten Vektor-Datenbanken und fügen den abgerufenen Kontext in die Eingabeaufforderungen ein. In RLHF-Pipelines interagieren sie mit menschlich gelabelten Trainingsdaten oder Feedback-Protokollen. Diese breite Angriffsfläche öffnet Risiken wie Prompt Injection, Datenlecks und die Replikation unregulierten Verhaltens.

Ohne angemessene Kontrollen können LLM-Agenten auf sensible Geschäftsdaten zugreifen und diese offenlegen, manipuliertes Feedback verbreiten oder mit nicht konformen Datensätzen interagieren. Diese Risiken erfordern kontinuierliches Monitoring, Datenmaskierung und Richtliniendurchsetzung in den LLM-Inferenz- und Feedback-Schleifen. Wie im Google’s sicheren KI-Systemdesign hervorgehoben wird, müssen diese Herausforderungen bereits auf der Design-Ebene proaktiv angegangen werden.

Echtzeit-Audit von LLM-Interaktionen

Um nachzuvollziehen, wie Agenten agieren und welche Daten sie berühren, ist ein Echtzeit-Audit unerlässlich. Dies umfasst das Nachverfolgen von Anfrageinhalten, Benutzer-Agent-Zuordnungen, abgerufenen Vektor-Ergebnissen, Prompt-Strukturen und den daraus resultierenden Abschlüssen. Die Protokollierung dieser Metadaten hilft, abnormales Verhalten zu erkennen, Entscheidungsprozesse nachzuvollziehen und die Einhaltung von HIPAA, GDPR und PCI DSS zu demonstrieren.

Lösungen wie die Data Audit-Plattform von DataSunrise ermöglichen dies durch anpassbare Audit-Regeln, die strukturierte und unstrukturierte Anfrageaktivitäten überwachen. Audit-Regeln können so konfiguriert werden, dass sie bestimmte Schlüsselwörter, Zugriffsversuche oder in Eingabeaufforderungen injizierte Vektor-Payloads kennzeichnen. Ebenso zeigt der Azure Monitor for LLMs von Microsoft, wie Laufzeitereignisse in großem Umfang protokolliert und visualisiert werden können.

Dynamische Datenmaskierung für GenAI-Pipelines

Die dynamische Datenmaskierung stellt sicher, dass sensible Felder wie Namen, E-Mail-Adressen oder Kontonummern zur Laufzeit ersetzt werden, bevor sie dem Modell übergeben werden. Dies ist besonders in RAG-Umgebungen von entscheidender Bedeutung, in denen ein Agent Daten abruft, die vertrauliche Attribute enthalten können.

Mithilfe der dynamischen Maskierung bleibt die ursprüngliche Quelldaten intakt, während verschiedene Benutzer oder Agententypen auf Basis ihrer Rolle oder des Kontexts angepasste Ansichten erhalten. Zum Beispiel:

SELECT full_name, credit_card FROM customers;

-- wird zu --

SELECT '***MASKED***' AS full_name, 'XXXX-XXXX-XXXX-1234' AS credit_card;

Dies schützt die Privatsphäre, während Modellinteraktionen mit realistischen, aber anonymisierten Datenpunkten ermöglicht werden. Die Maskierung ist auch ein wesentlicher Bestandteil der NIST-Richtlinien zur Risikominderung bei GenAI.

Datenentdeckung als Sicherheitsgrundlage

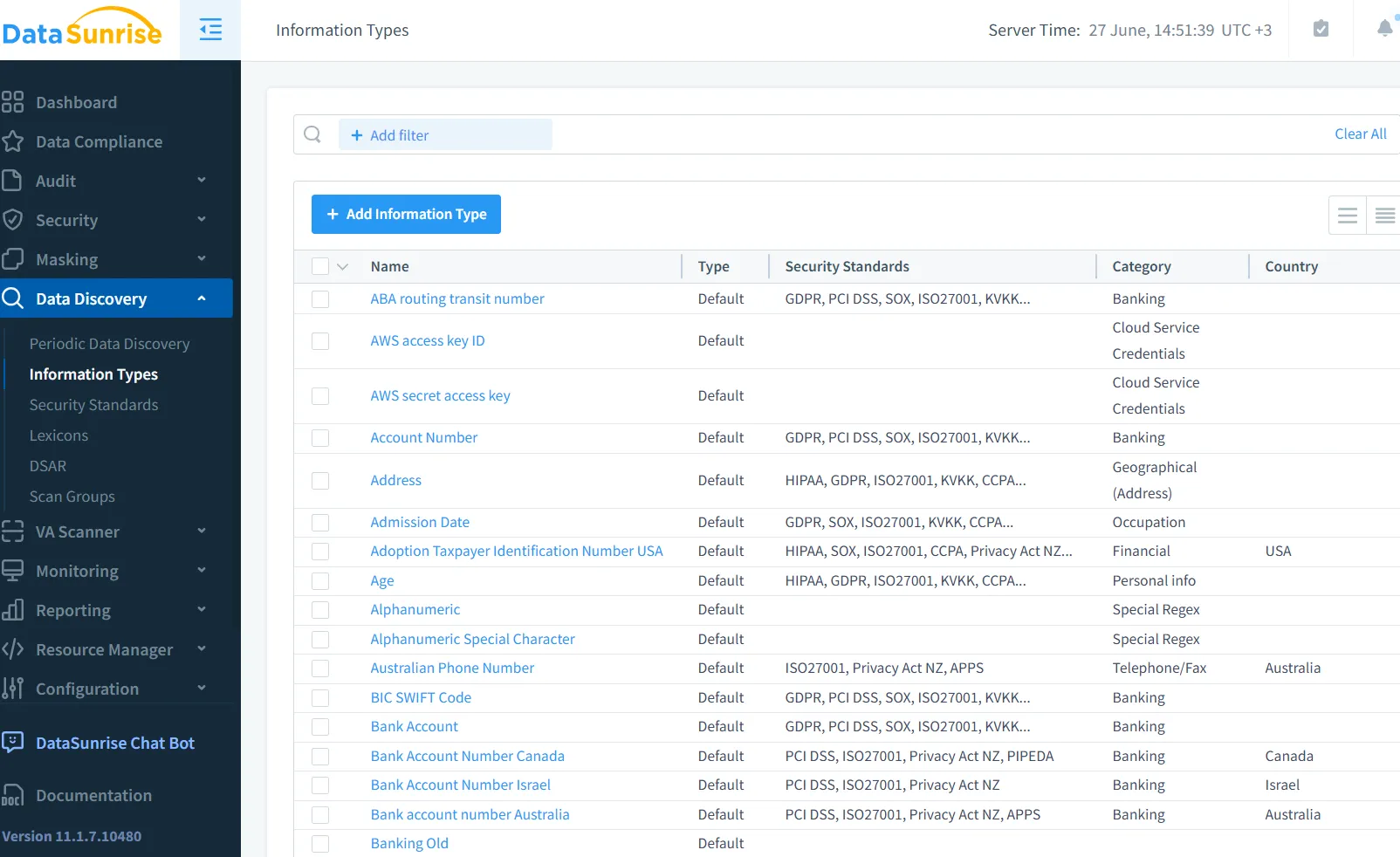

Bevor jegliche Maskierungs- oder Zugriffsrichtlinien durchgesetzt werden, ist es entscheidend, zu ermitteln, welche Daten wo gespeichert sind. Datenentdeckungstools können Datenbanken, Vektor-Speicher und unstrukturierte Protokolle nach sensitiven Datentypen durchsuchen. Dies ist besonders wertvoll beim Aufbau von LLMs auf veralteten Systemen, bei denen die Dokumentation begrenzt ist.

Die Discovery-Engine von DataSunrise unterstützt die Musterbasierte Klassifikation, Wörterbuchabgleiche und KI-gestützte Klassifikation neuartiger Datentypen. Sobald die Bestandsaufnahme erstellt wurde, informiert sie das Design der Richtlinien und hilft dabei, angemessene Maskierungs-, Protokollierungs- oder Alarmgrenzen festzulegen. Ebenso kann AWS Macie dabei helfen, sensible Daten in S3-Buckets zu identifizieren, die von Vektor-Abfragemechanismen genutzt werden.

Durchsetzung von Sicherheitsrichtlinien mittels Zugriffsregeln

Sicherheit muss auf mehreren Ebenen funktionieren: in der Datenbank, am API-Gateway und am Modell-Serving-Endpunkt. Die Definition und Durchsetzung von Zugriffsregeln – wie das Blockieren von unzuverlässigen IP-Adressen, die Einschränkung von Joins über Datenbereiche hinweg oder die Begrenzung der Prompt-Länge – hilft dabei, Missbrauch zu verhindern.

Die Sicherheitsregeln-Engine von DataSunrise ermöglicht es Teams, detaillierte Kontrollen gegen Injektion, Datenexfiltration oder Missbrauch zu etablieren. LLM-Agenten können auf eine Whitelist gesetzt oder rollenbasiert für bestimmte Abfragetypen freigegeben werden, wodurch ihre Fähigkeiten eingeschränkt und die Expositionsfläche minimiert wird.

Dies hilft auch, Angriffe durch Prompt Injection zu unterbinden, bei denen Agenten versuchen, ihre Beschränkungen zu überwinden, um auf interne Logik oder Daten zuzugreifen. Für weitere Informationen zur Abwehr solcher Angriffe siehe die OWASP LLM Top 10 Risiken.

Compliance-Mapping und kontinuierliche Absicherung

Da GenAI-Modelle zunehmend in Produktionssysteme integriert werden, nimmt auch die regulatorische Aufsicht zu. Die Abstimmung von LLM-Pipelines mit Compliance-Standards erfordert Datenklassifikation, Dokumentation, Nachverfolgung von Einwilligungen, Begrenzung von Datenexpositionen und regelmäßige Berichterstattung.

Der Compliance Manager von DataSunrise unterstützt dies, indem er Audit-Trails, Maskierungskonfigurationen und Rollenhierarchien in einer zentralen Compliance-Oberfläche verknüpft. Er bietet integrierte Vorlagen für HIPAA, PCI DSS, SOX und GDPR, was die internen Kontrollen sowie externe Audits vereinfacht.

Zudem sollten Sie die EU AI Act-Richtlinien konsultieren, um die entstehenden rechtlichen Verpflichtungen für Foundation-Modelle und KI-Systeme, die mit sensiblen oder regulierten Daten interagieren, zu verstehen.

Anwendung dieser Tools in RAG/RLHF-Arbeitsabläufen

In einem praktischen RAG-Szenario könnte ein LLM-Agent eine Vektorsuche nach juristischen Fällen mit einem bestimmten Gesetz initiieren. Der Vektor-Speicher kann sowohl öffentliche als auch interne juristische Dokumente enthalten. Um die Compliance zu wahren, kennzeichnet die Datenentdeckung sensible Datensätze, die Maskierung schwärzt Kundenkennungen, Audit-Protokolle erfassen den Kontext der Abfrage und Zugriffsregeln schränken unsichere Operationen ein.

In RLHF-Pipelines enthalten menschliches Feedback häufig vertrauliche Benutzerkommentare oder Labels. Diese müssen gemäß den Richtlinien angemessen maskiert, auditiert und gespeichert werden. Zum Beispiel illustriert das RLHF-Whitepaper von Anthropic, wie Feedback-Pipelines unter Berücksichtigung des Datenschutzes strukturiert sein sollten.

Letzte Gedanken

Die Sicherheit von LLM-Agenten in RAG/RLHF-Szenarien erfordert mehr als nur Modellanpassungen oder menschliche Validierungen. Die Echtzeit-Kontrolle über den Datenfluss – was abgerufen, maskiert und protokolliert wird – ist grundlegend. Durch die Kombination von Audit-Trails, Maskierungsstrategien, Discovery-Scans und Zugangskontrollen mit Compliance-Automatisierung können Organisationen sichere und verantwortungsvolle GenAI-Systeme einsetzen.

Erkunden Sie weitere Informationen zur Daten-Compliance-Automatisierung oder informieren Sie sich über LLM-orientierte Sicherheitswerkzeuge, um Ihre Infrastruktur für produktionsreife KI vorzubereiten.

Schützen Sie Ihre Daten mit DataSunrise

Sichern Sie Ihre Daten auf jeder Ebene mit DataSunrise. Erkennen Sie Bedrohungen in Echtzeit mit Activity Monitoring, Data Masking und Database Firewall. Erzwingen Sie die Einhaltung von Datenstandards, entdecken Sie sensible Daten und schützen Sie Workloads über 50+ unterstützte Cloud-, On-Premise- und KI-System-Datenquellen-Integrationen.

Beginnen Sie noch heute, Ihre kritischen Daten zu schützen

Demo anfordern Jetzt herunterladen