Minderung von KI-Sicherheitsrisiken

Da generative KI- (GenAI) Modelle ein integraler Bestandteil moderner Infrastrukturen werden, bringen sie neue Vektoren für Sicherheitsrisiken mit sich. Von halluzinierten SQL-Abfragen und unbeabsichtigten Datenlecks bis hin zu böswilliger Prompteinfügung verändert GenAI die Risikolandschaft. Traditionelle Sicherheitskontrollen bieten in Echtzeitumgebungen, in denen Modelle autonome Entscheidungen treffen, oft keinen ausreichenden Schutz. Dieser Artikel untersucht praxisnahe Strategien zur Minderung von KI-Sicherheitsrisiken durch mehrschichtige Abwehrmaßnahmen wie Echtzeit-Auditing, dynamische Maskierung, Datenerkennung und konsequente Durchsetzung von Compliance.

Warum GenAI einzigartige Sicherheitsherausforderungen darstellt

GenAI-Systeme arbeiten mit probabilistischer Logik, was bedeutet, dass sie auf Basis locker strukturierter Eingabeaufforderungen unvorhersehbare Ausgaben generieren können. Diese Ausgaben können sensible Kundendaten, personenbezogene Informationen (PII) oder Zugangsdaten enthalten, die während des Trainings erlernt oder in der Prompt-Verkettung aufgenommen wurden. Schlimmer noch, wenn Benutzer mit GenAI-Systemen interagieren, könnten sie unautorisiert Informationen extrahieren, sofern keine Schutzmaßnahmen implementiert sind.

Betrachten Sie einen Fall, bei dem ein GenAI-Agent SQL-Abfragen generiert, um Kundeneinkaufsdaten zu analysieren. Ein böswilliger Prompt könnte ihn dazu verleiten, Folgendes auszuführen:

SELECT * FROM customers WHERE ssn IS NOT NULL;

Wenn diese Abfrage Sicherheitsregeln umgeht, könnten sensible Datensätze offengelegt werden. Aus diesem Grund sind kontextuelle Analysen und dynamische Steuerungsmechanismen entscheidend, um Missbrauch zu verhindern.

Ein weiteres Beispiel könnte Versuche beinhalten, das Datenbankschema auszulesen:

SELECT table_name FROM information_schema.tables WHERE table_schema = 'public';

Dies könnte Tabellenstrukturen offenlegen, die für spätere Angriffe nützlich sind.

Echtzeit-Auditing für KI-Systeme

Echtzeit-Auditing ist die erste Verteidigungslinie bei GenAI-Einsätzen. Es erfasst und protokolliert Interaktionen, Abfragen und daraus resultierende Aktionen, um Missbrauch oder Verstöße gegen Richtlinien zu identifizieren. Audit-Trails spielen auch eine entscheidende Rolle bei der forensischen Analyse und der Reaktion auf regulatorische Anforderungen.

Tools wie DataSunrises Audit Rule Engine ermöglichen es Unternehmen, spezifische Auslöser für Abfragen, die über GenAI-Agenten initiiert werden, zu definieren. In Kombination mit Datenbank-Aktivitätsüberwachung bieten diese Protokolle Einblick in das Zusammenspiel der Modelle mit strukturierten und unstrukturierten Datenquellen.

Hier ist ein Beispiel für ein Protokollierungsmuster:

WHEN query_text LIKE '%ssn%' THEN log_event;

Dynamische Maskierung als sicherer Schutzmechanismus für KI

Einer der effektivsten Wege, um die Preisgabe sensibler Daten zu verhindern, besteht darin, Ausgaben in Echtzeit dynamisch zu maskieren. Im Gegensatz zur statischen Maskierung, die Daten im Ruhezustand modifiziert, arbeitet die dynamische Maskierung “on-the-fly”. Das bedeutet, dass sensible Felder wie Kreditkartennummern, nationale Ausweise oder Adressen durch Platzhalterwerte ersetzt werden, wenn über KI-gesteuerte Schnittstellen darauf zugegriffen wird.

DataSunrise unterstützt dynamische Maskierungsrichtlinien, die rollen-, abfragekontext- oder anwendungsbezogen definiert werden können. In Kombination mit LLM-Schnittstellen stellen diese Richtlinien sicher, dass das Modell nur maskierte Daten erhält, selbst wenn ein Prompt versucht, auf eingeschränkte Felder zuzugreifen.

Beispiel für eine dynamische Maskierungsregel:

MASK COLUMN customers.credit_card USING 'XXXX-XXXX-XXXX-####';

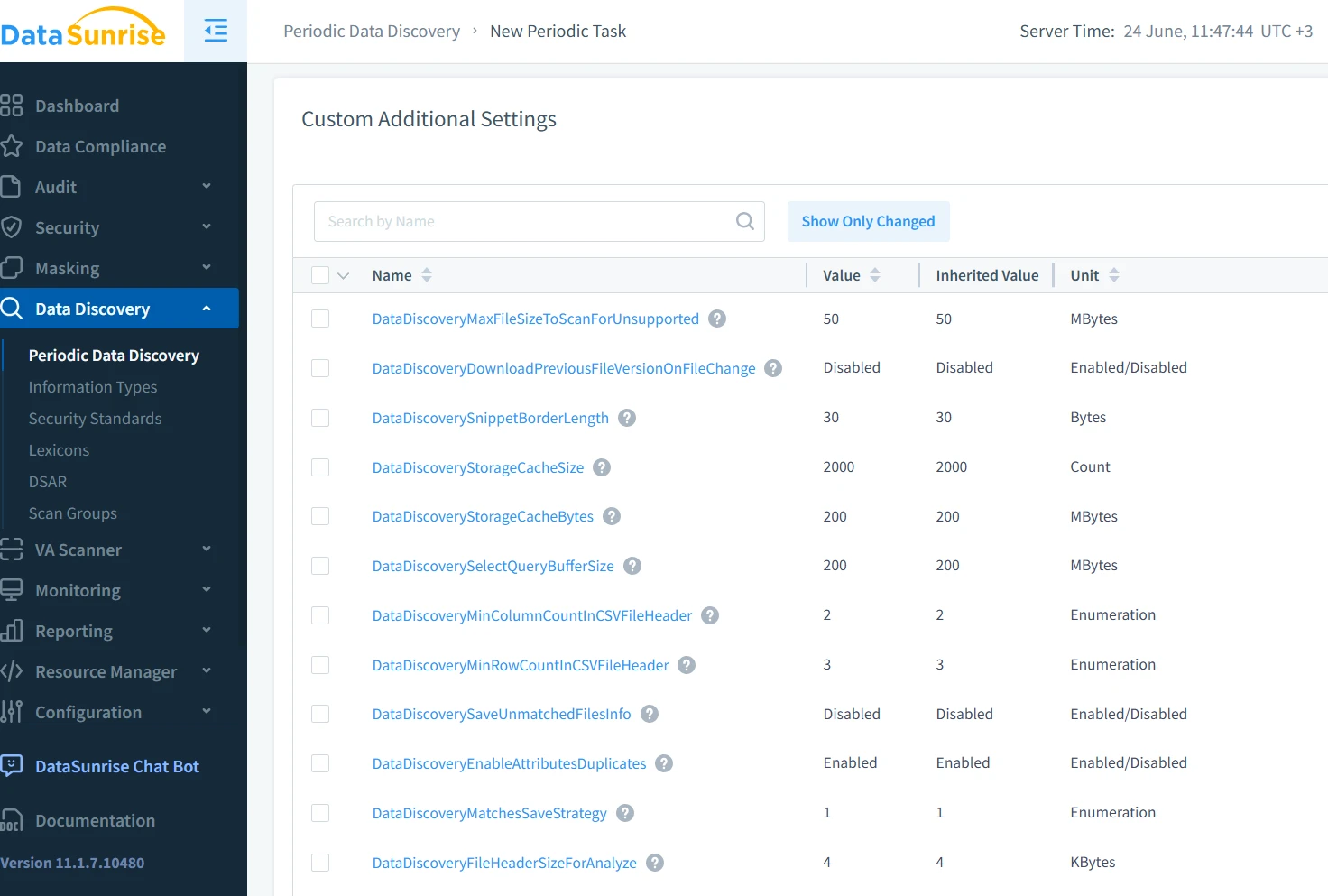

Datenerkennung für die Abbildung sensibler KI-Zugriffe

Bevor Sie Daten vor Missbrauch durch GenAI schützen können, müssen Sie wissen, wo sie sich befinden. Datenerkennungstools identifizieren und klassifizieren sensible Datensätze in Datenbanken, Data Lakes und Dateisystemen. Dies umfasst sowohl strukturierte Felder (wie Name und E-Mail) als auch semi-strukturierte Muster (wie Logs und Chat-Transkripte).

Automatisierte Datenerkennung hilft dabei, kontextbezogene Sensitivitätskarten zu erstellen, die Zugriffspolitiken informieren und die Grenzen der Modellinteraktion definieren. Dieser proaktive Ansatz stellt sicher, dass sowohl Entwickler als auch Auditoren verstehen, auf welche Daten das KI-System während der Laufzeit zugreifen könnte.

Ein einfacher Scan könnte beispielsweise E-Mails mittels Regex identifizieren:

[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Za-z]{2,}

Durchsetzung von Sicherheit und Compliance

KI-Sicherheit geht nicht nur darum, Datenlecks zu verhindern; sie umfasst auch die Einhaltung gesetzlicher und regulatorischer Standards. Rahmenwerke wie GDPR, HIPAA und PCI-DSS erwarten mittlerweile kontinuierlichen Datenschutz, rollenbasierte Zugriffskontrollen und prüfbare Protokolle – Anforderungen, die ebenso für KI-gesteuerte Systeme gelten.

Die Integration einer Compliance-Automatisierungsplattform sorgt für die Echtzeitverfolgung und Durchsetzung dieser Standards in allen Benutzerinteraktionen, einschließlich GenAI-Sitzungen. So können Unternehmen Richtlinien wie das Prinzip der minimalen Rechtevergabe umsetzen, den Umfang sensibler Daten begrenzen und eine nachgelagerte Rückverfolgbarkeit sicherstellen.

Beispiel für eine rollenbasierte Einschränkung:

GRANT SELECT ON orders TO analyst_role;

REVOKE SELECT ON customers FROM analyst_role;

Mithilfe von automatisierten Compliance-Berichten können Sicherheitsteams prüfungsreife Protokolle erstellen, die jede KI-Interaktion mit regulierten Daten detailliert darstellen und so den manuellen Aufwand sowie menschliche Fehler bei Sicherheitsprüfungen reduzieren.

Kombination von Maßnahmen für eine verteidigungsbasierte Tiefenabsicherung

Jeder dieser Mechanismen – Echtzeit-Auditing, Maskierung, Datenerkennung und Compliance – bietet einen Teil des Schutzes. Doch in Kombination bilden sie eine mehrschichtige Verteidigung, die weitaus robuster ist. Dies ist besonders wichtig in GenAI-Kontexten, in denen keine einzelne Maßnahme das Risiko vollständig vorhersagen oder verhindern kann.

Stellen Sie sich folgenden Ablauf vor: Ein LLM initiiert eine SQL-Abfrage; das System protokolliert die Anfrage, erzwingt die Maskierung von PII-Feldern, filtert die Daten und protokolliert die Interaktion. Parallel dazu überprüfen Compliance-Engines Verstöße gegen Richtlinien. Dieser ganzheitliche Ansatz mindert Risiken, ohne Innovationen zu behindern.

Externe Praktiken und Zukunftsausblick

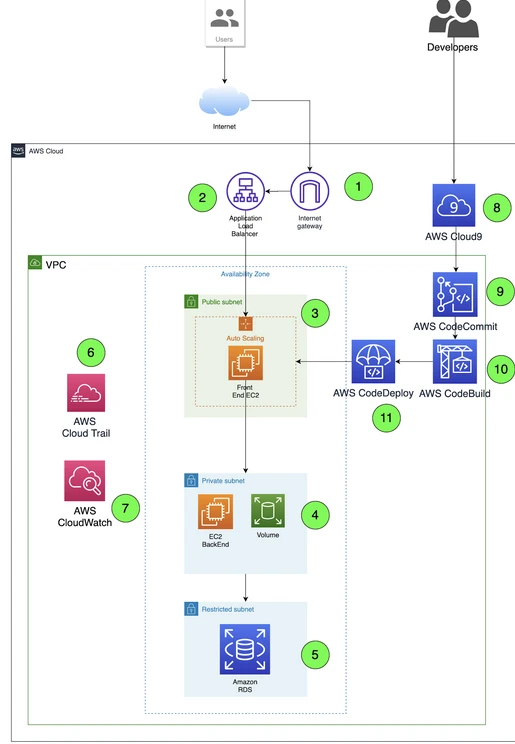

Neben plattforminternen Schutzmechanismen entwickeln sich auch Best Practices von Cloud-Anbietern wie AWS Macie und SecurityHub, um den Herausforderungen im Zusammenhang mit GenAI gerecht zu werden. Diese Dienste integrieren sich mit Tools wie Lake Formation oder CloudTrail, um die Nutzung sensibler Daten sowie das Benutzerverhalten in KI-Workflows zu überwachen.

Mit der Weiterentwicklung der KI-Sicherheit müssen sich auch die eingesetzten Werkzeuge weiterentwickeln. Die Herausforderung ist nicht nur technischer Natur, sondern auch philosophisch. Wie sichern wir Systeme, die selbstständig denken und sich anpassen? Es beginnt mit Bewusstsein, geeigneten Tools und einer proaktiven Richtliniengestaltung.

Fazit

GenAI transformiert Branchen, verändert aber zugleich die Bedrohungslandschaft. Die Minderung von KI-Sicherheitsrisiken erfordert mehr als herkömmliche Firewalls oder Benutzerrollen – sie verlangt eine kontextbewusste, mehrschichtige Strategie. Echtzeit-Audits, dynamische Maskierung, Datenerkennung und automatisierte Compliance-Tools wie die von DataSunrise sind essenziell, um KI-gestützte Infrastrukturen zu sichern, ohne deren Potenzial einzuschränken.