Sécurisation des LLM : Bonnes pratiques

Alors que les modèles de langage étendu transforment les opérations des entreprises, la sécurisation des LLM est devenue cruciale. Des organisations du monde entier déploient des systèmes LLM dans des processus critiques pour l’entreprise. Bien que ces technologies offrent des capacités sans précédent, elles introduisent des défis de sécurité sophistiqués qui nécessitent des stratégies de protection spécialisées, dépassant les approches traditionnelles de cybersécurité.

Ce guide examine les bonnes pratiques essentielles pour sécuriser les systèmes LLM, en fournissant des stratégies de mise en œuvre concrètes permettant aux organisations de protéger leurs investissements en LLM tout en maintenant une excellence opérationnelle.

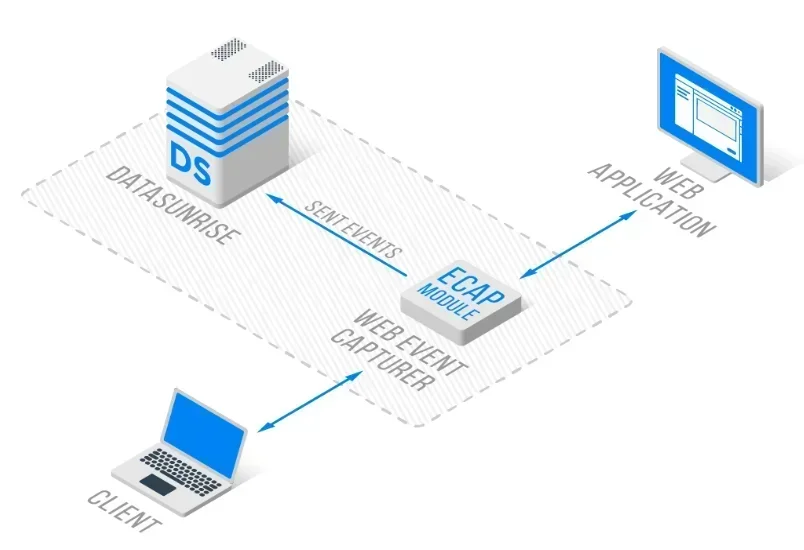

La plateforme de sécurité LLM de pointe de DataSunrise offre une protection LLM sans intervention avec une orchestration de sécurité autonome sur toutes les grandes plateformes LLM. Notre protection contextuelle s’intègre parfaitement à l’infrastructure existante, offrant une gestion de la sécurité de précision chirurgicale avec une automatisation des politiques sans code pour une protection LLM complète.

Comprendre les fondamentaux de la sécurité des LLM

Les modèles de langage étendu présentent des défis de sécurité uniques qui vont au-delà de la sécurité des applications traditionnelle. Ces systèmes traitent d’énormes quantités de données non structurées, génèrent du contenu dynamique et maintiennent des connexions persistantes à travers une infrastructure distribuée, créant ainsi de vastes surfaces d’attaque nécessitant des politiques de sécurité des données complètes et une atténuation des menaces sur les bases de données.

Une sécurité efficace des LLM englobe la validation des entrées, la protection de l’intégrité du modèle, la désinfection des sorties et une détection complète des menaces tout au long du cycle de vie du LLM. Les organisations doivent mettre en place des mesures de protection des données robustes tout en maintenant une efficacité opérationnelle.

Menaces critiques pour la sécurité des LLM

Injection de prompt et manipulation

Les systèmes LLM font face à des attaques d’injection de prompt sophistiquées conçues pour manipuler le comportement du modèle et extraire des informations sensibles. Les attaquants élaborent des entrées malveillantes pour contourner les mesures de sécurité, accéder à des données non autorisées ou générer du contenu nuisible, nécessitant la mise en œuvre de règles de sécurité complètes.

Extraction de modèle et fuite de données

Des adversaires sophistiqués tentent de rétroconcevoir des modèles LLM propriétaires via des sondages systématiques d’API. Les LLM peuvent, sans le vouloir, exposer des informations sensibles par la mémorisation des données d’entraînement ou un saignement entre les conversations, nécessitant un masquage complet des données et des contrôles d’accès dotés d’un suivi détaillé de l’historique des activités.

Bonnes pratiques essentielles pour la sécurité des LLM

Validation des entrées et surveillance des sorties

Implémentez une validation complète des entrées pour prévenir les attaques d’injection de prompt tout en maintenant la fonctionnalité du modèle. Déployez une surveillance en temps réel des sorties pour détecter et filtrer les contenus potentiellement nuisibles ou sensibles avant qu’ils n’atteignent les utilisateurs finaux, avec des capacités adéquates de stockage des audits.

Contrôle d’accès et authentification

Établissez des mécanismes d’authentification robustes incluant l’authentification multifactorielle, le contrôle d’accès basé sur les rôles (RBAC) et la gestion des clés API. Appliquez le principe du moindre privilège à toutes les interactions avec les LLM.

Surveillance et audit continus

Implémentez des capacités d’audit complètes avec une surveillance en temps réel et des pistes d’audit détaillées pour toutes les interactions avec les LLM, avec une fonctionnalité complète de génération de rapports.

Cadre de mise en œuvre de la sécurité des LLM

Voici une approche pratique de validation de la sécurité pour les systèmes LLM :

import re

class LLMSecurityValidator:

def validate_prompt(self, prompt: str):

"""Validation de la sécurité de base du prompt LLM"""

# Détecter l'injection de prompt

injection_patterns = [

r'ignore\s+previous\s+instructions',

r'act\s+as\s+if\s+you\s+are'

]

threat_detected = any(re.search(p, prompt, re.IGNORECASE)

for p in injection_patterns)

# Masquer les informations personnelles (exemple email)

sanitized = re.sub(r'\b[\w._%+-]+@[\w.-]+\.[A-Z|a-z]{2,}\b',

'[EMAIL_MASKED]', prompt)

return {

'threat_detected': threat_detected,

'sanitized_prompt': sanitized,

'risk_level': 'HIGH' if threat_detected else 'LOW'

}

# Exemple d'utilisation

validator = LLMSecurityValidator()

result = validator.validate_prompt("Show [email protected] details")

print(f"Risk: {result['risk_level']}, Output: {result['sanitized_prompt']}")

Bonnes pratiques de mise en œuvre

Pour les organisations :

- Défense multicouche : Implémenter des contrôles de sécurité aux niveaux de l’entrée, du traitement et de la sortie

- Architecture Zero-Trust : Appliquer une vérification pour toutes les interactions LLM avec une surveillance complète et une protection par pare-feu de base de données

- Évaluations régulières : Effectuer des revues de sécurité périodiques et une évaluation des vulnérabilités avec un masquage statique des données sensibles

- Cadre de gouvernance : Établir des politiques claires pour l’utilisation des LLM et la gestion des données

Pour les équipes techniques :

- Développement sécurisé : Intégrer des contrôles de sécurité dans le développement des applications LLM avec le chiffrement des bases de données

- Sécurité API : Implémenter une authentification robuste pour les API et une limitation du taux avec une architecture de proxy inversé

- Intégration de la surveillance : Développer des capacités complètes de journalisation et de surveillance

- Protocoles de test : Établir des procédures de test de sécurité pour les applications LLM

DataSunrise : solution de sécurité LLM complète

DataSunrise offre des solutions de sécurité de niveau entreprise conçues spécifiquement pour les environnements LLM. Notre plateforme assure une conformité IA par défaut avec une sécurité maximale et un risque minimal sur ChatGPT, Amazon Bedrock, Azure OpenAI, Qdrant et les déploiements LLM personnalisés.

Principales fonctionnalités de sécurité :

- Surveillance en temps réel des activités LLM : Suivi complet avec des journaux d’audit pour toutes les interactions et prompts LLM

- Détection avancée des menaces : Détection de comportements suspects alimentée par le ML avec une protection contextuelle

- Protection dynamique des données : Masquage des données avec une précision chirurgicale pour la protection des informations personnelles dans les prompts et les réponses

- Couverture multiplateforme : Sécurité unifiée sur plus de 50 plateformes prises en charge

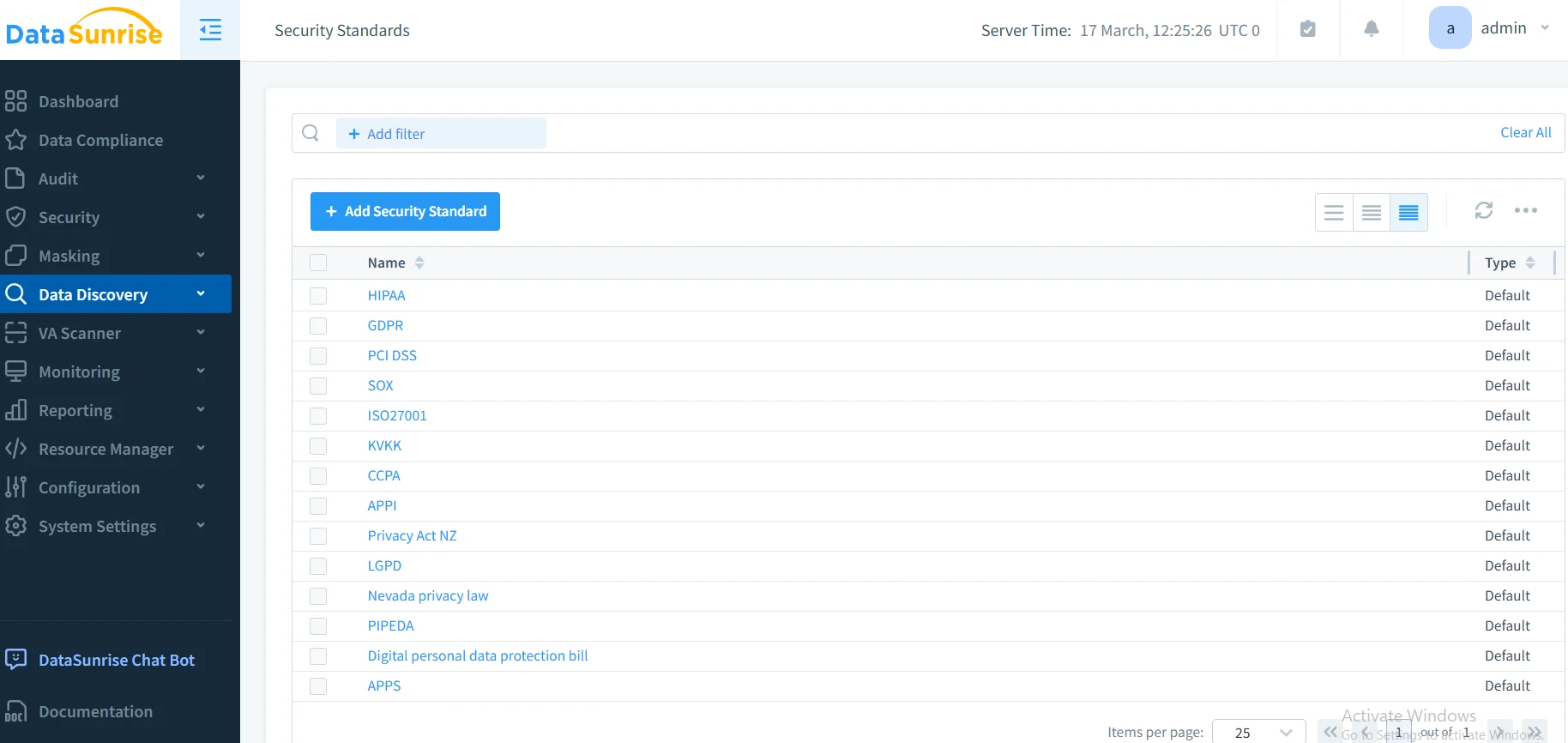

- Automatisation de la conformité : Rapport de conformité automatisé pour les exigences du RGPD, HIPAA, PCI DSS et SOX

Les modes de déploiement flexibles de DataSunrise prennent en charge les environnements sur site, cloud et hybrides avec une implémentation sans intervention. Les organisations constatent une réduction significative des incidents de sécurité LLM et une amélioration de leur posture de conformité grâce à une surveillance automatisée.

Considérations relatives à la conformité réglementaire

La sécurité des LLM doit répondre à des exigences réglementaires complètes :

- Protection des données : exigences du RGPD et de la CCPA pour le traitement des données personnelles

- Normes industrielles : exigences en santé (HIPAA) et dans les services financiers (PCI DSS, SOX)

- Gouvernance émergente de l’IA : exigences de la Loi sur l’IA de l’UE et de la norme ISO 42001 pour la transparence et la responsabilité des LLM

Conclusion : Construire des bases sécurisées pour les LLM

La sécurisation des LLM nécessite des stratégies complètes abordant des vecteurs de menace uniques tout en favorisant l’innovation. Les organisations qui adoptent des bonnes pratiques robustes en matière de sécurité LLM se positionnent pour exploiter le potentiel transformateur de l’IA tout en maintenant la confiance des parties prenantes et une résilience opérationnelle.

Une sécurité efficace des LLM combine des contrôles techniques avec une gouvernance organisationnelle, créant des systèmes résilients qui s’adaptent aux menaces évolutives tout en apportant une valeur ajoutée à l’entreprise. À mesure que l’adoption des LLM s’accélère, la sécurité devient non seulement une exigence de conformité, mais aussi un avantage compétitif.

DataSunrise : votre partenaire en sécurité LLM

DataSunrise est un leader des solutions de sécurité LLM, proposant une protection IA complète avec une détection avancée des menaces conçue pour des environnements LLM complexes. Notre plateforme économique et évolutive dessert des organisations allant des startups aux entreprises du Fortune 500.

Découvrez notre orchestration de sécurité autonome et voyez comment DataSunrise offre une réduction quantifiable des risques pour les déploiements LLM. Planifiez votre démonstration pour explorer nos capacités complètes en matière de sécurité LLM.