Journal d’Audit MySQL

Les équipes de sécurité considéraient autrefois le journal d’audit MySQL comme une réflexion lente et encombrante — quelque chose que l’on compresse avec gzip une fois par semaine au cas où un auditeur demanderait des preuves le trimestre suivant. En 2025, la piste d’audit est le cœur battant de la chaîne de sécurité des bases de données : diffusée en temps réel, masquée à la volée, enrichie par l’IA Générative, et vérifiée automatiquement contre chaque clause pertinente de conformité. Cet article montre comment élever le simple journal pour atteindre ce standard moderne, avec des recettes pour MySQL natif, un guide pour DataSunrise.

Pourquoi le journal d’audit est toujours important

Chaque compromission laisse des traces à trois endroits : le réseau, le système d’exploitation et la base de données. Seul le journal de la base de données capture l’intention — la commande réelle DELETE FROM customers, et pas seulement un scan de port suspect. Les régulateurs tels que PCI DSS 4.0 et l’Article 30 du RGPD exigent désormais que ces événements soient conservés, infalsifiables, et régulièrement examinés. Cette exigence est lourde à gérer sauf si vous automatisez tout ce qui suit la collecte.

Diffusion en continu en priorité, lecture en fin

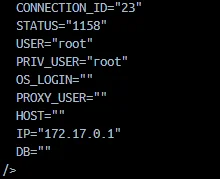

Le sondage basé sur disque fait arriver les alertes avec plusieurs minutes ou heures de retard. Passez le plugin en mode diffusion asynchrone et écrivez directement vers Apache Kafka ou Amazon Kinesis :

INSTALL PLUGIN audit_log SONAME 'audit_log.so';

SET GLOBAL audit_log_strategy = 'ASYNCHRONOUS';

SET GLOBAL audit_log_handler = 'FILE';

SET GLOBAL audit_log_file = 'stream://kafka:9092/mysql_audit';

Dès cet instant, chaque connexion, commande DDL et DML est disponible pour votre SIEM en une seconde. Si votre SOC consomme déjà le topic Kafka utilisé par l’équipe réseau, vous pouvez corréler « pic inhabituel sur le port 3306 » avec « échec de connexion root » sans écrire de code d’intégration. Des bonnes pratiques du journal d’audit recommandent de diffuser tôt pour éviter les goulets d’étranglement.

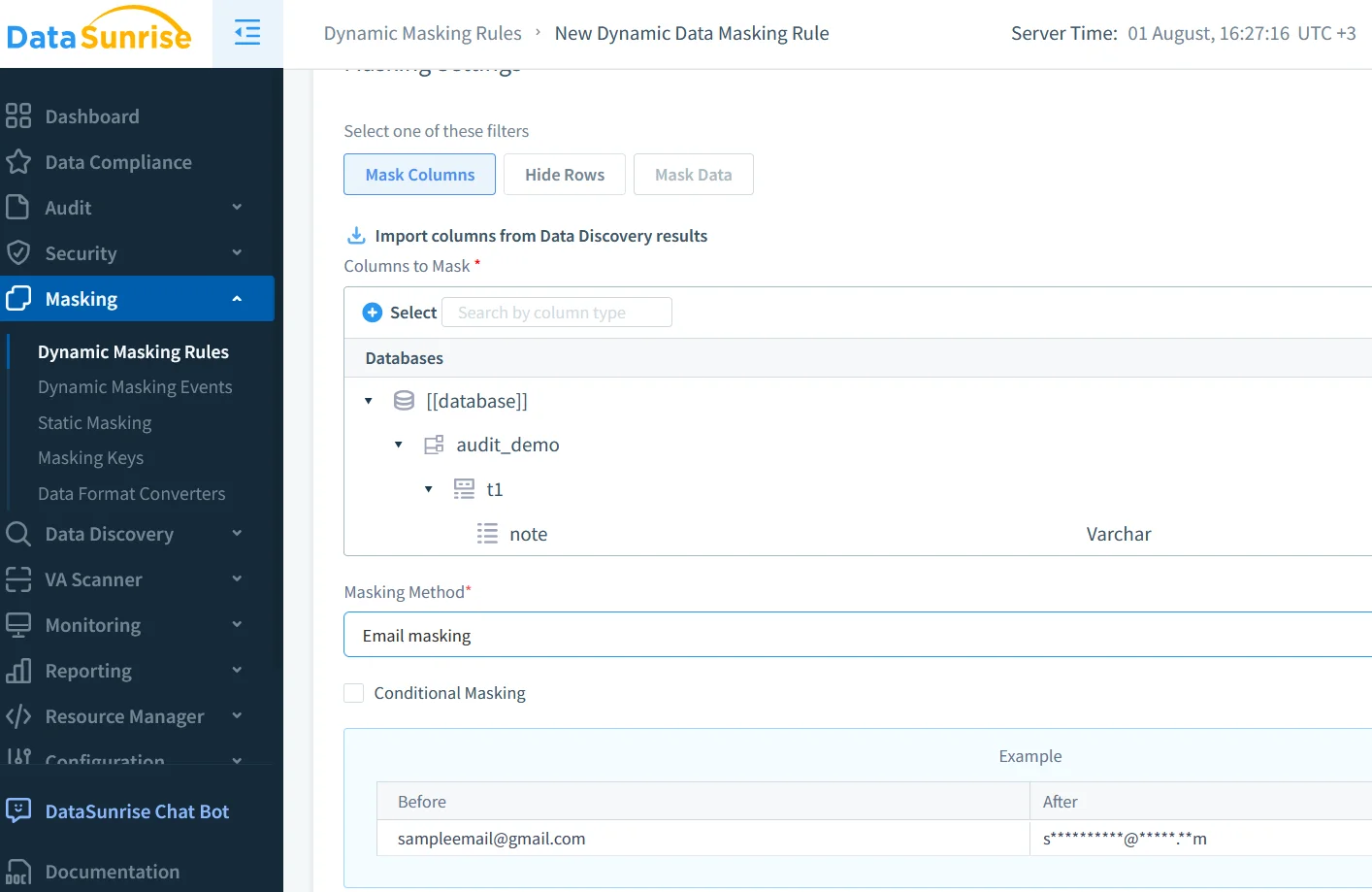

Masquage dynamique & découverte automatique des données

La sécurité ne concerne pas seulement qui a accédé à la base, mais aussi ce qu’il a vu. Acheminerez le même flux en temps réel via le moteur de masquage dynamique des données de DataSunrise. Le proxy remplace les numéros de carte bancaire par des jetons conservant le format dès qu’une session ne possède pas le rôle « PCI-Access ». Les étiquettes de sensibilité au niveau de la colonne proviennent de crawlings nocturnes alimentés par la découverte de données de DataSunrise; si un développeur déploie une table nommée insurance_claims à 02h00, elle est étiquetée comme « PHI » à 03h05 et masquée à la requête suivante.

Les valeurs masquées incluent des filigranes par somme de contrôle, ainsi votre tableau de bord BI voit « 4111‑XXXX‑1111‑1111 » – valide selon Luhn, mais un faux numéro – et vos analystes peuvent continuer à travailler. La décision de masquage elle-même est enregistrée et diffusée, maintenant un contexte complet pour la forensique et la conformité.

GenAI transforme le bruit en récit

Les grands modèles de langage excellent à résumer des JSON répétitifs. Un worker Python de quarante lignes peut transformer dix mille événements bruts en un paragraphe adapté à Slack :

from openai import OpenAI

client = OpenAI()

prompt = f"Vous êtes un assistant en sécurité informatique. Résumez les anomalies :\n{events_json}"

summary = client.chat.completions.create(

model="gpt-4o-mini",

messages=[{"role": "user", "content": prompt}]

).choices[0].message.content

Les équipes collent ce résumé directement dans Jira, réduisant le temps moyen de traitement des incidents de plusieurs heures à quelques minutes. Parce que le modèle LLM se situe après le masquage, aucune information personnelle (PII) de production ne parvient jamais à GenAI.

Audit natif MySQL en profondeur

La documentation officielle du plugin MySQL Audit Log décrit en détail l’architecture et les options. Utilisez des filtres (voir la référence des règles de filtrage du journal d’audit) pour enregistrer tout sauf les commandes SELECT exécutées par reporting :

CALL audit_log_filter_set_filter(

'reporting_app',

'SI user = "reporting" ALORS RETOURNER FALSE; SINON RETOURNER TRUE; FIN SI'

);

CALL audit_log_user_set_filter('reporting','reporting_app');

SET GLOBAL audit_log_format = 'JSON';

SET GLOBAL audit_log_policy = 'ALL';Vérifiez le résultat avec :

SELECT *

FROM mysql.audit_log

ORDER BY event_time DESC

LIMIT 5;

Parce que la configuration vit dans SQL, vous pouvez la placer sous contrôle de version, l’appliquer via des pipelines CI/CD, et revenir en arrière si nécessaire.

Renforcer le journal lui-même

Les attaquants aiment « effacer leurs traces » en supprimant des lignes dans la table de journal. Défendez cette piste en envoyant les événements dans un bucket S3 verrouillé en mode WORM (Write‑Once‑Read‑Many), ou en prenant des snapshots du système de fichiers toutes les cinq minutes avec des drapeaux immuables.

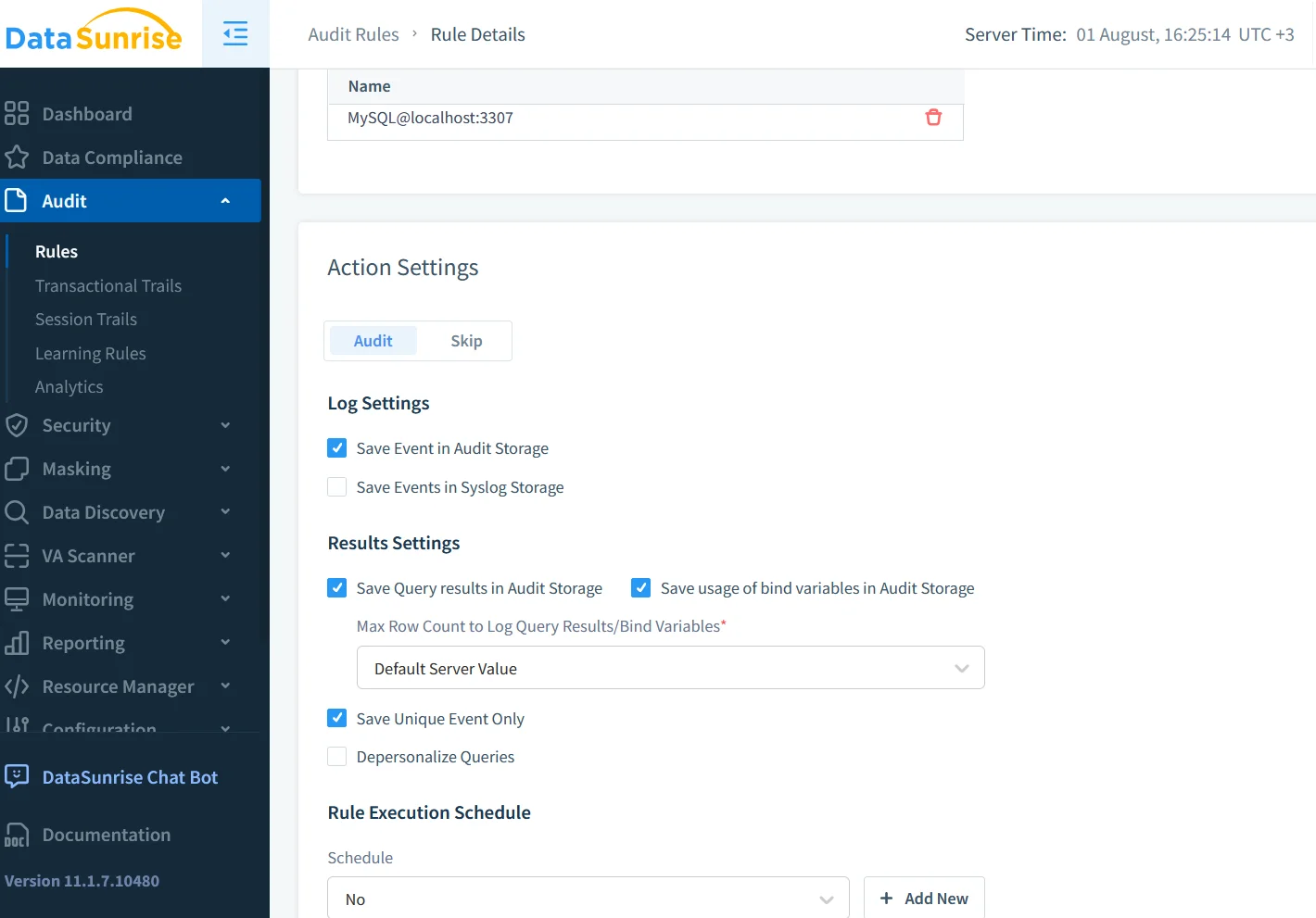

Pourquoi ajouter DataSunrise ?

Un utilisateur malveillant avec le privilège SUPER peut décharger le plugin ; un proxy transparent ne peut pas être désactivé depuis l’intérieur de la base. Ajouter DataSunrise vous donne une seconde piste d’audit stockée indépendamment et des contrôles riches à l’exécution.

Si une requête viole une politique, DataSunrise envoie une alerte via son intégration Slack en quelques secondes, complète avec les valeurs avant et après.

Pilotage automatique de la conformité

La bibliothèque de contrôles RGPD et les modèles PCI DSS de DataSunrise associent des événements d’audit spécifiques aux clauses réglementaires, tandis que le plus large tableau de bord Compliance Manager attache des preuves prêtes à l’emploi à chaque contrôle. Les auditeurs repartent satisfaits et vous évitez la spirale infernale des recherches de preuves de dernière minute.

Exemple de recherche de menace : accès PII en dehors des heures de bureau

SELECT *

FROM mysql.audit_log

WHERE JSON_EXTRACT(audit_record,'$.user') NOT IN ('svc_backup','replication')

AND HOUR(event_time) NOT BETWEEN 7 AND 19

AND JSON_EXTRACT(audit_record,'$.command_class') = 'select'

AND JSON_EXTRACT(audit_record,'$.object.name') IN ('patients','credit_cards');

Planifiez cette requête en tâche nocturne ou alimentez le flux Kafka dans une règle Grafana Loki qui se déclenche dès que le nombre dépasse un seuil.

Instantané d’architecture

- MySQL génère le journal d’audit MySQL via le plugin intégré.

- Les événements sont diffusés vers Kafka ; un deuxième chemin écrit des objets immuables sur S3.

- DataSunrise proxy applique le masquage et publie des événements enrichis étiquetés par sensibilité.

- Un micro-service GenAI résume les anomalies et ouvre des tickets Jira lorsque le risque ≥ 0.8.

Désactivez n’importe quelle couche et les enquêteurs ont toujours des indices dans une autre.

Réflexions finales

Hier, le journal d’audit était un artefact statique. Aujourd’hui, c’est un signal de sécurité en direct enrichi par GenAI et recoupé avec des dizaines de cadres de conformité. Commencez par diffuser le journal d’audit MySQL, ajoutez masquage et automatisation selon les besoins, et laissez les machines faire la partie ennuyeuse — vos analystes vous en remercieront.