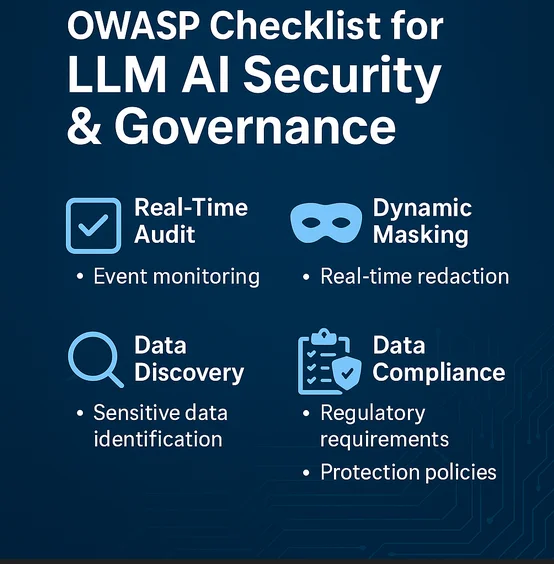

Liste de Contrôle OWASP pour la Sécurité et la Gouvernance de l’IA LLM

Alors que l’utilisation des grands modèles de langage (LLMs) s’étend dans les cadres de sécurité et de gouvernance d’entreprise, la Fondation OWASP a commencé à mettre en lumière des domaines critiques. Cet article explore l’application pratique de la Liste de Contrôle OWASP pour la Sécurité et la Gouvernance de l’IA LLM, en se concentrant particulièrement sur l’audit en temps réel, le masquage dynamique des données, la découverte des données, la sécurité générale des données et la conformité réglementaire.

Pourquoi la Liste de Contrôle OWASP est Importante pour les Systèmes d’IA Générative

Les LLM tels que GPT-4 et Claude sont intégrés dans des outils qui analysent les journaux, classent les menaces ou automatisent la réponse aux incidents. Cependant, ces modèles introduisent de nouveaux risques, notamment des attaques par inversion de modèle, l’injection de requêtes, la fuite de données sensibles et l’utilisation abusive des référentiels de données internes. Le Top 10 OWASP pour les LLM fournit un cadre permettant d’identifier et de réduire ces risques. L’intégration de ce cadre dans la gouvernance d’entreprise garantit que l’IA générative reste un atout, et non une responsabilité.

Audit en Temps Réel de l’Activité de l’IA et des Chaînes Décisionnelles

Les LLM fonctionnent souvent comme des boîtes noires. Consigner les requêtes des utilisateurs, les complétions générées, les décisions du modèle et les recherches de données en arrière-plan est essentiel pour l’audit. Des systèmes d’audit en temps réel tels que DataSunrise Audit peuvent intercepter et enregistrer :

SELECT *

FROM vector_logs

WHERE embedding_model = 'GPT-4' AND confidence_score < 0.5;

Cette requête d'exemple peut mettre en évidence des sorties du modèle incertaines ou à faible confiance pour examen. Des systèmes tels que la Surveillance de l'Activité de la Base de Données permettent de marquer et d'alerter en fonction de schémas d'utilisation inhabituels ou d'un accès à des magasins de vecteurs sensibles.

Masquage Dynamique dans les Requêtes Pilotées par les LLM

Lorsqu'un LLM génère dynamiquement des requêtes SQL, il y a une réelle probabilité qu'il expose des données sensibles. L'utilisation du masquage dynamique permet de s'assurer que même si une requête déclenche une opération de récupération de données, les informations personnelles identifiables (IPI) telles que les e-mails ou les numéros de sécurité sociale restent obfusquées.

Par exemple :

SELECT name, MASK(email), MASK(phone_number)

FROM customers

WHERE interaction_type = 'chatbot';

Cela permet aux systèmes pilotés par l'IA générative de fonctionner en toute sécurité dans des applications orientées client sans enfreindre les obligations de confidentialité.

Découverte des Données et Filtrage des Entrées des LLM

Une découverte des données efficace aide à identifier quelles parties de l'entrepôt de données ou du magasin de vecteurs contiennent des enregistrements sensibles. Lorsqu'elle est combinée aux pipelines LLM, cela garantit que les requêtes d'entrée ne récupèrent pas ou n'injectent pas de contexte non autorisé.

OWASP recommande la classification et le filtrage des données d'entraînement ainsi que des entrées en temps réel pour atténuer les fuites de données. Des outils tels qu'Amazon Macie, le moteur de découverte de DataSunrise et le balayage des métadonnées de vecteurs jouent un rôle essentiel.

Alignement avec les Politiques de Sécurité et les Modèles de Menaces

Selon les directives OWASP, la surface de menace des LLM inclut des API exposées, des plug-ins de tiers, une configuration de modèle peu sécurisée et un accès à la base de données trop permissif. La gouvernance devrait inclure :

Limiter le contexte de sortie du modèle via des requêtes système.

Imposer le contrôle d'accès basé sur les rôles (RBAC).

Bloquer les requêtes dangereuses à l'aide d'un pare-feu de base de données.

OWASP recommande également l'analyse comportementale pour détecter le submersion ou l'abus des requêtes.

Assurer la Conformité des Données dans l'Utilisation de l'IA Générative

La conformité reste centrale lorsque l'IA générative interagit avec des données protégées (RGPD, HIPAA, PCI DSS). Un gestionnaire de conformité pour les pipelines d'IA générative aide à cartographier :

Quels types de données sont traités par le modèle.

Si les sorties sont stockées ou enregistrées.

Si les informations déduites peuvent réidentifier les utilisateurs.

En pratique, cela implique de configurer des rapports de conformité automatisés et de combiner les informations issues de la piste d'audit avec des règles de masquage et de filtrage.

Points de Référence Externes

Plusieurs ressources externes abordent également l'intersection entre l'IA générative et la gouvernance des données :

Cadre de Gestion des Risques de l'IA du NIST pour une gouvernance structurée.

Norme d'IA Responsable de Microsoft pour les déploiements de grands modèles.

Directives AWS sur la surveillance Athena et le masquage pour les ensembles de données accessibles par l'IA.

Cela peut compléter les principes OWASP et aider à établir une sécurité holistique du cycle de vie de l'IA.

Conclusion

La Liste de Contrôle OWASP pour la Sécurité et la Gouvernance de l'IA LLM est bien plus qu'un document de politique. C'est un plan pour réduire les risques alors que l'IA générative s'intègre aux opérations de sécurité, à la surveillance de la conformité et à la prise de décision. Avec des outils tels que DataSunrise Audit, le masquage dynamique et les moteurs de découverte des données, les organisations peuvent imposer des limites sur le comportement de l'IA tout en bénéficiant de sa puissance.

La gouvernance des données doit évoluer parallèlement à l'IA. Combiner la focalisation d'OWASP à des outils concrets rend cela non seulement possible, mais également pratique.