Liste de Contrôle de Sécurité pour les Applications LLM

Introduction

Alors que les organisations intègrent des Modèles de Langage de Grande Taille (LLMs) en production, la surface d’attaque s’élargit au-delà des fuites de données et de l’injection de requêtes. Chaque système connecté à un LLM — qu’il soit intégré dans des chatbots, des outils d’analyse ou des moteurs de recherche d’entreprise — doit trouver un équilibre entre facilité d’utilisation, sécurité des données et conformité.

Bien que les API d’IA modernes protègent les points d’accès aux modèles, les vulnérabilités résident souvent au niveau des points d’intégration : la sanitisation des entrées, les permissions des plugins, le stockage vectoriel ou la logique de requête non protégée. Construire des applications IA sécurisées implique la mise en œuvre d’une surveillance continue, du chiffrement et des politiques de moindre privilège du prompt jusqu’à la réponse.

Comprendre la Sécurité des Applications LLM

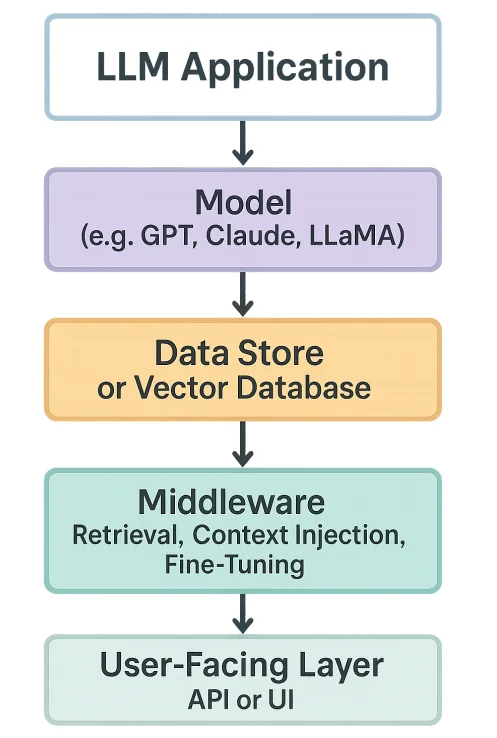

Une application LLM combine généralement quatre éléments :

- Le modèle (par ex. GPT, Claude, LLaMA)

- Le magasin de données ou base vectorielle

- Le middleware (récupération, injection de contexte, fine-tuning)

- La couche orientée utilisateur (API ou interface utilisateur)

Chaque couche introduit des risques :

- Le modèle peut mémoriser des données sensibles.

- La couche de récupération pourrait exposer des embeddings privés.

- Les plugins pourraient exécuter des actions non intentionnées.

- Les journaux peuvent contenir des informations personnelles identifiables (IPI) ou des jetons confidentiels.

La sécurité ici signifie protéger à la fois le pipeline et l’intelligence qu’il génère.

Principaux Défis de Sécurité

- Attaques par Injection de Requêtes – Entrées malveillantes qui manipulent le comportement du modèle pour divulguer ou modifier des données sensibles.

- Exfiltration de Données via les Plugins – API de plugins non restreintes ou appels à des outils externes qui exportent des données privées.

- Empoisonnement des Données d’Entraînement – Corpora corrompus de fine-tuning ou de récupération introduisant de fausses informations ou vulnérabilités.

- Injection dans la Sortie du Modèle – Attaquants intégrant des charges malveillantes dans les réponses (par ex. scripts intersites).

- Dérive de Conformité – Lorsque les LLM traitent des données sensibles sans pistes d’audit, violant les normes RGPD ou HIPAA.

Couches de Sécurité Clés pour les Applications LLM

1. Sécurité des Données et Conformité

- Chiffrer les embeddings stockés et les index vectoriels avec le chiffrement de bases de données.

- Classer et masquer les données sensibles avec le masquage dynamique ou le masquage statique avant de les envoyer au modèle.

- Valider la conformité avec des cadres comme le RGPD et le PCI DSS.

2. Contrôle d’Accès et Surveillance

- Appliquer le contrôle d’accès basé sur les rôles (RBAC).

- Mise en place de passerelles reverse proxy pour l’authentification, la limitation de débit et la détection d’anomalies.

- Centrer la surveillance des activités pour chaque appel API et requête modèle.

3. Protection des Requêtes et du Contexte

- Sanitiser les entrées utilisateur et censurer les secrets avant de passer au LLM.

- Appliquer des « gardes-fous » qui valident les réponses et suppriment les identifiants confidentiels.

- Journaliser toutes les requêtes en toute sécurité via des journaux d’audit.

4. Sécurité du Cycle de Vie du Modèle

- Signer et versionner chaque modèle et jeu de données.

- Examiner tous les ensembles de données de fine-tuning à la recherche d’injections ou de contenus malveillants.

- Mettre en œuvre des contrôles d’intégrité continus à l’aide de hachages ou signatures numériques.

5. Défense Réseau et API

- Utiliser HTTPS/TLS pour tout le trafic lié au modèle.

- Limiter les connexions sortantes depuis les applications LLM.

- Surveiller tous les appels aux plugins et API externes pour détecter l’exfiltration de données.

Bonnes Pratiques de Mise en Œuvre

Pour les Organisations

- Classification des Données en priorité : Identifier les entrées sensibles ou réglementées.

- Vue Unifiée de la Conformité : Exploiter la découverte de données et les rapports de conformité DataSunrise pour surveiller l’utilisation.

- Déploiement IA Zero-Trust : Considérer chaque requête ou réponse comme un vecteur d’attaque potentiel.

- Tests de Sécurité Réguliers : Réaliser des évaluations red team et adversariales sur les sorties des LLM.

Pour les Équipes Techniques

- Hygiène du Fine-Tuning : Valider les jeux de données avant le fine-tuning ou l’ingestion RAG.

- Gestion Sécurisée des Secrets : Ne jamais intégrer de clés API dans les prompts ou variables d’environnement sans chiffrement.

- Analyse comportementale : Utiliser l’analyse comportementale pour détecter les schémas de requêtes anormaux.

- Politique de Moindre Privilège : Appliquer le principe du moindre privilège sur les API et couches d’accès au modèle.

Liste de Contrôle de Sécurité pour les Applications LLM (Résumé)

| Zone | Contrôles Clés | Outils / Techniques |

|---|---|---|

| Couche Données | Chiffrement, masquage, étiquetage de conformité | Chiffrement de Bases de Données, Masquage Dynamique |

| Contrôle d’Accès | RBAC, MFA, proxies | Reverse Proxy, RBAC |

| Couche Requête | Sanitisation, filtres contextuels | Gardes-fous personnalisés, scripts de validation |

| Cycle de Vie du Modèle | Versionnage, signature, validation | GitOps, scan CI/CD |

| Surveillance | Audit centralisé et détection d’anomalies | Surveillance des Activités, Journaux d’Audit |

FAQ : Sécurité des Applications LLM

Q1. Quel est le plus grand risque de sécurité dans les LLM ?

Injection de requêtes et exfiltration de données via les plugins connectés ou les API externes.

Q2. Un LLM peut-il divulguer les données d’entraînement ?

Oui — particulièrement les modèles fine-tunés ou RAG entraînés sur des textes sensibles sans masquage ou chiffrement.

Q3. Comment garantir la conformité au RGPD ou à la HIPAA ?

Activez le masquage des données, le suivi du consentement et les pistes d’audit pour toutes les interactions avec le modèle.

Q4. Quelle est la meilleure manière de détecter une activité malveillante ?

Utilisez l’analyse comportementale et la surveillance en temps réel pour repérer des schémas de requêtes inhabituels ou un usage excessif des jetons.

Q5. Comment DataSunrise sécurise-t-il les pipelines LLM ?

En combinant la surveillance proxy, le masquage et la protection des données dans un cadre unifié de conformité.

Conclusion

Tout comme l’apprentissage fédéré a démontré que la collaboration préservant la vie privée est possible, sécuriser les LLM prouve que intelligence et gouvernance peuvent coexister.

DataSunrise permet aux organisations d’appliquer le chiffrement, la surveillance et la conformité sur l’ensemble de l’écosystème LLM — depuis les magasins vectoriels jusqu’aux modèles fine-tunés — garantissant qu’aucune information ne soit obtenue au détriment de la sécurité.

Lectures Recommandées :