Verantwortliche KI-Prinzipien für LLM-Governance

Während künstliche Intelligenz Geschäftsabläufe transformiert, implementieren 92% der Organisationen Systeme mit großen Sprachmodellen (LLMs) in strategischen Geschäftsbereichen. Obwohl LLMs beispiellose Fähigkeiten bieten, bringen sie komplexe Herausforderungen der ethischen Governance mit sich, die strukturierte verantwortliche KI-Rahmenwerke erfordern, um eine vertrauenswürdige und rechenschaftspflichtige Implementierung zu gewährleisten.

Dieser Leitfaden untersucht verantwortliche KI-Prinzipien für die LLM-Governance und beleuchtet Umsetzungsstrategien, die es Organisationen ermöglichen, KI-Systeme ethisch einzusetzen und gleichzeitig operative Exzellenz aufrechtzuerhalten.

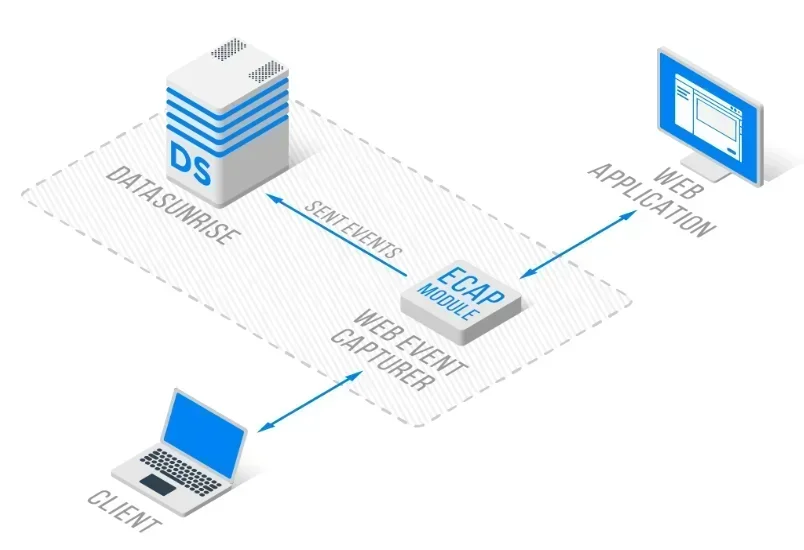

DataSunrise‘s fortschrittliche Responsible AI-Plattform liefert Zero-Touch-Ethical-Governance mit autonomer Responsibility-Orchestrierung über alle wichtigen LLM-Plattformen hinweg. Unser zentralisiertes KI-Ethik-Rahmenwerk integriert nahtlos verantwortliche KI-Prinzipien mit technischen Kontrollen und bietet eine präzise, chirurgisch genaue ethische Aufsicht für eine umfassende LLM-Governance.

Kernprinzipien der verantwortlichen KI

Fairness und Nichtdiskriminierung

LLM-Systeme müssen ohne Verzerrungen in Bezug auf demografische Gruppen agieren, um gerechte Ergebnisse unabhängig von den Eigenschaften der Nutzer sicherzustellen. Organisationen müssen Mechanismen zur Erkennung von Verzerrungen implementieren und kontinuierliche Überwachung diskriminierender Ergebnisse mithilfe von Verhaltensanalysen und umfassender Audit-Trails sicherstellen.

Transparenz und Erklärbarkeit

Eine verantwortliche LLM-Governance erfordert klare Erklärungen der KI-Entscheidungsprozesse und transparente algorithmische Abläufe. Organisationen müssen sinnvolle Erklärungen für KI-generierte Ergebnisse liefern und gleichzeitig die Datenbanksicherheit wahren und den Wert der Daten mithilfe von Zugriffskontrollen schützen.

Rechenschaftspflicht und menschliche Aufsicht

LLM-Systeme erfordern klare Verantwortlichkeitsstrukturen, die unter anderem die Validierung durch den Menschen („human-in-the-loop“) und umfassende Rahmenwerke der Verantwortlichkeit beinhalten. Organisationen müssen Governance-Strukturen mit definierten Rollen, Sicherheitsrichtlinien und Compliance-Überwachung über alle KI-Operationen hinweg etablieren.

Datenschutz und Datensicherung

Die verantwortliche KI-Governance verlangt einen robusten Datenschutz, inklusive Datenminimierung und einem umfassenden Schutz von personenbezogenen Daten (PII). Organisationen müssen dynamisches Data Masking implementieren und dabei die Datenzugänglichkeit bewahren sowie Bedrohungserkennungs-Fähigkeiten sicherstellen.

Implementierungsrahmen

Hier ist ein praktischer Ansatz zur verantwortlichen KI-Governance:

class ResponsibleAIFramework:

def __init__(self):

self.bias_threshold = 0.1

self.transparency_requirements = ['model_version', 'decision_logic', 'confidence_score']

def evaluate_ai_decision(self, decision_data):

"""Bewerte die KI-Entscheidung anhand der Prinzipien verantwortlicher KI"""

evaluation = {

'fairness_score': self._assess_fairness(decision_data),

'transparency_score': self._assess_transparency(decision_data),

'oversight_score': self._assess_human_oversight(decision_data),

'privacy_score': self._assess_privacy_protection(decision_data)

}

# Berechne den gesamten Score für verantwortliche KI

overall_score = sum(evaluation.values()) / len(evaluation) * 100

return {

'responsible_ai_score': overall_score,

'compliant': overall_score >= 75,

'recommendations': self._generate_recommendations(evaluation)

}

def _assess_fairness(self, data):

"""Überprüfe auf demografische Verzerrungen in den Ergebnissen"""

groups = data.get('demographic_analysis', {})

if len(groups) < 2:

return 1.0

outcomes = [g.get('positive_rate', 0) for g in groups.values()]

bias_level = max(outcomes) - min(outcomes)

return max(0, 1 - (bias_level / self.bias_threshold))

Beste Implementierungspraktiken

Für Organisationen:

- Einrichtung von KI-Ethik-Komitees: Erstellen Sie funktionsübergreifende Teams mit vielfältigen Perspektiven und angemessener rollenbasierter Zugriffskontrolle

- Entwicklung ethischer Richtlinien: Erarbeiten Sie umfassende Richtlinien, die die Prinzipien verantwortlicher KI in Übereinstimmung mit den Audit-Zielen adressieren

- Implementierung kontinuierlicher Überwachung: Setzen Sie Echtzeit-Überwachungssysteme ein

- Bereitstellung von Schulungsprogrammen: Schulen Sie die beteiligten Interessengruppen in der Implementierung verantwortlicher KI

Für technische Teams:

- Aufbau von Verzerrungserkennung: Implementieren Sie automatisierte Tools zur Erkennung und Minderung von Verzerrungen mit Lernregeln und Audit-Funktionalitäten

- Erstellung von Erklärsystemen: Entwickeln Sie technische Systeme zur Erklärung von KI-Entscheidungen

- Einrichtung von Audit-Trails: Führen Sie umfassende Protokolle aller KI-Entscheidungen

- Einsatz von Datenschutzkontrollen: Implementieren Sie Mechanismen zum Datenschutz und zur Verwaltung von Testdaten

DataSunrise: Umfassende Lösung für verantwortliche KI

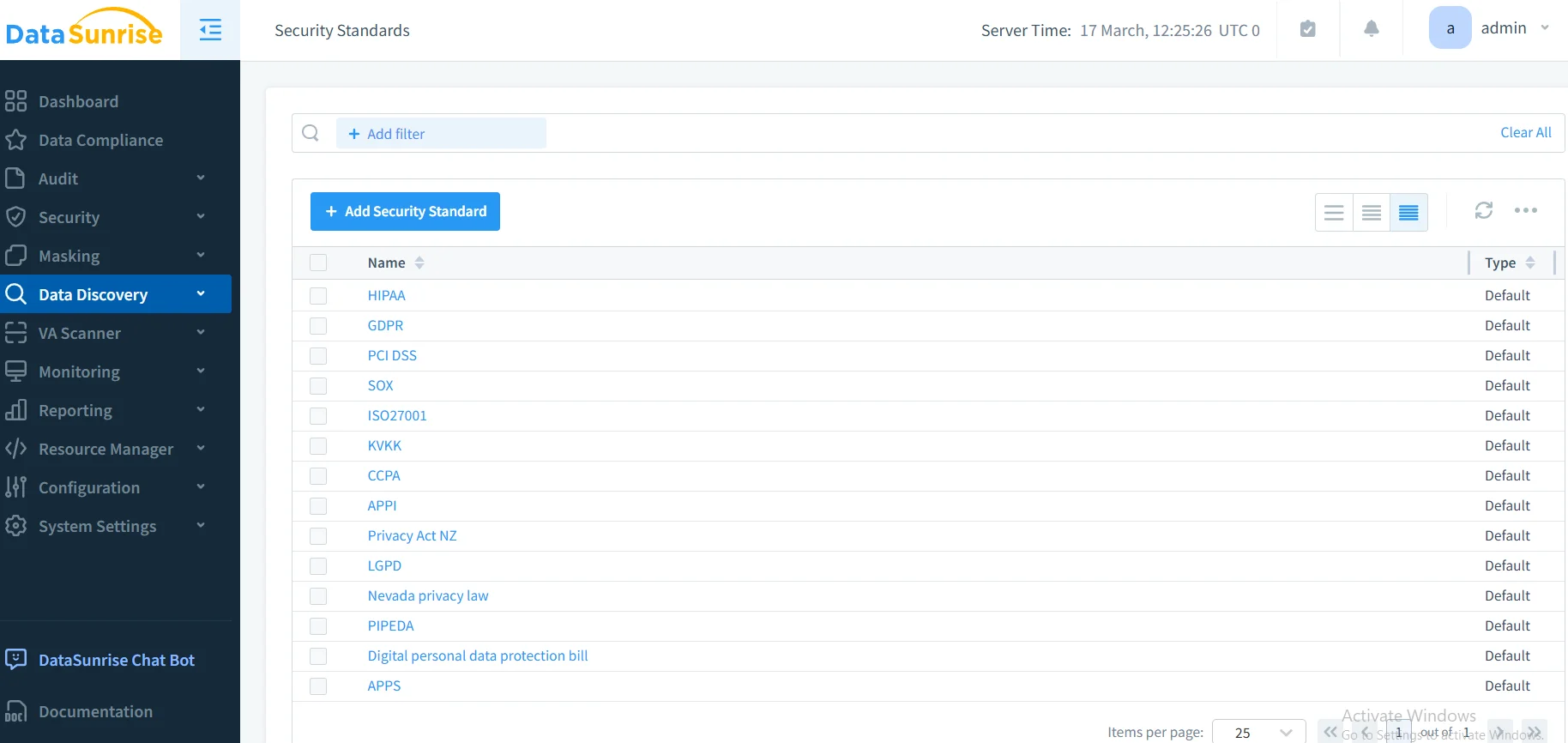

DataSunrise bietet unternehmensgerechte Lösungen für die verantwortliche KI-Governance, die speziell für LLM-Umgebungen entwickelt wurden. Unsere Lösung liefert KI-Compliance by Default mit maximaler Ethik und minimalem Risiko bei ChatGPT, Amazon Bedrock, Azure OpenAI und kundenspezifischen LLM-Bereitstellungen.

Schlüsselmerkmale:

- Ethisches KI-Monitoring: Echtzeit-Überwachung der KI-Aktivitäten mit umfassenden Auditing-Fähigkeiten

- Verzerrungserkennung: ML-gestützte Fairness-Bewertung mit automatisierter Erkennung von Verzerrungen

- Transparenz-Dashboard: Kontextbezogener Schutz mit detaillierten Erklärungen zu KI-Entscheidungen

- Plattformübergreifende Abdeckung: Einheitliche Governance über mehr als 50 unterstützte Plattformen

- Privacy-First-Architektur: Fortschrittliche Erkennung von personenbezogenen Daten (PII) und Data Masking

DataSunrise‘s flexible Bereitstellungsmodi unterstützen On-Premise-, Cloud- und Hybridumgebungen mit Zero-Touch-Implementierung. Organisationen erzielen eine Verbesserung der ethischen KI-Compliance um 90 % und stärken das Vertrauen der Stakeholder durch automatisiertes Monitoring verantwortlicher KI.

Regulatorische Ausrichtung

Die verantwortliche KI-Governance muss sich an den sich entwickelnden regulatorischen Anforderungen orientieren:

- EU KI-Gesetz: Umfassendes Rahmenwerk, das Risikobewertungen und menschliche Aufsicht für Hochrisiko-KI-Systeme vorschreibt

- Algorithmische Verantwortlichkeit: Zunehmende Anforderungen an Audits zu KI-Verzerrungen und Fairness-Bewertungen

- Datenschutzbestimmungen: GDPR-Anforderungen für Transparenz bei automatisierten Entscheidungsprozessen und Validierung durch datengetriebene Tests

- Branchenspezifische Standards: Ethische KI-Anforderungen im Gesundheitswesen (HIPAA) und im Finanzsektor

Fazit: Vertrauen aufbauen durch verantwortliche KI

Die Prinzipien verantwortlicher KI für die LLM-Governance stellen grundlegende Anforderungen an den vertrauenswürdigen Einsatz von KI dar. Organisationen, die umfassende Rahmenwerke für verantwortliche KI implementieren, positionieren sich so, dass sie das transformative Potenzial von KI nutzen und gleichzeitig ethische Exzellenz und das Vertrauen der Stakeholder bewahren.

Mit dem zunehmenden autonomen Handeln von KI-Systemen entwickelt sich die verantwortliche KI-Governance von einer bloßen Compliance-Anforderung zu einem Wettbewerbsvorteil. Durch die Implementierung bewährter ethischer Rahmenwerke mit kontinuierlichen Überwachungsmechanismen können Organisationen KI-Innovationen selbstbewusst einsetzen und dabei ihren Ruf schützen.

DataSunrise: Ihr Partner für verantwortliche KI

DataSunrise führt bei Lösungen zur verantwortlichen KI-Governance, indem es umfassenden ethischen KI-Schutz mit fortschrittlichen Fairness-Analysen bietet. Unsere kosteneffiziente und skalierbare Plattform bedient Organisationen von Start-ups bis hin zu Fortune-500-Unternehmen.

Erleben Sie unsere autonome Ethical Orchestration und entdecken Sie, wie DataSunrise verantwortliche KI-Innovationen ermöglicht. Vereinbaren Sie Ihre Demo, um unsere Fähigkeiten in der verantwortlichen KI-Governance kennenzulernen.