Gestion des données sensibles dans les modèles d’IA et LLM

Alors que l’intelligence artificielle transforme les opérations des entreprises, 91 % des organisations déploient des modèles d’IA et LLM dans des workflows essentiels traitant d’immenses quantités d’informations sensibles. Bien que ces technologies offrent des capacités sans précédent, elles introduisent des défis complexes en matière de protection des données que les cadres de sécurité traditionnels ne peuvent pas traiter de manière adéquate.

Ce guide examine des stratégies complètes pour la gestion des données sensibles dans les modèles d’IA et LLM, en explorant des techniques de mise en œuvre qui permettent aux organisations d’exploiter le potentiel de l’IA tout en maintenant une protection solide des informations confidentielles.

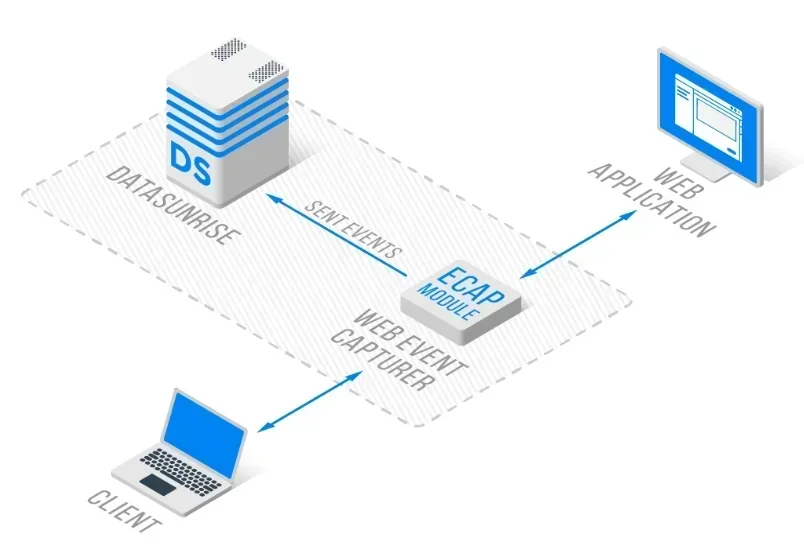

La plateforme avancée de protection des données par IA de DataSunrise offre une gestion des données sensibles sans intervention manuelle grâce à une orchestration autonome de la confidentialité sur toutes les grandes plateformes d’IA. Notre protection contextuelle s’intègre parfaitement à la gestion des données sensibles avec des contrôles techniques, offrant une protection chirurgicale pour une sécurité complète des environnements d’IA et LLM.

Comprendre les défis des données sensibles dans les systèmes d’IA

Les modèles d’IA et LLM fonctionnent différemment des applications traditionnelles lorsqu’il s’agit de traiter des informations sensibles. Ces systèmes traitent, apprennent à partir de, et peuvent potentiellement mémoriser d’immenses ensembles de données contenant des informations personnelles identifiables (IPI), des relevés financiers, des données de santé et des informations commerciales exclusives.

La nature dynamique des systèmes d’IA crée des vulnérabilités uniques où les données sensibles peuvent être exposées par inadvertance à travers les sorties des modèles, des fuites de données d’entraînement ou une contamination croisée entre les conversations. Les organisations doivent mettre en place des cadres de sécurité des données complets qui répondent à la fois aux exigences techniques et réglementaires avec des mesures de sécurité de la base de données.

Catégories critiques de données sensibles

Informations personnelles et financières

Les modèles d’IA traitent fréquemment des données personnelles incluant noms, adresses, numéros de sécurité sociale et informations de paiement nécessitant des techniques spécialisées de masquage de données. Les organisations doivent mettre en œuvre un masquage dynamique des données pour protéger les IPI tout en maintenant la fonctionnalité du modèle grâce à des règles de sécurité et des capacités de détection des menaces.

Données de santé et données commerciales

Les applications d’IA traitent des informations de santé protégées (ISP) et des informations commerciales exclusives nécessitant la conformité HIPAA et une protection robuste de la propriété intellectuelle via un contrôle d’accès basé sur les rôles et la mise en œuvre de politiques de sécurité.

Exemples de mise en œuvre

Détection et masquage des données sensibles

Cet exemple démontre comment détecter automatiquement et masquer les informations sensibles dans les entrées d’IA avant leur traitement. Le système utilise des expressions régulières pour identifier les modèles IPI courants et les remplace par des jetons masqués, garantissant que les données sensibles ne parviennent pas au modèle d’IA tout en préservant la structure du texte pour le traitement.

import re

from typing import Dict, List, Tuple

class SensitiveDataProtector:

def __init__(self):

self.pii_patterns = {

'ssn': r'\b\d{3}-\d{2}-\d{4}\b',

'email': r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b',

'credit_card': r'\b(?:\d{4}[-\s]?){3}\d{4}\b'

}

def validate_ai_input(self, prompt: str) -> Dict[str, any]:

"""Valider et masquer l'entrée d'IA pour les données sensibles"""

masked_prompt = prompt

detected_types = []

for pii_type, pattern in self.pii_patterns.items():

if re.search(pattern, prompt):

detected_types.append(pii_type)

masked_prompt = re.sub(pattern, f'[{pii_type.upper()}_MASKED]', masked_prompt)

return {

'masked_prompt': masked_prompt,

'pii_detected': detected_types,

'safe_for_processing': len(detected_types) == 0

}

Assainissement des sorties de l’IA

Cette implémentation montre comment assainir les réponses des modèles d’IA afin de prévenir l’exposition accidentelle d’informations sensibles. Le système analyse les sorties à la recherche de mots-clés potentiellement sensibles et de modèles IPI, les remplaçant par des alternatives sécurisées tout en maintenant la cohérence de la réponse.

from datetime import datetime

class AIOutputSanitizer:

def __init__(self):

self.sensitive_keywords = ['password', 'secret', 'confidential', 'private']

def sanitize_response(self, response: str, user_id: str) -> Dict[str, any]:

"""Assainir la réponse de l'IA pour le contenu sensible"""

sanitized = response

violations = []

# Vérifier la présence de mots-clés sensibles

for keyword in self.sensitive_keywords:

if keyword.lower() in response.lower():

violations.append(keyword)

sanitized = sanitized.replace(keyword, f"[{keyword.upper()}_REDACTED]")

# Enregistrer l'événement d'assainissement

audit_entry = {

'timestamp': datetime.utcnow().isoformat(),

'user_id': user_id,

'violations': violations,

'sanitized': len(violations) > 0

}

return {

'sanitized_response': sanitized,

'safe_for_output': len(violations) == 0,

'audit_log': audit_entry

}

Bonnes pratiques de mise en œuvre

Pour les organisations :

- Classification des données : Mettre en place une identification automatisée des données sensibles à l’aide d’outils de découverte de données et de protocoles de masquage statique des données

- Confidentialité dès la conception : Intégrer la protection dans l’architecture de l’IA avec des contrôles d’accès et une protection par pare-feu de base de données

- Surveillance continue : Déployer une surveillance en temps réel de l’activité des bases de données avec un suivi par journaux d’audit

Pour les équipes techniques :

- Protection multicouche : Mettre en œuvre une validation des entrées et un assainissement des sorties avec des protocoles d’évaluation de vulnérabilité

- Détection automatisée : Déployer une détection des données sensibles alimentée par le ML avec des fonctionnalités de chiffrement des bases de données

- Documentation d’audit : Maintenir des traces d’audit complètes et des systèmes de reporting de conformité

DataSunrise : Solution complète de protection des données pour l’IA

DataSunrise fournit une protection des données sensibles de qualité entreprise conçue spécifiquement pour les environnements d’IA et LLM. Notre solution offre une conformité IA par défaut avec une protection maximale de la vie privée sur ChatGPT, Amazon Bedrock, Azure OpenAI et les déploiements d’IA personnalisés.

Fonctionnalités clés :

- Détection des données en temps réel : Identification avancée des IPI grâce à une protection contextuelle

- Masquage de précision chirurgicale : Masquage intelligent qui préserve la fonctionnalité du modèle

- Couverture multiplateforme : Protection unifiée sur plus de 50 plateformes supportées

- Analyse alimentée par ML : Analyse comportementale pour la détection d’anomalies

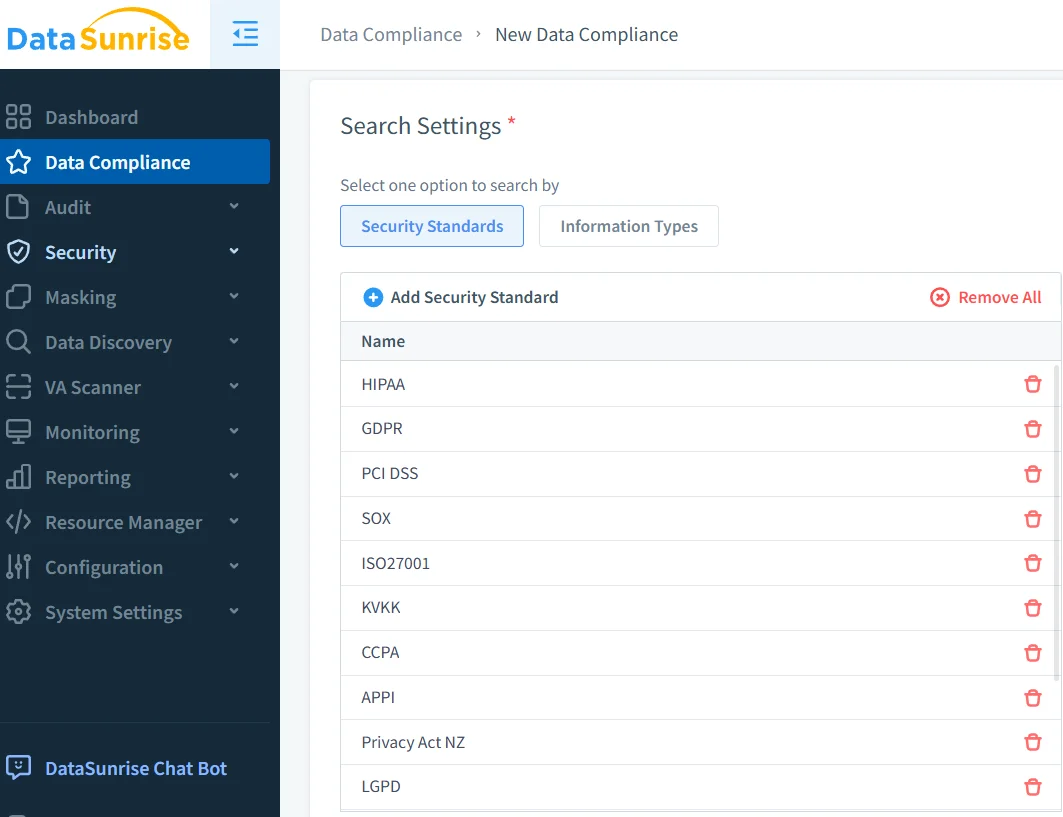

- Conformité automatisée : Reporting de conformité en un clic pour les principaux cadres réglementaires

Les modes de déploiement flexible de DataSunrise supportent les environnements sur site, cloud et hybrides avec une mise en œuvre sans intervention. Les organisations réduisent significativement les incidents d’exposition de données sensibles grâce à des mécanismes de protection automatisés.

Considérations relatives à la conformité réglementaire

La gestion des données sensibles dans les systèmes d’IA doit répondre à des exigences réglementaires complètes :

- Conformité GDPR : Minimisation des données et gestion du consentement pour le traitement des données personnelles par l’IA

- Exigences HIPAA : Protection des ISP dans les applications d’IA en santé

- Normes PCI DSS : Gestion sécurisée des données de paiement dans les systèmes d’IA financiers

- Conformité SOX : Contrôles internes pour les systèmes d’IA traitant des informations financières

Conclusion : Sécuriser l’IA grâce à la protection des données

La gestion des données sensibles dans les modèles d’IA et LLM nécessite des cadres sophistiqués abordant l’identification, la protection et la gouvernance des données tout au long du cycle de vie de l’IA. Les organisations qui mettent en place des stratégies robustes de protection des données sensibles se positionnent pour exploiter le potentiel transformateur de l’IA tout en maintenant la confiance des parties prenantes.

À mesure que les systèmes d’IA deviennent de plus en plus sophistiqués, la protection des données évolue d’un bonus optionnel à une capacité essentielle pour l’entreprise. En mettant en œuvre des cadres de protection complets, les organisations peuvent déployer en toute confiance des innovations en IA tout en préservant leurs actifs informationnels.

Protégez vos données avec DataSunrise

Sécurisez vos données à chaque niveau avec DataSunrise. Détectez les menaces en temps réel grâce à la surveillance des activités, au masquage des données et au pare-feu de base de données. Appliquez la conformité des données, découvrez les données sensibles et protégez les charges de travail via plus de 50 intégrations supportées pour le cloud, sur site et les systèmes de données basés sur l'IA.

Commencez à protéger vos données critiques dès aujourd’hui

Demander une démo Télécharger maintenant