Checklist di Sicurezza per Applicazioni LLM

Introduzione

Man mano che le organizzazioni integrano i Large Language Models (LLM) in produzione, la superficie di attacco si espande oltre le fughe di dati e l’injection di prompt. Ogni sistema connesso a un LLM—sia esso integrato in chatbot, strumenti di analisi o motori di ricerca aziendali—deve bilanciare l’usabilità con la sicurezza dei dati e la conformità.

Sebbene le moderne API AI proteggano gli endpoint del modello, le vulnerabilità spesso risiedono nei punti di integrazione: sanitizzazione dell’input, permessi dei plugin, archiviazione vettoriale o logica dei prompt non tutelata. Costruire applicazioni AI sicure significa implementare un monitoraggio continuo monitoraggio, crittografia e politiche di minimo privilegio dal prompt alla risposta.

Comprendere la Sicurezza delle Applicazioni LLM

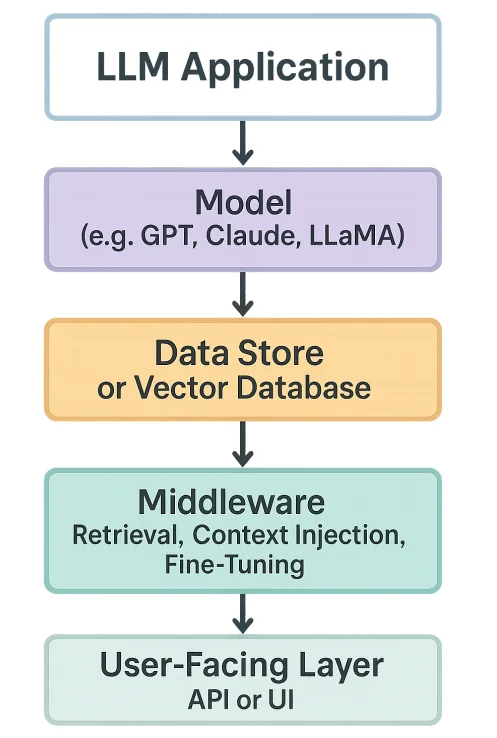

Un’applicazione LLM tipicamente combina quattro elementi:

- Il modello (es. GPT, Claude, LLaMA)

- Il data store o database vettoriale

- Il middleware (recupero dati, iniezione di contesto, fine-tuning)

- Lo strato di interfaccia utente (API o UI)

Ogni strato introduce rischi:

- Il modello può memorizzare dati sensibili.

- Lo strato di recupero potrebbe esporre embedding privati.

- I plugin potrebbero eseguire azioni non intenzionate.

- I log possono conservare PII o token riservati.

La sicurezza qui significa proteggere sia la pipeline sia l’intelligenza che essa genera.

Principali Sfide di Sicurezza

- Attacchi di Prompt Injection – Input malevoli che manipolano il comportamento del modello per fuoriuscita o modifica di dati sensibili.

- Esfiltrazione di Dati tramite Plugin – API di plugin non controllate o chiamate a strumenti esterni che esportano dati privati.

- Avvelenamento dei Dati di Training – Corruzione dei corpora di fine-tuning o recupero che iniettano informazioni false o vulnerabilità.

- Injection nell’Output del Modello – Attaccanti che inseriscono payload malevoli nelle risposte (es. script cross-site).

- Deriva di Conformità – Quando i LLM elaborano dati sensibili senza tracce di audit, violando gli standard GDPR o HIPAA.

Strati Fondamentali di Sicurezza per Applicazioni LLM

1. Sicurezza dei Dati e Conformità

- Crittografare embedding archiviati e indici vettoriali utilizzando crittografia del database.

- Classificare e mascherare dati sensibili con mascheramento dinamico o mascheramento statico prima di inviarli al modello.

- Verificare l’allineamento con framework come GDPR e PCI DSS.

2. Controllo Accessi e Monitoraggio

- Applicare il controllo degli accessi basato su ruoli.

- Implementare gateway reverse proxy per autenticazione, limiti di velocità e rilevamento anomalie.

- Centralizzare il monitoraggio delle attività per ogni chiamata API e query al modello.

3. Protezione di Prompt e Contesto

- Sanitizzare l’input utente e oscurare segreti prima di passarli al LLM.

- Applicare “guardrail” che convalidano le risposte e rimuovono identificatori confidenziali.

- Registrare tutti i prompt in modo sicuro utilizzando log di audit.

4. Sicurezza del Ciclo di Vita del Modello

- Firmare e versionare ogni modello e dataset.

- Revisionare ogni dataset di fine-tuning per injection o contenuti malevoli.

- Applicare controlli continui di integrità usando hashing o firme digitali.

5. Difesa di Rete e API

- Usare HTTPS/TLS per tutto il traffico verso i modelli.

- Limitare le connessioni in uscita dalle app LLM.

- Monitorare tutte le chiamate a plugin e API esterne per esfiltrazione dati.

Best Practice di Implementazione

Per le Organizzazioni

- Classificazione Dati Prima di Tutto: Identificare quali input sono sensibili o soggetti a regolamentazioni.

- Vista Unificata della Conformità: Sfruttare data discovery e report di conformità da DataSunrise per monitorare l’uso.

- Deploy AI Zero-Trust: Presumere che ogni prompt o risposta possa essere un vettore d’attacco.

- Test di Sicurezza Regolari: Effettuare valutazioni red-team e avversariali sugli output LLM.

Per i Team Tecnici

- Igiene del Fine-Tuning: Validare i dataset prima del fine-tuning o dell’ingestione RAG.

- Gestione Sicura dei Segreti: Non inserire mai chiavi API in prompt o variabili d’ambiente senza crittografia.

- Analisi del Comportamento: Usare behavior analytics per rilevare pattern di query anomali.

- Politica di Minimo Privilegio: Seguire il principio del minimo privilegio su API e livelli di accesso modello.

Checklist di Sicurezza per Applicazioni LLM (Riepilogo)

| Area | Controlli Chiave | Strumenti / Tecniche |

|---|---|---|

| Strato Dati | Crittografia, mascheramento, tagging per conformità | Crittografia Database, Mascheramento Dinamico |

| Controllo Accessi | RBAC, MFA, proxy | Reverse Proxy, RBAC |

| Strato Prompt | Sanitizzazione, filtri di contesto | Guardrail personalizzati, script di validazione |

| Ciclo di Vita del Modello | Versioning, firma, validazione | GitOps, scansione CI/CD |

| Monitoraggio | Audit centralizzati e rilevamento anomalie | Monitoraggio Attività, Log di Audit |

FAQ: Sicurezza per Applicazioni LLM

D1. Qual è il rischio di sicurezza più grande negli LLM?

Injection di prompt e esfiltrazione dati tramite plugin connessi o API esterne.

D2. Un LLM può divulgare dati di training?

Sì — specialmente modelli fine-tuned o RAG addestrati su testi sensibili senza mascheramento o crittografia.

D3. Come posso garantire la conformità a GDPR o HIPAA?

Abilitando mascheramento dati, tracciamento del consenso e tracce di audit per tutte le interazioni con il modello.

D4. Qual è il modo migliore per rilevare attività malevole?

Usare behavior analytics e monitoraggio in tempo reale per individuare pattern di query insoliti o uso eccessivo di token.

D5. Come DataSunrise protegge le pipeline LLM?

Combinando monitoraggio basato su proxy, mascheramento, e protezione dei dati all’interno di un framework di conformità unificato.

Conclusione

Proprio come il federated learning ha insegnato al mondo che la collaborazione che preserva la privacy è possibile, mettere in sicurezza gli LLM dimostra che intelligenza e governance possono coesistere.

DataSunrise consente alle organizzazioni di applicare crittografia, monitoraggio e conformità in tutto l’ecosistema LLM — dagli store vettoriali ai modelli fine-tuned — assicurando che nessuna conoscenza venga acquisita a scapito della sicurezza.

Letture Consigliate: