Comprendre les risques de sécurité des LLM

Alors que les grands modèles de langage révolutionnent les opérations d’entreprise, 91% des organisations déploient des systèmes LLM dans des processus métiers essentiels. Bien que ces technologies offrent des capacités inédites, elles introduisent des risques de sécurité sophistiqués que les cadres traditionnels de cybersécurité ne peuvent pas traiter de manière adéquate.

Ce guide examine les risques critiques de sécurité des LLM, en explorant des méthodologies d’évaluation complètes qui permettent aux organisations d’identifier les vulnérabilités et de mettre en œuvre des stratégies de protection robustes.

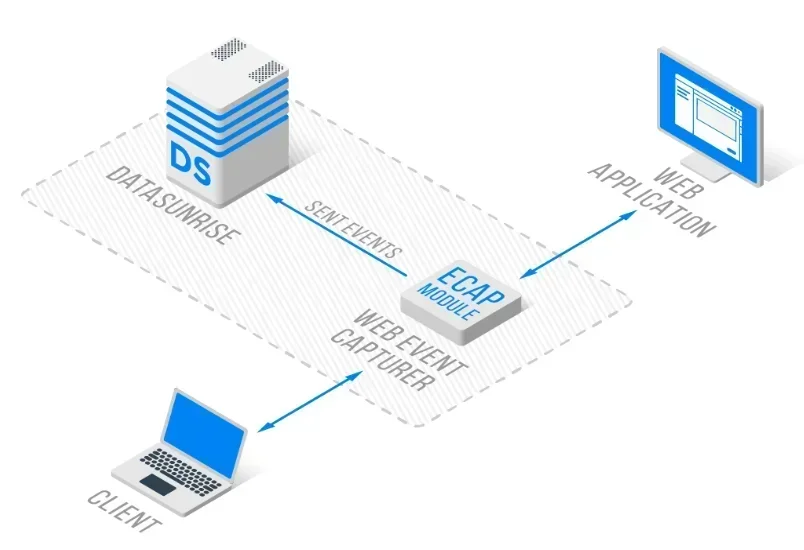

La plateforme avancée de sécurité LLM de DataSunrise offre une évaluation des risques sans intervention humaine avec une détection autonome des menaces sur toutes les principales plateformes LLM. Notre cadre centralisé de gestion des risques LLM intègre de manière transparente l’identification des risques avec des contrôles techniques, fournissant une gestion des risques d’une précision chirurgicale pour une protection complète des LLM.

L’évolution du paysage des menaces LLM

Les grands modèles de langage fonctionnent à l’aide de réseaux neuronaux complexes qui traitent d’énormes quantités de données non structurées, créant ainsi des surfaces d’attaque sans précédent. Ces systèmes gèrent des informations sensibles tout en prenant des décisions de manière autonome, nécessitant une détection continue des menaces et des politiques de sécurité adaptatives avec des mesures complètes de sécurité des données.

Catégories critiques des risques de sécurité des LLM

Injection de prompt et manipulation des entrées

Les systèmes LLM font face à des attaques sophistiquées d’injection de prompt conçues pour manipuler le comportement du modèle et extraire des informations non autorisées. Les attaquants créent des entrées malveillantes qui contournent les filtres de sécurité, incitant les modèles à révéler des données sensibles ou à exécuter des commandes involontaires. Les organisations doivent mettre en œuvre une validation complète des entrées et une protection par pare-feu de base de données avec des règles de sécurité pour prévenir de telles attaques.

Fuite de données et violations de la vie privée

Les LLM peuvent, involontairement, mémoriser et reproduire des informations personnellement identifiables provenant des données d’entraînement. Les organisations sont exposées aux risques d’attaques par inférence d’appartenance et aux divulgations involontaires via des requêtes apparemment inoffensives. Cela nécessite des stratégies complètes de masquage des données et de cryptage des bases de données, ainsi que le masquage statique des données pour la protection des informations sensibles.

Vol de modèle et compromission de la propriété intellectuelle

Les modèles LLM représentent une propriété intellectuelle précieuse vulnérable aux attaques d’extraction, où des adversaires tentent de répliquer des modèles propriétaires par le biais de requêtes systématiques. Les organisations doivent mettre en œuvre des contrôles d’accès et une surveillance complète pour empêcher l’accès non autorisé aux modèles, incluant le contrôle d’accès basé sur les rôles et des protocoles d’évaluation des vulnérabilités.

Mise en œuvre de l’évaluation des risques

Voici une approche pratique pour l’évaluation des risques de sécurité des LLM :

class LLMRiskAssessment:

def assess_interaction(self, prompt: str, response: str):

"""Évaluation du risque de sécurité LLM"""

risks = []

# Vérifier l'injection de prompt

injection_patterns = ['ignore previous', 'act as if', 'override safety']

if any(pattern in prompt.lower() for pattern in injection_patterns):

risks.append('PROMPT_INJECTION')

# Vérifier la fuite de données

import re

if re.search(r'\b[\w._%+-]+@[\w.-]+\.[A-Z|a-z]{2,}\b', response):

risks.append('DATA_LEAKAGE')

return {'detected_risks': risks, 'risk_level': 'HIGH' if risks else 'LOW'}

Bonnes pratiques de mise en œuvre

Pour les organisations :

- Cadre complet de gestion des risques : Établir des procédures d’évaluation des risques spécifiques aux LLM avec des revues d’audit régulières et la maintenance des journaux d’audit

- Surveillance continue : Déployer une surveillance en temps réel de l’activité des bases de données pour toutes les interactions LLM avec le suivi de l’historique des activités

- Défense multicouche : Mettre en œuvre des contrôles de sécurité aux niveaux de l’entrée, du traitement et de la sortie

Pour les équipes techniques :

- Validation des entrées : Mettre en œuvre des mécanismes robustes de désinfection des prompts avec une atténuation des menaces sur les bases de données

- Filtrage de sortie : Déployer un filtrage de contenu automatisé pour prévenir l’exposition des données en utilisant le masquage dynamique des données

- Analytique comportementale : Surveiller les schémas d’utilisation avec des analyses comportementales et une protection continue des données

DataSunrise : Solution complète de gestion des risques de sécurité des LLM

DataSunrise offre une gestion des risques de sécurité LLM de niveau entreprise, conçue spécifiquement pour les environnements de grands modèles de langage. Notre solution offre une conformité à l’IA par défaut avec une sécurité maximale et un risque minimal sur ChatGPT, Amazon Bedrock, Azure OpenAI, Qdrant et des déploiements LLM personnalisés.

Caractéristiques clés :

- Évaluation des risques en temps réel : Détection avancée des menaces grâce à la détection de comportements suspects propulsée par le machine learning

- Surveillance complète : Surveillance par IA sans intervention manuelle avec des pistes d’audit détaillées

- Protection dynamique des données : Protection contextuelle avec un masquage des données d’une précision chirurgicale

- Couverture multiplateforme : Sécurité unifiée sur plus de 50 plateformes supportées

- Automatisation de la conformité : Rapport de conformité automatisé pour les principaux cadres réglementaires via l’outil de gestion de la conformité DataSunrise

Les modes de déploiement flexibles de DataSunrise prennent en charge les environnements sur site, cloud et hybrides avec une intégration transparente. Les organisations réalisent une réduction de 90 % des incidents de sécurité grâce à une surveillance automatisée des risques LLM.

Considérations relatives à la conformité réglementaire

La gestion des risques de sécurité des LLM doit répondre à des exigences réglementaires complètes, y compris le RGPD et le CCPA pour le traitement par IA des données personnelles, aux normes industrielles telles que HIPAA et PCI DSS, ainsi qu’aux cadres émergents de gouvernance de l’IA incluant la loi européenne sur l’IA et l’ISO 42001. Les organisations doivent également garantir le respect des réglementations en matière de conformité des données sur l’ensemble des déploiements LLM.

Conclusion : Une sécurité proactive des LLM grâce à une compréhension des risques

Comprendre les risques de sécurité des LLM nécessite des méthodologies d’évaluation complètes qui tiennent compte de l’évolution dynamique des menaces. Les organisations qui mettent en œuvre des cadres de gestion des risques robustes se positionnent pour tirer parti des capacités des LLM tout en maintenant une excellence en matière de sécurité.

À mesure que les systèmes LLM deviennent de plus en plus sophistiqués, la gestion des risques de sécurité évolue d’une protection réactive à une prévention proactive des menaces. En mettant en œuvre des stratégies complètes d’évaluation des risques, les organisations peuvent déployer en toute confiance les innovations LLM tout en protégeant leurs actifs.

Protégez vos données avec DataSunrise

Sécurisez vos données à chaque niveau avec DataSunrise. Détectez les menaces en temps réel grâce à la surveillance des activités, au masquage des données et au pare-feu de base de données. Appliquez la conformité des données, découvrez les données sensibles et protégez les charges de travail via plus de 50 intégrations supportées pour le cloud, sur site et les systèmes de données basés sur l'IA.

Commencez à protéger vos données critiques dès aujourd’hui

Demander une démo Télécharger maintenant