Privacy dei Dati nei Sistemi di AI Generativa

L’AI generativa si è trasformata da una novità sperimentale a un’infrastruttura critica per il business, alimentando tutto, dai chatbot per il servizio clienti alle pipeline per la scoperta di farmaci. Ma poiché questi sistemi assimilano e generano dati sempre più sensibili, la privacy e la sicurezza sono diventate preoccupazioni esistenziali. Con l’89% delle imprese che ora adottano Large Language Models (LLMs) in ambienti di produzione, comprendere e mitigare i rischi per la privacy non è opzionale: è fondamentale per la sopravvivenza nell’era dell’IA.

La Crisi della Privacy nell’AI Generativa: Quattro Sfide Fondamentali

-

Memorizzazione Involontaria dei Dati

I LLM non si limitano a elaborare i dati, ma li internalizzano. Studi dimostrano che i modelli possono riprodurre, parola per parola, informazioni personali identificabili (PII) dai set di dati di addestramento. Un LLM nel settore sanitario potrebbe accidentalmente rivelare le cartelle dei pazienti, mentre un assistente di programmazione potrebbe esporre algoritmi proprietari. -

Attacchi di Prompt Injection

Gli aggressori manipolano gli input per bypassare le salvaguardie etiche. Questi attacchi sfruttano la comprensione contestuale del modello per estrarre informazioni riservate, richiedendo robuste Security Rules contro le tecniche di injection. -

Perdita di Dati a Livello di Inferenza

I dati sensibili trapelano attraverso output apparentemente innocui. Anche un’esposizione parziale dei dati viola regolamenti come il PCI-DSS e il GDPR. -

Incubi di Conformità

L’AI generativa si interseca con numerosi quadri regolatori:

- Conformità GDPR: Richiede il diritto all’oblio

- Conformità HIPAA: Richiede una protezione rigorosa delle informazioni sanitarie (PHI)

- Conformità PCI DSS: Impone l’isolamento dei dati di pagamento

Sicurezze Tecniche: Strategie di Protezione Basate sul Codice

1. Sanitizzazione Dinamica degli Input

Maschera i dati sensibili prima dell’elaborazione utilizzando tecniche come il Mascheramento Dinamico dei Dati:

import re

def sanitize_input(prompt: str) -> str:

# Maschera le email

prompt = re.sub(r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b', '[EMAIL]', prompt)

# Maschera le carte di credito (per la conformità PCI DSS)

prompt = re.sub(r'\b(?:\d[ -]*?){13,16}\b', '[CARD]', prompt)

# Maschera gli ID medici (per la conformità HIPAA)

prompt = re.sub(r'\b\d{3}-\d{2}-\d{4}\b', '[MED_ID]', prompt)

return prompt

2. Validazione in Tempo Reale degli Output

Blocca le perdite di PII nelle risposte con un continuo Threat Detection:

PII_PATTERNS = [

r'\b\d{3}-\d{2}-\d{4}\b', # SSN

r'\b(?:\d[ -]*?){13,16}\b', # Carte di credito

r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b' # Email

]

def validate_output(response: str) -> bool:

for pattern in PII_PATTERNS:

if re.search(pattern, response):

block_response() # Previene la fuoriuscita

log_incident() # Allerta di sicurezza

return False

return True

3. Tracce di Audit Immutabili

Traccia ogni interazione con l’AI utilizzando Tracce di Audit a prova di manomissione:

from datetime import datetime

import hashlib

def log_audit_trail(user_id, prompt, response):

timestamp = datetime.utcnow().isoformat()

audit_entry = {

"timestamp": timestamp,

"user": user_id,

"prompt_hash": hashlib.sha256(prompt.encode()).hexdigest(),

"response_hash": hashlib.sha256(response.encode()).hexdigest()

}

# Scrive in un archivio a prova di manomissione

with SecureAuditDB() as db:

db.insert(audit_entry)

Strategie Difensive Organizzative

| Strategia | Implementazione | Rischio Mitigato |

|---|---|---|

| Architettura Zero-Trust | Controlli di Accesso Basati sui Ruoli | Accesso non autorizzato ai dati |

| Test Adversariali | Simulazioni regolari di prompt injection | Tentativi di bypass della sicurezza |

| Mappatura della Conformità | Allinea i flussi di lavoro dell’AI con i quadri regolatori | Violazioni normative |

| Minimizzazione dei Dati | Politiche rigorose di Data Governance | Perdita di PII |

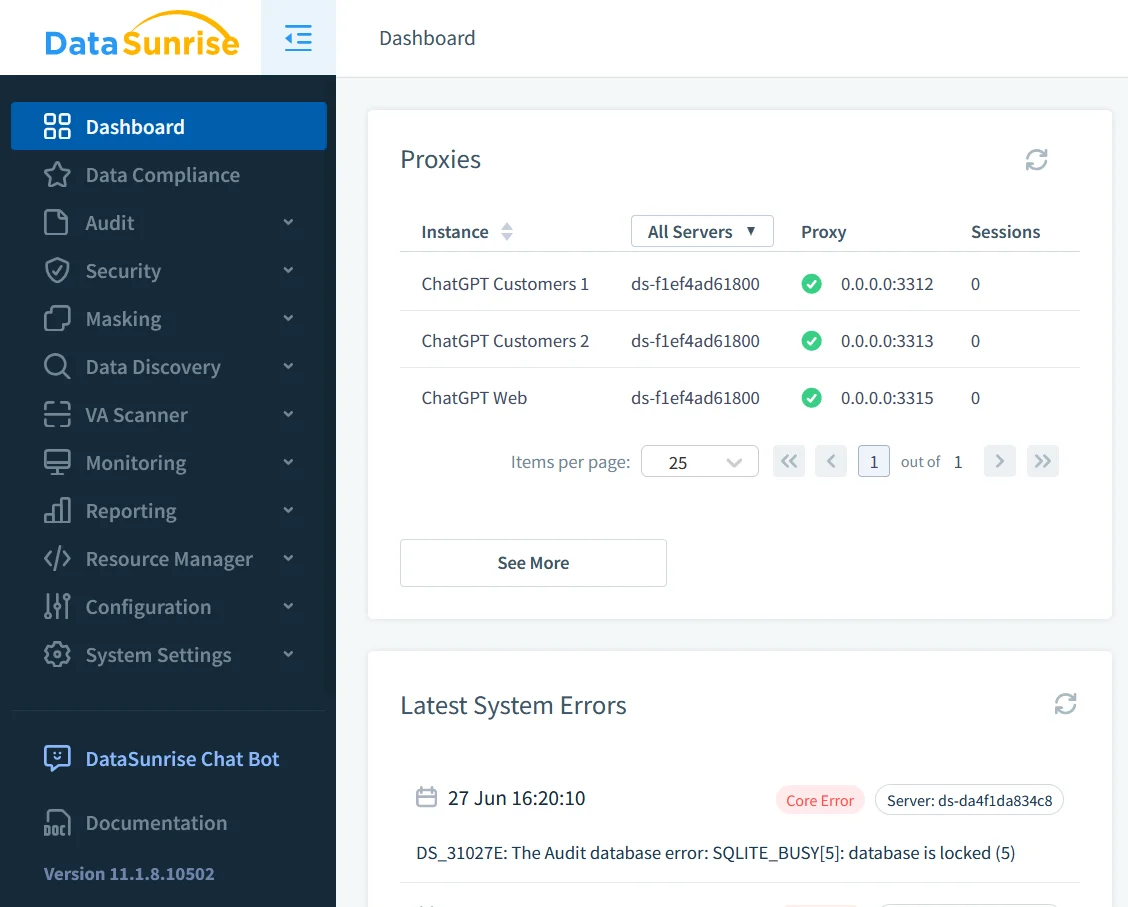

DataSunrise: Lo Strato di Sicurezza Unificato per i Sistemi di AI

DataSunrise fornisce un’infrastruttura di sicurezza critica attraverso:

-

AI-Sensitive Data Discovery

- Scansiona database e set di addestramento per PII/PHI

- Identifica oltre 50 tipi di dati sensibili

-

Dynamic Protection Suite

- Real-time masking: Anonimizza i dati durante l’inferenza

- Static masking: De-identifica i set di addestramento

- SQL injection protection: Blocca query dannose

-

Audit Logs Unificati

- Logging centralizzato per modelli di AI

- Reporting automatico di conformità

- Avvisi in tempo reale

-

Automazione della Conformità

- Modelli normativi predefiniti

- Applicazione delle politiche

- Generazione della documentazione

Il Piano di Difesa a Strati

Proteggere l’AI generativa richiede una protezione a strati:

-

Pre-elaborazione

- Data Discovery e classificazione

- Sanitizzazione degli input

- Controlli di accesso

-

Protezione in Esecuzione

- Database Activity Monitoring in tempo reale

- Rilevamento di prompt injection

- Validazione degli output

-

Post-elaborazione

- Analisi delle Tracce di Audit

- Verifica di conformità

- Miglioramento del modello

Conclusione: La Privacy come Vantaggio Competitivo

Man mano che l’AI generativa diventa parte integrante delle operazioni aziendali, la protezione della privacy si trasforma da necessità tecnica a fattore di differenziazione strategica. Le organizzazioni che implementano framework robusti:

- Riducono le sanzioni normative dell’83% (Gartner 2025)

- Incrementano i punteggi di fiducia dei clienti del 40%

- Accelerano l’adozione dell’AI eliminando i colli di bottiglia nella sicurezza

Strumenti come DataSunrise forniscono l’infrastruttura critica necessaria a bilanciare innovazione e responsabilità attraverso Security Policies e le capacità di Data Protection. Il futuro appartiene alle organizzazioni che riconoscono: Nell’era dell’intelligenza artificiale, la fiducia è la valuta definitiva.

Proteggi i tuoi dati con DataSunrise

Metti in sicurezza i tuoi dati su ogni livello con DataSunrise. Rileva le minacce in tempo reale con il Monitoraggio delle Attività, il Mascheramento dei Dati e il Firewall per Database. Applica la conformità dei dati, individua le informazioni sensibili e proteggi i carichi di lavoro attraverso oltre 50 integrazioni supportate per fonti dati cloud, on-premises e sistemi AI.

Inizia a proteggere oggi i tuoi dati critici

Richiedi una demo Scarica ora