Apprendimento Federato Sicuro

Man mano che le organizzazioni corrono per addestrare modelli di intelligenza artificiale più intelligenti insieme, il federated learning (FL) è diventato una delle tecniche più promettenti per collaborare senza compromettere la privacy dei dati. Invece di raccogliere i dati in un server centrale, ogni partecipante allena un modello locale e condivide solo i suoi aggiornamenti.

Pur riducendo l’esposizione, questo approccio introduce nuove superfici di attacco. Vulnerabilità come l’inversione dei gradienti e il data poisoning possono comunque rivelare informazioni private o manipolare i risultati. Garantire un apprendimento federato sicuro richiede una combinazione di crittografia, monitoraggio e solidi framework di conformità ai dati.

Comprendere l’Apprendimento Federato Sicuro

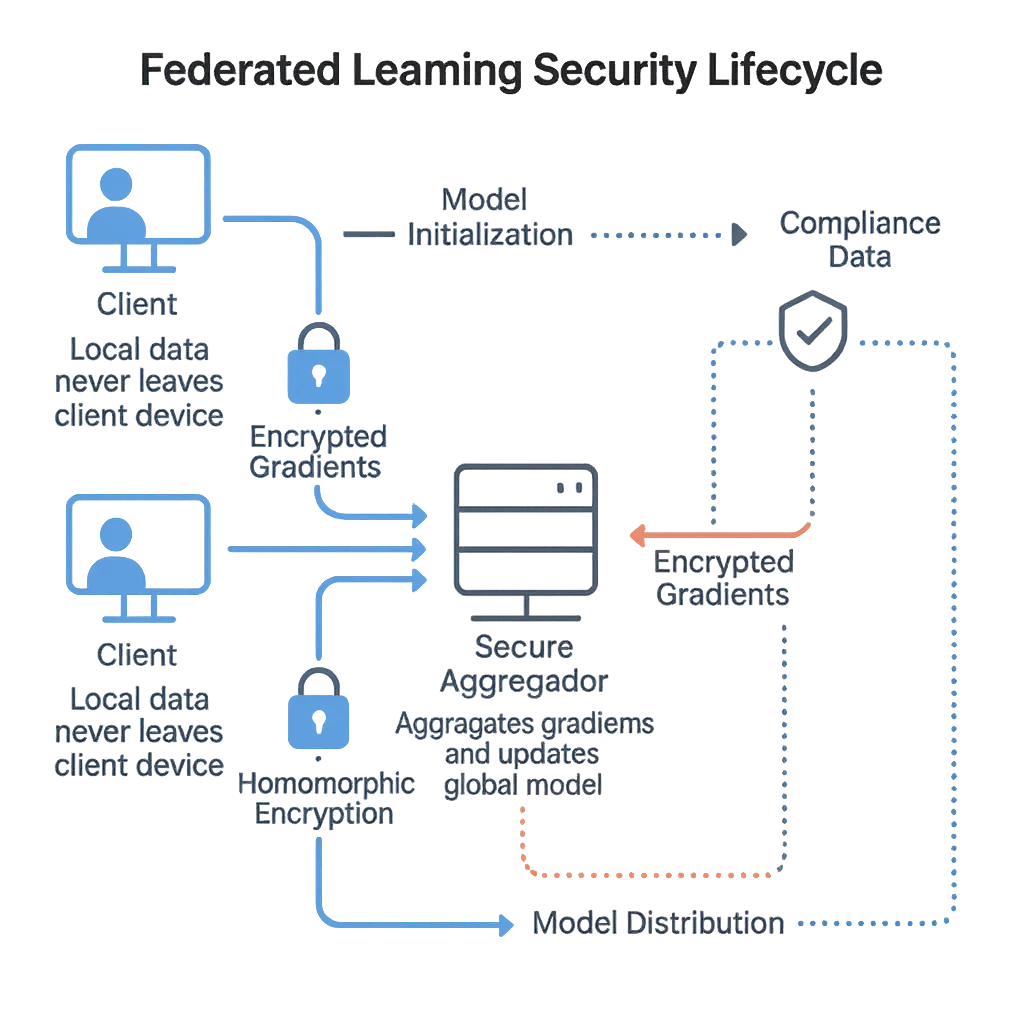

Nei sistemi federati, i partecipanti — spesso ospedali, banche o istituti di ricerca — addestrano collaborativamente un modello condiviso. Ogni nodo calcola gli aggiornamenti localmente e invia solo i parametri del modello o i gradienti a un aggregatore.

Tuttavia, gli attaccanti possono ancora ricostruire dati sensibili da questi gradienti. I ricercatori di Google AI hanno introdotto per primi il concetto, ma studi successivi hanno dimostrato che anche gradienti criptati possono trapelare informazioni identificabili se non gestiti correttamente.

È qui che entra in gioco l’apprendimento federato sicuro, introducendo:

Crittografia end-to-end

Monitoraggio delle attività per auditabilità

Rilevamento anomalie tramite analisi comportamentale

Queste misure garantiscono che gli aggiornamenti del modello rimangano verificabili, criptati e conformi in tutti i partecipanti.

Sfide Chiave per la Sicurezza

Attacchi di Inversione dei Gradienti – Gli avversari ricostruiscono campioni privati dai gradienti condivisi, esponendo PII (informazioni personali identificabili).

Avvelenamento del Modello – I contributori malevoli possono inserire dati distorti o backdoor, bypassando le difese del firewall.

Aggregatori Non Affidabili – Senza un rigoroso controllo degli accessi basato sui ruoli, i nodi centrali diventano punti unici di fallimento.

Deriva nella Conformità – I flussi di dati multi-giurisdizionali complicano l’adesione continua a GDPR e HIPAA.

Recenti revisioni accademiche, come Zhu et al. (2023), sottolineano che i modelli federati richiedono non solo crittografia ma anche una governance comportamentale — validazione dei contributi, controllo accessi e logging durante tutto il ciclo di vita del modello.

Implementare l’Aggregazione Sicura

Il seguente snippet Python dimostra un meccanismo semplificato di aggregazione sicura che valida la fiducia e filtra gli aggiornamenti malevoli prima dell’integrazione:

from typing import Dict, List

import hashlib

class FederatedSecurityAggregator:

def __init__(self, threshold: float = 0.7):

self.threshold = threshold

self.trust_registry: Dict[str, float] = {}

def hash_gradient(self, gradient: List[float]) -> str:

"""Genera un hash per la verifica dell’integrità."""

return hashlib.sha256(str(gradient).encode()).hexdigest()

def validate_node(self, node_id: str, gradient: List[float]) -> Dict:

"""Valuta l’affidabilità del nodo e rileva anomalie."""

gradient_hash = self.hash_gradient(gradient)

trust_score = self.trust_registry.get(node_id, 0.8)

malicious = trust_score < self.threshold

return {

"node": node_id,

"hash": gradient_hash,

"trust_score": trust_score,

"malicious": malicious,

"recommendation": "Escludi" if malicious else "Accetta"

}

def aggregate(self, updates: Dict[str, List[float]]):

"""Aggrega solo aggiornamenti verificati."""

return {

node: self.validate_node(node, grad)

for node, grad in updates.items()

}

Questa logica può essere integrata in log di audit e nella cronologia delle attività sui dati per tracciabilità e verifica della conformità.

Buone Pratiche di Implementazione

Per le Organizzazioni

Privacy-by-Design – Applica masking dinamico e masking statico dei dati prima dell’addestramento.

Strategia Unificata di Audit – Mantieni tracce di controllo continue audit trails tra i nodi usando strumenti di data discovery.

Conformità Regolamentare – Verifica l’aderenza ai framework regionali (GDPR, HIPAA, PCI DSS).

Collaborazione Criptata – Usa la crittografia del database per i canali inter-organizzativi.

Per i Team Tecnici

Trust Scoring – Mantieni metriche di affidabilità dei nodi tramite analisi comportamentale.

Sicurezza Reverse Proxy – Instrada tutto il traffico attraverso un reverse proxy per flussi di dati controllati.

Monitoraggio Centralizzato – Combina monitoraggio dell’attività del database con politiche di sicurezza adattive.

Validazione Continua – Rivaluta periodicamente gli aggiornamenti del modello e applica il principio del minimo privilegio.

FAQ: Apprendimento Federato Sicuro

D1. Cos’è il federated learning in una frase?

L’apprendimento federato consente a più parti di addestrare un modello condiviso conservando i dati grezzi localmente e condividendo solo gli aggiornamenti del modello.

D2. FL rende la condivisione dati conforme di default?

No — FL riduce l’esposizione ma servono ancora policy, logging e controlli per soddisfare framework come GDPR e HIPAA; usa controlli di conformità dei dati continui.

D3. Come prevenire fughe di dati da inversione dei gradienti?

Combina aggregazione sicura (es. calcolo multipartito o crittografia omomorfica) con rumore di differential privacy sugli aggiornamenti, più rigorosi controlli accesso e audit trails.

D4. Differenza tra TLS e Aggregazione Sicura?

TLS protegge gli aggiornamenti in transito; l’aggregazione sicura assicura che il server non veda aggiornamenti singoli anche se il trasporto è sicuro. Usa entrambi.

D5. Come si rilevano aggiornamenti avvelenati o backdoor?

Usa trust scoring e rilevamento anomalie (es. outlier di similarità coseno, filtri basati su perdita), isola nodi sospetti e applica il controllo accessi basato sui ruoli.

D6. Cosa fa esattamente un aggregatore?

Verifica e aggrega aggiornamenti criptati, produce un modello globale e lo ridistribuisce; non dovrebbe accedere a dati grezzi o aggiornamenti non anonimizzati dei client.

D7. Dove si inserisce la conformità nel ciclo?

Come uno strato di supervisione: monitora log, configurazioni e prove (impostazioni DP, cicli di vita delle chiavi, allineamenti policy) anziché ricevere i gradienti. Vedi monitoraggio attività database e log di audit.

D8. Serve differential privacy in ogni round?

Preferibilmente sì per dati sensibili; rumore per round con accounting della privacy limita le fughe cumulative mantenendo l’utilità.

D9. Posso mascherare campi sensibili prima dell’addestramento?

Sì — applica masking dinamico o masking statico al bordo in modo che i campi sensibili non entrino mai nella pipeline delle feature.

D10. Come fare logging senza perdere dati?

Registra metadata (colpi alle regole, budget DP, ID nodi, hash) e archiviali in storage di audit a prova di manomissione; evita payload grezzi.

D11. Qual è il ciclo di vita del modello in FL sicuro?

Inizializzazione → distribuzione ai client → addestramento locale → aggiornamento criptato → aggregazione sicura → validazione → aggiornamento modello globale → ridistribuzione; ripeti con versioning e rollback.

D12. Come aiuta DataSunrise?

Fornisce monitoraggio basato su proxy, crittografia, analisi comportamentale, enforcement delle policy e prove di conformità lungo tutta la pipeline federata.

Costruire Fiducia nell’IA Collaborativa

L’apprendimento federato dimostra che collaborazione e privacy possono coesistere — ma solo con audit trasparenti, crittografia e governance. Senza questi, rischia di diventare un punto cieco per lo sfruttamento.

Combinando aggregazione sicura, analisi comportamentale e allineamento regolamentare, DataSunrise fornisce le basi per un’IA collaborativa affidabile. I suoi moduli di Protezione dei Dati e Audit assicurano che ogni contributo al modello rimanga verificabile, tracciabile e conforme.

Letture Consigliate:

Proteggi i tuoi dati con DataSunrise

Metti in sicurezza i tuoi dati su ogni livello con DataSunrise. Rileva le minacce in tempo reale con il Monitoraggio delle Attività, il Mascheramento dei Dati e il Firewall per Database. Applica la conformità dei dati, individua le informazioni sensibili e proteggi i carichi di lavoro attraverso oltre 50 integrazioni supportate per fonti dati cloud, on-premises e sistemi AI.

Inizia a proteggere oggi i tuoi dati critici

Richiedi una demo Scarica ora