Strategie per la Privacy dei Dati per Modelli AI & LLM

Mentre l’intelligenza artificiale trasforma le operazioni aziendali, il 87% delle organizzazioni sta implementando modelli AI e LLM nei flussi di lavoro critici per l’azienda. Sebbene queste tecnologie offrano capacità senza precedenti, esse introducono complesse sfide per la privacy dei dati che i tradizionali framework per la privacy non sono in grado di affrontare adeguatamente.

Questa guida esamina strategie complete per la privacy dei dati per modelli AI e LLM, esplorando tecniche di implementazione che consentono alle organizzazioni di mantenere una protezione robusta della privacy, massimizzando al contempo il potenziale trasformativo dell’AI.

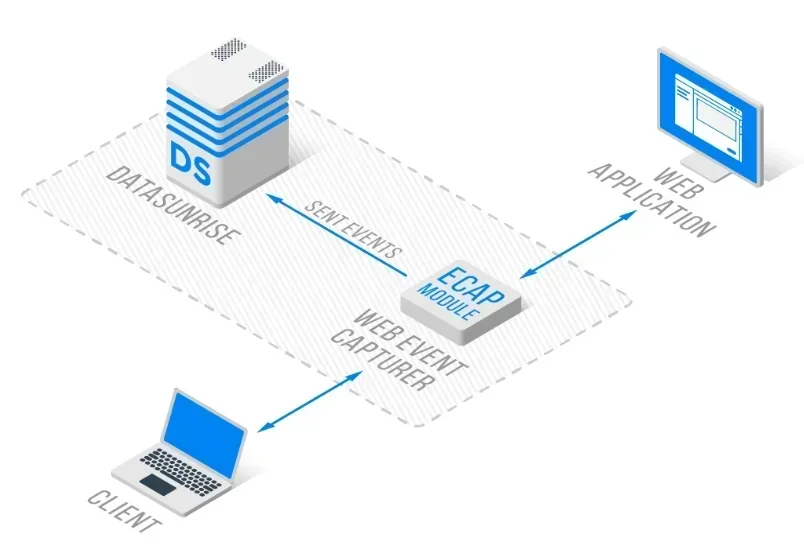

La piattaforma avanzata di Protezione della Privacy AI di DataSunrise offre una Orchestrazione della Privacy Zero-Touch con Protezione Autonoma dei Dati su tutte le principali piattaforme AI. Il nostro Framework Centralizzato per la Privacy AI integra perfettamente le strategie per la privacy con controlli tecnici, fornendo una gestione della privacy con precisione chirurgica per una protezione completa di AI e LLM con AI Compliance by Default.

Comprendere le Sfide della Privacy dei Dati in AI

I modelli AI e LLM elaborano enormi quantità di dati durante il loro ciclo di vita, creando rischi di esposizione della privacy senza precedenti. A differenza delle applicazioni tradizionali, i sistemi AI apprendono continuamente da fonti di dati diversificate, rendendo la protezione della privacy esponenzialmente più complessa.

Questi modelli spesso gestiscono informazioni sensibili, inclusi identificatori personali e dati aziendali riservati. Le organizzazioni devono implementare misure complete di sicurezza dei dati, mantenendo al contempo capacità di audit specificamente progettate per ambienti AI, in linea con le politiche di sicurezza appropriate.

Strategie Critiche per la Protezione della Privacy

Minimizzazione dei Dati e Limitazione dello Scopo

Le strategie per la privacy AI devono implementare principi rigorosi di minimizzazione dei dati, assicurando che i modelli elaborino solo le informazioni essenziali per il loro scopo previsto. Le organizzazioni dovrebbero applicare tecniche di Mascheramento Dinamico dei Dati e implementare controlli di accesso granulari con protezione tramite database firewall.

Tecniche di Addestramento che Preservano la Privacy

Le strategie avanzate per la privacy includono l’implementazione di differential privacy, approcci di federated learning e synthetic data generation per l’addestramento dei modelli. Queste tecniche consentono lo sviluppo AI proteggendo la privacy individuale attraverso garanzie matematiche con l’implementazione di database encryption.

Monitoraggio della Privacy in Tempo Reale

Una privacy AI efficace richiede un monitoraggio continuo dei flussi di dati, il rilevamento automatizzato di PII e immediati avvisi in caso di violazioni della privacy. Le organizzazioni devono implementare sistemi di database activity monitoring con behavioral analytics e tracce di audit complete.

Esempi di Implementazione Tecnica

Pre-elaborazione dei Dati che Preserva la Privacy

L’implementazione seguente dimostra come rilevare automaticamente e mascherare PII nei dati testuali prima dell’elaborazione da parte dell’AI. Questo approccio garantisce che le informazioni sensibili siano protette, mantenendo al contempo l’utilità dei dati per i modelli AI:

import hashlib

import re

class AIPrivacyPreprocessor:

def __init__(self):

self.pii_patterns = {

'email': r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b',

'phone': r'\b\d{3}-\d{3}-\d{4}\b',

'ssn': r'\b\d{3}-\d{2}-\d{4}\b'

}

def mask_sensitive_data(self, text: str):

"""Maschera PII nel testo prima dell'elaborazione AI"""

masked_text = text

detected_pii = []

for pii_type, pattern in self.pii_patterns.items():

matches = re.findall(pattern, text)

for match in matches:

masked_value = f"[{pii_type.upper()}_MASKED]"

masked_text = masked_text.replace(match, masked_value)

detected_pii.append({'type': pii_type, 'original': match})

return {

'masked_text': masked_text,

'detected_pii': detected_pii,

'privacy_score': 1.0 if not detected_pii else 0.7

}

Sistema di Audit per la Privacy dei Modelli AI

Questa implementazione mostra come creare un sistema di audit completo che monitora le interazioni AI per eventuali violazioni della privacy e genera report di conformità:

from datetime import datetime

class AIModelPrivacyAuditor:

def __init__(self, privacy_threshold: float = 0.8):

self.privacy_threshold = privacy_threshold

self.audit_log = []

def audit_model_interaction(self, user_id: str, prompt: str, response: str):

"""Audit completo della privacy per le interazioni con il modello AI"""

audit_record = {

'timestamp': datetime.utcnow().isoformat(),

'user_id': user_id,

'interaction_id': hashlib.md5(f"{user_id}{datetime.utcnow()}".encode()).hexdigest()[:12]

}

# Analizza i rischi per la privacy

privacy_score = self._calculate_privacy_score(prompt + response)

audit_record['privacy_score'] = privacy_score

audit_record['compliant'] = privacy_score >= self.privacy_threshold

self.audit_log.append(audit_record)

return audit_record

def _calculate_privacy_score(self, text: str):

"""Calcola il punteggio di privacy basato sul rilevamento di PII"""

pii_patterns = [r'\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\.[A-Z|a-z]{2,}\b']

score = 1.0

for pattern in pii_patterns:

if re.search(pattern, text):

score -= 0.3

return max(score, 0.0)

Best Practices di Implementazione

Per le Organizzazioni:

- Architettura Privacy-by-Design: Integrare i controlli per la privacy nei sistemi AI fin dalle fasi iniziali, utilizzando il controllo accessi basato sui ruoli (role-based access control).

- Protezione a Strati Multipli: Implementare controlli per la privacy completi durante le fasi di addestramento e inferenza.

- Monitoraggio Continuo: Implementare il monitoraggio della privacy in tempo reale con protocolli di vulnerability assessment (vulnerability assessment).

Per i Team Tecnici:

- Controlli per la Privacy Automatizzati: Implementare il data masking e meccanismi di protezione dinamica (data masking).

- Tecniche che Preservano la Privacy: Utilizzare federated learning e differential privacy con static data masking (static data masking).

- Risposta agli Incidenti: Creare procedure di risposta specifiche per la privacy, integrando capacità di threat detection (threat detection) e protezione dei dati.

DataSunrise: Soluzione Completa per la Privacy AI

DataSunrise offre protezione per la privacy dei dati di livello enterprise, progettata specificamente per ambienti AI e LLM. La nostra soluzione garantisce Maximum Security, Minimum Risk con AI Compliance by Default su ChatGPT, Amazon Bedrock, Azure OpenAI, Qdrant e implementazioni AI personalizzate.

Caratteristiche Chiave:

- Monitoraggio della Privacy in Tempo Reale: Monitoraggio AI Zero-Touch con tracce di audit complete (audit logs).

- Protezione Avanzata dei PII: Protezione contestuale con Mascheramento dei Dati a precisione chirurgica.

- Copertura Cross-Platform: Protezione unificata della privacy su oltre 50 piattaforme supportate (50+ supported platforms).

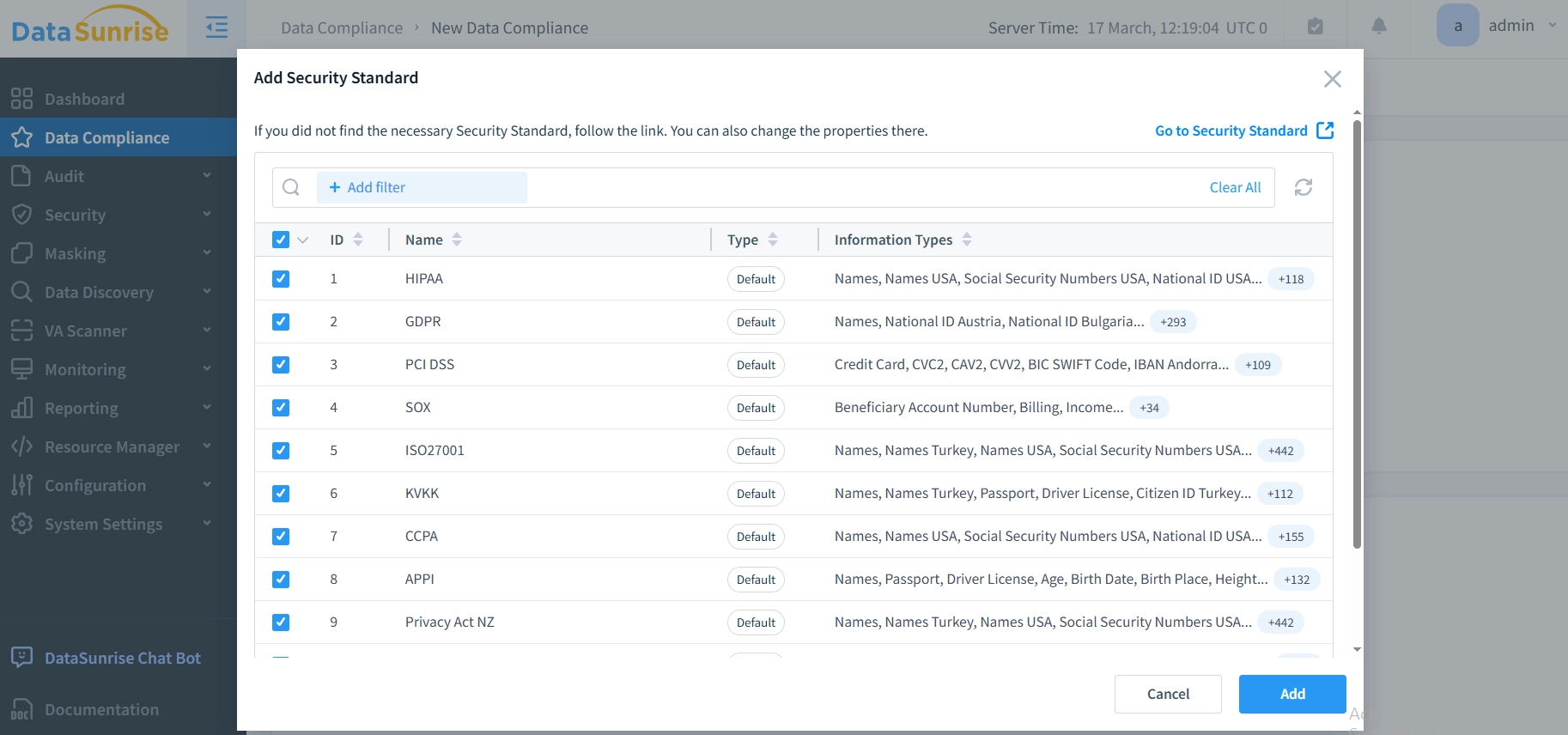

- Conformità Automatizzata: Compliance Autopilot per i requisiti di GDPR, HIPAA, PCI DSS (datasunrise compliance manager).

- Rilevamento basato su ML: Rilevamento di comportamenti sospetti con identificazione di anomalie nella privacy (LLM and ML tools for database security).

Le Modalità di Implementazione Flessibili di DataSunrise supportano ambienti AI on-premise, Cloud e ibridi con implementazione Zero-Touch. Le organizzazioni ottengono una riduzione significativa dei rischi per la privacy e una maggiore conformità alle normative grazie al monitoraggio automatizzato.

Considerazioni sulla Conformità Normativa

Le strategie per la privacy dei dati in AI devono soddisfare requisiti normativi completi:

- Protezione dei Dati: Il GDPR e il CCPA richiedono salvaguardie specifiche per la privacy durante l’elaborazione dei dati in AI.

- Standard di Settore: Il settore sanitario (HIPAA) e quello dei servizi finanziari (PCI DSS) hanno requisiti specifici.

- Governance Emergente per l’AI: L’EU AI Act e la ISO 42001 impongono il principio privacy-by-design nei sistemi AI.

Conclusione: Costruire Sistemi AI con la Privacy al Primo Posto

Le strategie per la privacy dei dati in AI e nei modelli LLM rappresentano requisiti essenziali per un’implementazione responsabile dell’AI. Le organizzazioni che implementano framework completi per la privacy si posizionano per sfruttare il potenziale trasformativo dell’AI, mantenendo al contempo la fiducia degli stakeholder e la conformità normativa.

Una privacy AI efficace si trasforma da onere di conformità a vantaggio competitivo. Implementando strategie robuste per la privacy con monitoraggio automatizzato, le organizzazioni possono implementare innovazioni AI con fiducia, proteggendo le informazioni sensibili durante l’intero ciclo di vita dell’AI.

Proteggi i tuoi dati con DataSunrise

Metti in sicurezza i tuoi dati su ogni livello con DataSunrise. Rileva le minacce in tempo reale con il Monitoraggio delle Attività, il Mascheramento dei Dati e il Firewall per Database. Applica la conformità dei dati, individua le informazioni sensibili e proteggi i carichi di lavoro attraverso oltre 50 integrazioni supportate per fonti dati cloud, on-premises e sistemi AI.

Inizia a proteggere oggi i tuoi dati critici

Richiedi una demo Scarica ora