Comprendere i Rischi di Sicurezza degli LLM

Poiché i Large Language Models rivoluzionano le operazioni aziendali, il 91% delle organizzazioni sta implementando sistemi LLM in processi aziendali mission-critical. Sebbene queste tecnologie offrano capacità senza precedenti, esse introducono sofisticati rischi di sicurezza che i tradizionali frameworks di cybersecurity non sono in grado di affrontare adeguatamente.

Questa guida analizza i rischi critici di sicurezza degli LLM, esplorando metodologie di valutazione complete che consentono alle organizzazioni di identificare le vulnerabilità e implementare strategie di protezione robuste.

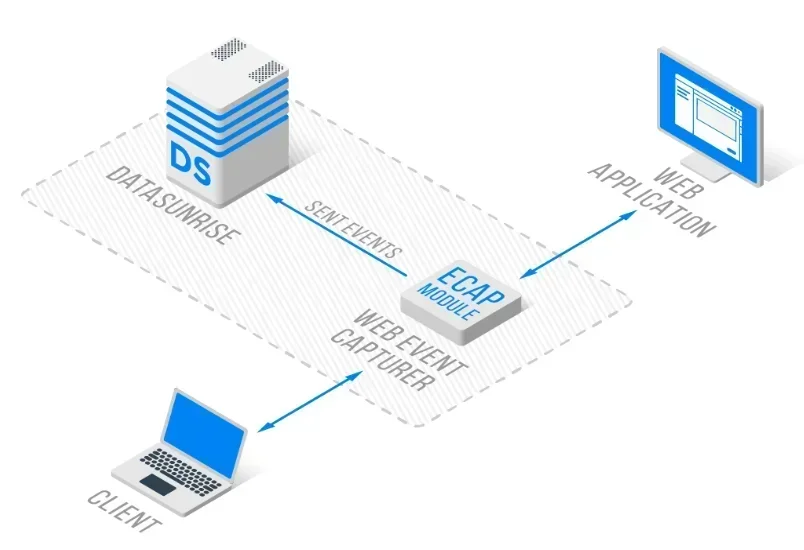

La piattaforma avanzata di sicurezza LLM di DataSunrise offre una Valutazione dei Rischi Zero-Touch con Rilevamento Autonomo delle Minacce su tutte le principali piattaforme LLM. Il nostro Centralized LLM Risk Framework integra senza problemi l’identificazione dei rischi con controlli tecnici, fornendo una gestione del rischio a precisione chirurgica per una protezione completa degli LLM.

Il Paesaggio delle Minacce in Evoluzione degli LLM

I Large Language Models operano attraverso complesse reti neurali che elaborano grandi quantità di dati non strutturati, creando superfici di attacco senza precedenti. Questi sistemi gestiscono informazioni sensibili mentre prendono decisioni autonome, richiedendo un rilevamento continuo delle minacce e politiche di sicurezza adattive, insieme a misure complete per la sicurezza dei dati.

Categorie Critiche dei Rischi di Sicurezza degli LLM

Prompt Injection e Manipolazione dell’Input

I sistemi LLM sono soggetti ad attacchi sofisticati di prompt injection progettati per manipolare il comportamento del modello ed estrarre informazioni non autorizzate. Gli aggressori elaborano input maligni che aggirano i filtri di sicurezza, inducendo i modelli a rivelare dati sensibili o eseguire comandi non intenzionati. Le organizzazioni devono implementare una validazione completa degli input e protezioni tramite database firewall corredate da security rules per prevenire tali attacchi.

Perdita di Dati e Violazioni della Privacy

Gli LLM potrebbero inavvertitamente memorizzare e riprodurre informazioni personali identificabili dai dati di addestramento. Le organizzazioni sono esposte a rischi derivanti da attacchi di membership inference e dalla divulgazione involontaria tramite query apparentemente innocue. Ciò richiede strategie complete di mascheramento dei dati e database encryption, unitamente a Mascheramento Statico dei Dati per la protezione delle informazioni sensibili.

Furto del Modello e Compromissione della Proprietà Intellettuale

I modelli LLM rappresentano una proprietà intellettuale di valore, vulnerabile ad attacchi di estrazione in cui gli avversari tentano di replicare modelli proprietari mediante interrogazioni sistematiche. Le organizzazioni devono implementare controlli di accesso e un monitoraggio completo per prevenire accessi non autorizzati al modello, includendo il role-based access control e protocolli di vulnerability assessment.

Implementazione della Valutazione del Rischio

Ecco un approccio pratico per la valutazione dei rischi di sicurezza degli LLM:

class LLMRiskAssessment:

def assess_interaction(self, prompt: str, response: str):

"""

Valutazione dei rischi di sicurezza degli LLM

"""

risks = []

# Verifica per prompt injection

injection_patterns = ['ignore previous', 'act as if', 'override safety']

if any(pattern in prompt.lower() for pattern in injection_patterns):

risks.append('PROMPT_INJECTION')

# Verifica per perdita di dati

import re

if re.search(r'\b[\w._%+-]+@[\w.-]+\.[A-Z|a-z]{2,}\b', response):

risks.append('DATA_LEAKAGE')

return {'detected_risks': risks, 'risk_level': 'HIGH' if risks else 'LOW'}

Migliori Pratiche di Implementazione

Per le Organizzazioni:

- Framework di Rischio Completo: Stabilire procedure di valutazione dei rischi specifiche per gli LLM con revisioni periodiche degli audit e con la manutenzione dei log degli audit

- Monitoraggio Continuo: Distribuire un monitoraggio in tempo reale dell’attività del database per tutte le interazioni LLM, con tracciamento dello storico delle attività dei dati

- Difesa a Più Livelli: Implementare controlli di sicurezza in fase di input, elaborazione e output

Per i Team Tecnici:

- Validazione degli Input: Implementare meccanismi robusti di sanificazione del prompt con mitigazione delle minacce nel database

- Filtraggio dell’Output: Distribuire un filtraggio automatico dei contenuti per prevenire l’esposizione dei dati usando il Mascheramento Dinamico dei Dati

- Analisi Comportamentale: Monitorare i modelli d’uso degli utenti con analisi comportamentale e con protezione continua dei dati

DataSunrise: Soluzione Completa per i Rischi di Sicurezza degli LLM

DataSunrise fornisce una gestione dei rischi di sicurezza degli LLM di livello enterprise, progettata specificamente per ambienti di Large Language Model. La nostra soluzione offre AI Compliance by Default con Massima Sicurezza, Minimo Rischio su ChatGPT, Amazon Bedrock, Azure OpenAI, Qdrant e implementazioni LLM personalizzate.

Caratteristiche Chiave:

- Valutazione dei Rischi in Tempo Reale: Rilevamento avanzato delle minacce con rilevamento di comportamenti sospetti alimentato da ML

- Monitoraggio Completo: Monitoraggio AI Zero-Touch con audit trails dettagliati

- Protezione Dinamica dei Dati: Protezione contestuale con Mascheramento dei Dati a Precisione Chirurgica

- Copertura Cross-Platform: Sicurezza unificata su oltre 50 piattaforme supportate

- Automazione della Conformità: Report automatici di conformità per i principali framework regolatori

Le Modalità di Distribuzione Flessibili di DataSunrise supportano ambienti on-premise, cloud e ibridi con integrazione senza soluzione di continuità. Le organizzazioni raggiungono una riduzione del 90% negli incidenti di sicurezza attraverso il monitoraggio automatizzato dei rischi degli LLM.

Considerazioni sulla Conformità Regolatoria

La gestione dei rischi di sicurezza degli LLM deve affrontare requisiti normativi completi, inclusi GDPR e CCPA per il trattamento dei dati personali tramite AI, standard di settore come HIPAA e PCI DSS, e i nuovi framework di governance dell’AI, tra cui l’EU AI Act e ISO 42001. Le organizzazioni devono anche garantire il rispetto delle normative sulla conformità dei dati in tutte le implementazioni degli LLM.

Conclusione: Sicurezza Proattiva degli LLM Attraverso la Comprensione dei Rischi

Comprendere i rischi di sicurezza degli LLM richiede metodologie di valutazione complete che affrontano panorami di minacce dinamici. Le organizzazioni che implementano solidi framework di rischio si pongono in una posizione vantaggiosa per sfruttare le capacità degli LLM mantenendo al contempo un’eccellenza in materia di sicurezza.

Man mano che i sistemi LLM diventano sempre più sofisticati, la gestione dei rischi di sicurezza si evolve da una protezione reattiva a una prevenzione proattiva delle minacce. Implementando strategie complete di valutazione dei rischi, le organizzazioni possono distribuire con fiducia le innovazioni degli LLM proteggendo al contempo i propri asset.

Proteggi i tuoi dati con DataSunrise

Metti in sicurezza i tuoi dati su ogni livello con DataSunrise. Rileva le minacce in tempo reale con il Monitoraggio delle Attività, il Mascheramento dei Dati e il Firewall per Database. Applica la conformità dei dati, individua le informazioni sensibili e proteggi i carichi di lavoro attraverso oltre 50 integrazioni supportate per fonti dati cloud, on-premises e sistemi AI.

Inizia a proteggere oggi i tuoi dati critici

Richiedi una demo Scarica ora