Sicurezza degli Agenti LLM in Scenari RAG/RLHF

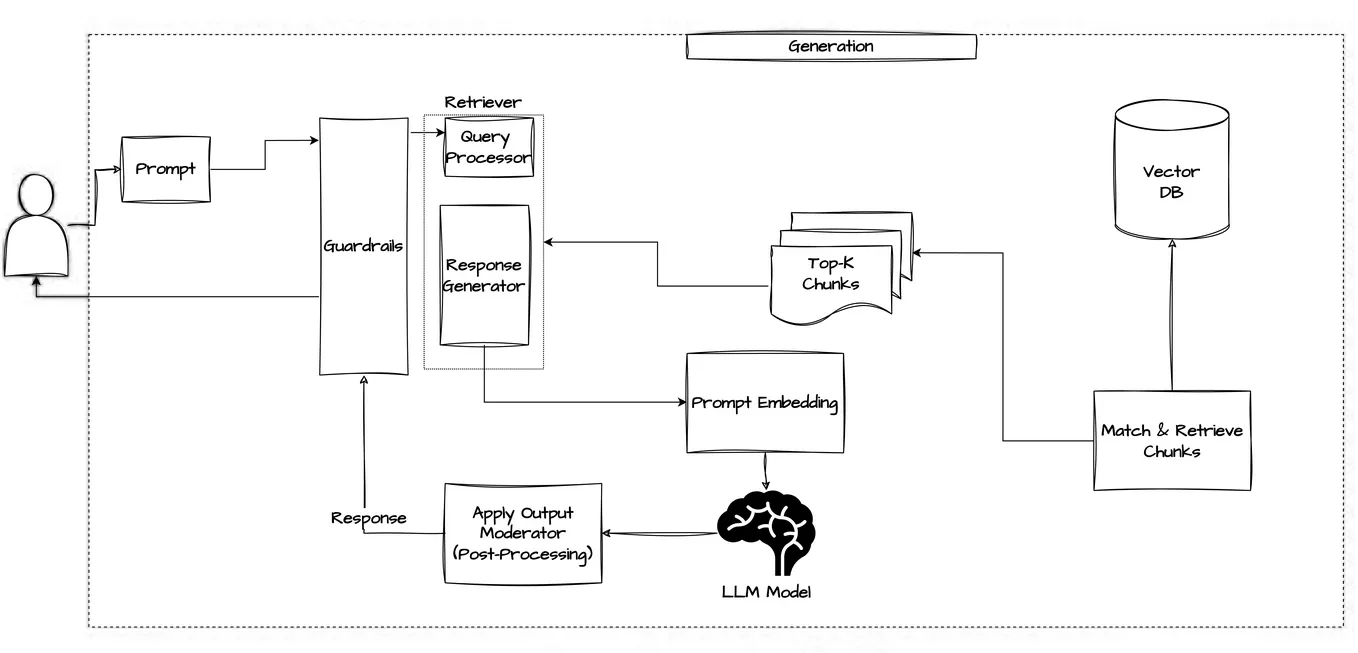

Gli agenti dei modelli linguistici (LLM) stanno guadagnando terreno nei flussi di lavoro di Generazione Aumentata dal Recupero (RAG) e di Apprendimento per Rinforzo dal Feedback Umano (RLHF). Questi agenti intelligenti migliorano la comprensione del contesto, automatizzano i flussi di dati e offrono risposte adattative. Tuttavia, la loro integrazione in pipeline di dati sensibili introduce rischi di sicurezza e conformità che devono essere gestiti in maniera proattiva.

Vulnerabilità di Sicurezza Introdotte dagli Agenti LLM

Gli LLM operano spesso su dati eterogenei estratti in tempo reale da repository interni e banche dati esterne. Nei flussi di lavoro RAG, gli agenti interrogano database vettoriali e iniettano il contesto recuperato nei prompt. Nei pipeline RLHF, interagiscono con dati di training etichettati manualmente o con log di feedback. Questa ampia superficie d’accesso apre a rischi di iniezione nel prompt, fuga di dati e riproduzione di comportamenti non controllati.

Senza controlli adeguati, gli agenti LLM possono accedere e divulgare dati aziendali sensibili, propagare feedback manipolato o interagire con dataset non conformi. Questi rischi richiedono un monitoraggio continuo, il mascheramento dei dati e l’applicazione delle politiche lungo i processi di inferenza e feedback degli LLM. Come evidenziato nel sistema di progettazione AI sicuro di Google, queste sfide devono essere affrontate proattivamente sin dall’inizio della progettazione.

Audit in Tempo Reale delle Interazioni degli LLM

Per tracciare il funzionamento degli agenti e capire quali dati vengono manipolati, è essenziale un audit in tempo reale. Ciò include il tracciamento del contenuto delle query, le associazioni utente-agente, i risultati vettoriali recuperati, le strutture dei prompt e i completamenti risultanti. La registrazione di questi metadati aiuta a rilevare comportamenti anomali, a ricostruire le catene decisionali e a dimostrare la conformità a HIPAA, GDPR e PCI DSS.

Soluzioni come la piattaforma Data Audit di DataSunrise lo consentono grazie a regole di audit personalizzabili, che monitorano l’attività di query strutturate e non strutturate. Le regole di audit possono essere configurate per segnalare parole chiave specifiche, tentativi di accesso o payload vettoriali iniettati nei prompt. Analogamente, Azure Monitor per LLM di Microsoft mostra come gli eventi a runtime possano essere registrati e visualizzati su larga scala.

Mascheramento Dinamico dei Dati per Pipeline GenAI

Il mascheramento dinamico dei dati assicura che campi sensibili, come nomi, indirizzi email o numeri di conto, vengano sostituiti in tempo reale prima di essere passati al modello. Ciò è particolarmente cruciale negli ambienti RAG, dove un agente recupera dati che possono includere attributi riservati.

Con il mascheramento dinamico, i dati sorgente originali rimangono intatti mentre differenti utenti o tipologie di agenti ottengono viste personalizzate in base al loro ruolo o contesto. Per esempio:

SELECT full_name, credit_card FROM customers;

-- diventa --

SELECT '***MASKED***' AS full_name, 'XXXX-XXXX-XXXX-1234' AS credit_card;

Questo protegge la privacy consentendo al modello di interagire con dati realistici, seppur anonimizzati. Il mascheramento è anche una parte essenziale delle linee guida NIST per la mitigazione dei rischi GenAI.

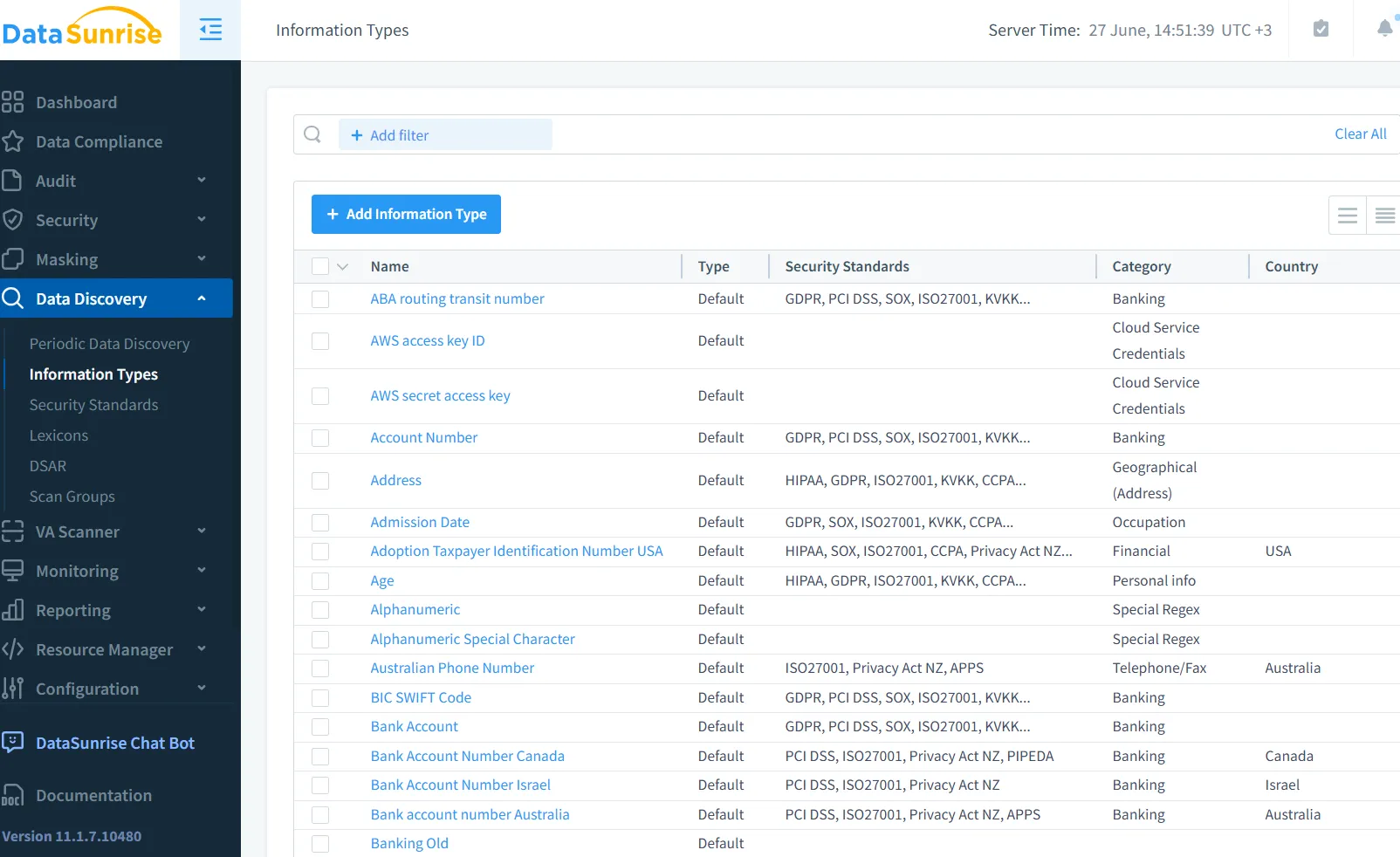

Scoperta dei Dati come Fondamento della Sicurezza

Prima di applicare qualsiasi politica di mascheramento o accesso, è fondamentale individuare dove risiedono i dati. Gli strumenti di data discovery possono scansionare database, archivi vettoriali e log non strutturati per identificare tipi di dati sensibili. Questo è particolarmente utile quando si costruiscono LLM su sistemi legacy, dove la documentazione è limitata.

Il motore di discovery di DataSunrise supporta la classificazione basata su pattern, ricerche in dizionari e classificazioni assistite da AI per identificare nuovi tipi di dati. Una volta mappato, questo inventario guida la progettazione delle politiche e aiuta a stabilire soglie appropriate per il mascheramento, la registrazione o gli avvisi. Analogamente, AWS Macie può aiutare a identificare dati sensibili in bucket S3 utilizzati dai motori di recupero vettoriale.

Applicazione della Sicurezza attraverso Regole di Accesso

La sicurezza deve operare a più livelli: il database, il gateway API e il punto finale di servizio del modello. Definire e applicare regole di accesso — come il blocco di IP non affidabili, il restringimento delle join tra domini di dati o la limitazione della lunghezza dei prompt — aiuta a prevenire abusi.

Il motore di regole di sicurezza di DataSunrise consente ai team di stabilire controlli granulari contro iniezioni, esfiltrazioni o usi impropri. Gli agenti LLM possono essere inseriti in una lista bianca o ricevere accesso basato sui ruoli per specifici tipi di query, limitando così le loro capacità e minimizzando l’esposizione.

Questo aiuta anche a mitigare gli attacchi di iniezione nei prompt, in cui gli agenti tentano di evadere i loro vincoli per accedere alla logica interna o ai dati. Per indicazioni su come difendersi da tali attacchi, vedere i Top 10 rischi degli LLM di OWASP.

Mappatura della Conformità e Assicurazione Continua

Con i modelli GenAI ormai integrati nei sistemi di produzione, il controllo normativo è in aumento. Allineare le pipeline degli LLM agli standard di conformità richiede la classificazione dei dati, la documentazione, il tracciamento dei consensi, la limitazione dell’esposizione e report periodici.

Il Compliance Manager di DataSunrise supporta questo collegando tracce di audit, configurazioni di mascheramento e gerarchie di ruoli in un’interfaccia centralizzata per la conformità. Offre modelli predefiniti per HIPAA, PCI DSS, SOX e GDPR, semplificando i controlli interni e le verifiche esterne.

Inoltre, fare riferimento alle linee guida del Regolamento UE sull’IA per comprendere le nuove obbligazioni legali relative ai modelli fondamentali e ai sistemi AI che interagiscono con dati sensibili o regolamentati.

Applicare Questi Strumenti nei Flussi di Lavoro RAG/RLHF

In uno scenario RAG pratico, un agente LLM potrebbe eseguire una ricerca vettoriale per casi legali contenenti una specifica norma. Il database vettoriale potrebbe includere sia documenti legali pubblici sia documenti interni. Per garantire la conformità, la fase di scoperta segnala record sensibili, il mascheramento offusca gli identificatori dei clienti, i log di audit catturano il contesto delle query e le regole di accesso limitano operazioni non sicure.

Nei pipeline RLHF, il feedback umano spesso contiene commenti o etichette confidenziali degli utenti. Questi devono essere opportunamente mascherati, registrati e archiviati in conformità alle politiche. Per esempio, il whitepaper RLHF di Anthropic illustra come strutturare i pipeline di feedback tenendo in considerazione la privacy.

Considerazioni Finali

La sicurezza degli agenti LLM negli scenari RAG/RLHF richiede più di una semplice messa a punto del modello o della validazione umana. Il controllo in tempo reale sul flusso dei dati — cioè su ciò che viene recuperato, mascherato e registrato — è fondamentale. Combinando tracce di audit, strategie di mascheramento, scansioni di discovery e controlli di accesso con l’automazione della conformità, le organizzazioni possono implementare sistemi GenAI sicuri e responsabili.

Scopri di più sull’automazione della conformità dei dati oppure consulta gli strumenti di sicurezza per database consapevoli degli LLM per preparare la tua infrastruttura a sistemi AI di livello produttivo.

Proteggi i tuoi dati con DataSunrise

Metti in sicurezza i tuoi dati su ogni livello con DataSunrise. Rileva le minacce in tempo reale con il Monitoraggio delle Attività, il Mascheramento dei Dati e il Firewall per Database. Applica la conformità dei dati, individua le informazioni sensibili e proteggi i carichi di lavoro attraverso oltre 50 integrazioni supportate per fonti dati cloud, on-premises e sistemi AI.

Inizia a proteggere oggi i tuoi dati critici

Richiedi una demo Scarica ora