Strategie di Protezione dei Dati in Ambienti GenAI e LLM

L’intelligenza artificiale generativa (GenAI) e i modelli di linguaggio di grandi dimensioni (LLM) stanno rivoluzionando il modo in cui le organizzazioni automatizzano, analizzano e generano contenuti. Questi sistemi operano su enormi dataset, che spesso contengono informazioni sensibili o soggette a regolamentazioni. Senza adeguate misure di sicurezza, potrebbero esporre involontariamente dati privati o riprodurli nei risultati. Tale rischio aumenta quando questi modelli vengono integrati nelle pipeline di produzione per il supporto clienti, la programmazione o l’analisi. Esperti, come quelli del Centro Harvard Berkman Klein, hanno sollevato preoccupazioni su come gli LLM gestiscano i dati sensibili utilizzati per l’addestramento.

Strategie di Protezione dei Dati Fondamentali in Ambienti GenAI e LLM

Per mantenere il controllo sui dati sensibili nei sistemi GenAI, le aziende devono adottare difese a più livelli. Le strategie più efficaci combinano audit in tempo reale, mascheramento dinamico, scoperta automatizzata e applicazione delle politiche. Esploriamo come queste tecniche collaborino per creare una protezione robusta.

Audit in Tempo Reale e Registrazione Trasparente

L’audit in tempo reale aiuta a rilevare e comprendere come i dati vengano accessi o interrogati dai processi GenAI. Ad esempio, se un prompt dovesse attivare accidentalmente l’accesso agli indirizzi dei clienti, una traccia di audit in tempo reale registra l’evento per una revisione immediata. Questo risulta particolarmente utile quando gli LLM sono collegati a database mediante ricerche vettoriali o generazione aumentata dal recupero (RAG).

DataSunrise fornisce regole di audit flessibili e monitoraggio delle sessioni, catturando query SQL, sessioni utente e anomalie comportamentali. Questi log di audit possono essere esportati o integrati con strumenti SIEM, offrendo un livello continuo di conformità. Per ulteriori informazioni sulle opzioni di configurazione dell’audit.

L’importanza della tracciabilità negli LLM è evidenziata in iniziative come la System Card di GPT-4 di OpenAI, che sottolinea i rischi legati a fughe involontarie di informazioni.

SELECT * FROM customers WHERE notes ILIKE '%refund%';

Se tale query viene attivata da un modello GenAI, essa viene immediatamente registrata, etichettata in base al livello di rischio e, a seconda delle politiche, eventualmente bloccata o mascherata.

Mascheramento Dinamico dei Dati in Tempo Reale

Il mascheramento statico è utile per anonimizzare i dataset prima dell’addestramento, ma nei flussi di lavoro di produzione GenAI il mascheramento dinamico è essenziale. Questa tecnica nasconde in tempo reale i campi sensibili senza modificare i dati di origine. Quando un agente GenAI interroga il backend, le risposte mascherate garantiscono la conformità senza interrompere il servizio.

-- Esempio: Applica la maschera dinamica alla colonna SSN

CREATE MASKING RULE mask_ssn

ON customers(ssn)

USING FULL MASK;

Il mascheramento dinamico garantisce che gli LLM, addestrati su fonti di dati in tempo reale, non restituiscano mai identificatori grezzi, anche quando i prompt siano inaspettati o malevoli. Combinato con politiche RBAC, limita l’esposizione per utenti specifici e agenti IA.

Come osservato dal NIST nel suo AI Risk Management Framework, i controlli di accesso contestuali e il mascheramento sono fondamentali per proteggere i dataset di alto valore nei sistemi di IA.

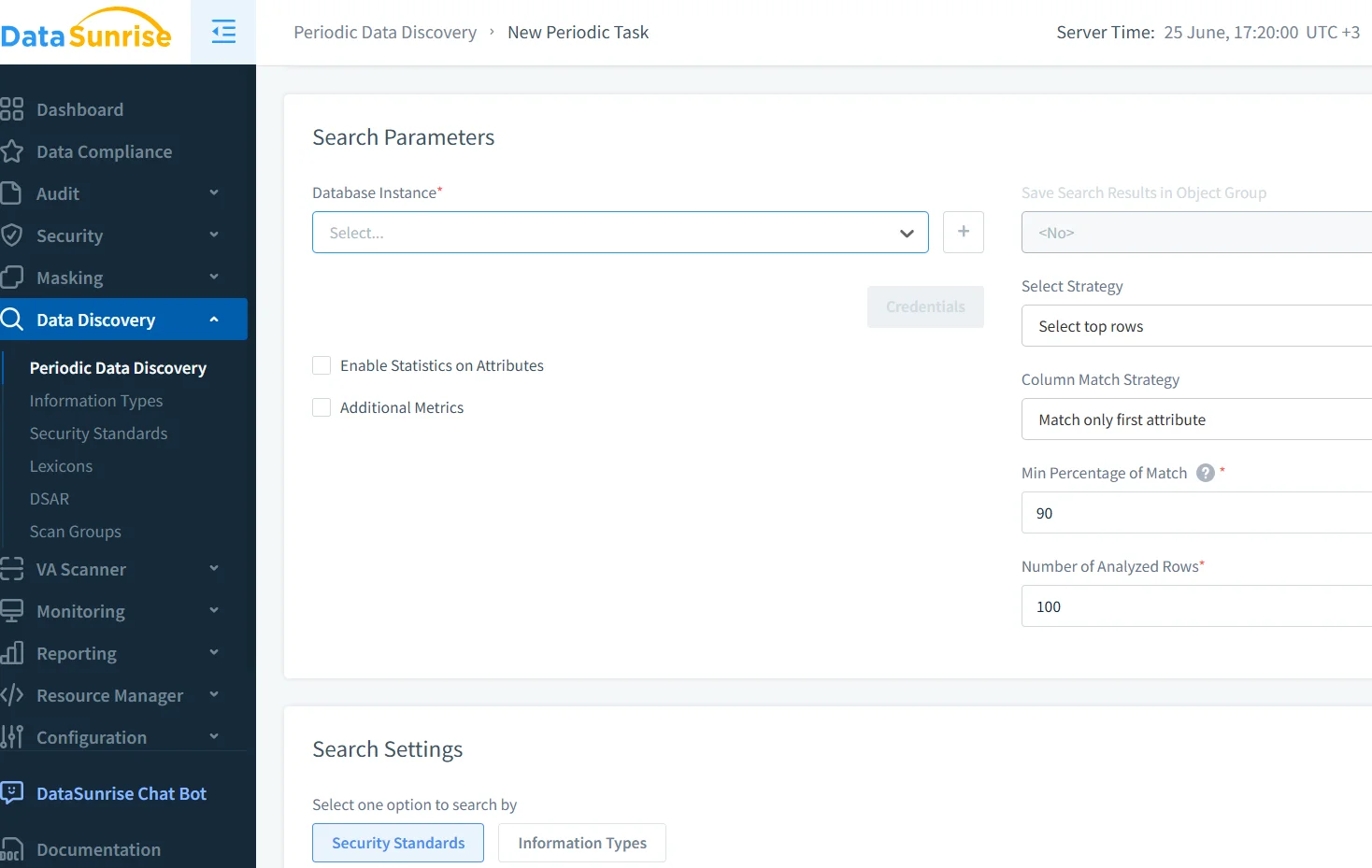

Scoperta e Classificazione Automatizzata dei Dati

Prima di poter proteggere i dati, è necessario sapere dove essi risiedono. Le scansioni automatizzate di scoperta dei dati aiutano a individuare PII, PHI, registrazioni finanziarie o contenuti regolamentati in archivi strutturati e semi-strutturati. Ciò è fondamentale per le applicazioni GenAI che attingono da molteplici data lake o indici vettoriali.

DataSunrise consente scansioni periodiche o on-demand con etichettatura e classificazione in base alla sensibilità. In combinazione con i moduli di audit e mascheramento, la scoperta accresce la visibilità e garantisce che nuove fonti non vengano trascurate.

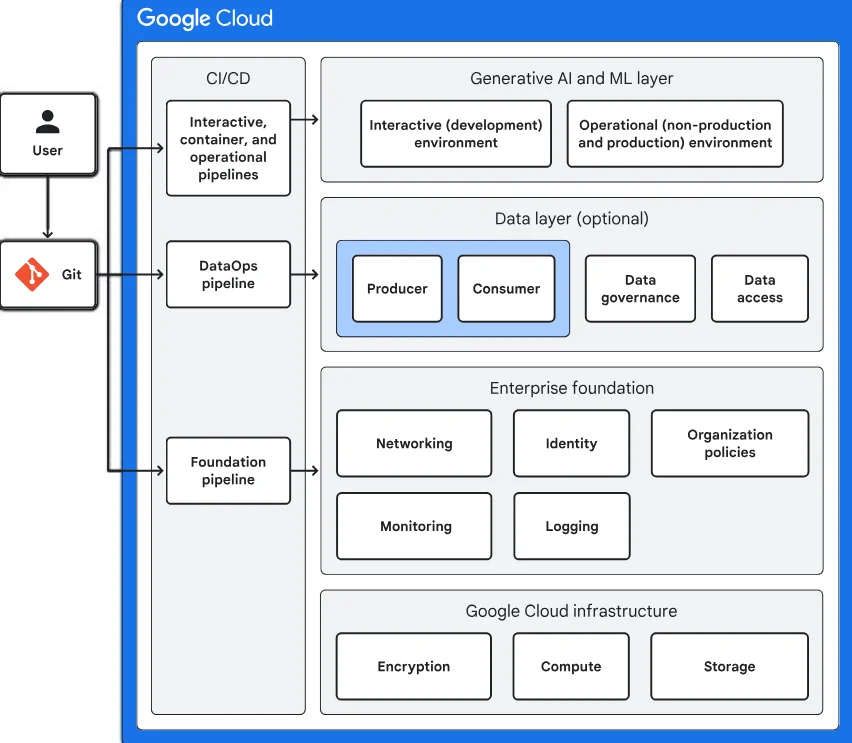

Strumenti come il Sensitive Data Protection di Google offrono approcci complementari alla classificazione automatica in ambienti cloud-native.

Garantire la Sicurezza nelle Implementazioni GenAI

Oltre ad audit e mascheramento, le implementazioni GenAI necessitano di una protezione attiva contro minacce come l’iniezione di prompt, la fuga di inferenze o la memorizzazione accidentale. Diversi ulteriori approcci contribuiscono a questo:

- Analisi comportamentale per rilevare pattern di query insoliti

- Controlli di accesso basati su politiche per integrazioni esterne

- Prevenzione dell’iniezione SQL durante la traduzione del linguaggio naturale

DataSunrise integra queste tecniche attraverso la sua piattaforma di sicurezza dei dati. Con regole di sicurezza personalizzate per i flussi di lavoro GenAI, gli amministratori possono ispezionare i flussi di input/output e bloccare operazioni sospette prima che raggiungano il livello del database.

Le ricerche del Center for Research on Foundation Models di Stanford evidenziano ulteriormente la necessità di protezioni in tempo reale e framework di sicurezza a più livelli durante l’implementazione degli LLM.

Allineamento Normativo e Gestione della Conformità

La conformità è spesso il catalizzatore delle strategie di protezione dei dati. Che i modelli GenAI interagiscano con dati dei clienti in conformità al GDPR, HIPAA o PCI DSS, i rischi di gestione impropria sono significativi. I compliance manager automatizzati aiutano a far rispettare i requisiti grazie a modelli preconfigurati, regole di audit e report esportabili.

Ad esempio, ai sensi del GDPR, ogni accesso ai dati personali deve essere tracciabile e limitato. Le tracce di audit, i log dei controlli di accesso e le regole di mascheramento, messi insieme, soddisfano questo requisito senza compromettere le prestazioni o le capacità degli LLM.

La guida dell’ICO su IA e protezione dei dati secondo il UK GDPR fornisce indicazioni pratiche per garantire che le operazioni degli LLM siano in linea con le normative sulla privacy.

Best Practices per la Protezione dei Dati in GenAI

Per mantenere l’integrità dei dati e ridurre i rischi nelle pipeline GenAI, le organizzazioni dovrebbero:

- Abilitare l’audit in tempo reale per tutti i database collegati all’IA

- Utilizzare il mascheramento dinamico per prevenire l’accesso diretto ai dati personali (PII)

- Eseguire scansioni automatizzate di scoperta su tutte le nuove fonti di dati

- Applicare politiche di accesso contestuali per i servizi LLM

- Automatizzare la reportistica di conformità per regioni e standard

Queste pratiche possono essere ulteriormente ampliate utilizzando la generazione di dati sintetici, il red teaming per i prompt degli LLM e dei gate di validazione per gli output dei modelli, specialmente in ambienti regolamentati come la finanza o l’assistenza sanitaria. Il Future of Privacy Forum discute molte di queste tecniche nella sua analisi delle implementazioni responsabili dell’IA.

Conclusione

Le strategie di protezione dei dati in ambienti GenAI e LLM devono affrontare i rischi unici legati all’inferenza, all’ingegneria dei prompt e all’accesso dinamico. Grazie a strumenti come l’audit in tempo reale, il mascheramento dinamico, la scoperta automatizzata e l’applicazione delle politiche, offerti da piattaforme quali DataSunrise, i team possono scalare in sicurezza l’adozione di GenAI senza compromettere i dati sensibili o la conformità normativa. Con l’evoluzione continua di GenAI, anche i meccanismi di difesa incorporati nella sua architettura devono evolversi.

Proteggi i tuoi dati con DataSunrise

Metti in sicurezza i tuoi dati su ogni livello con DataSunrise. Rileva le minacce in tempo reale con il Monitoraggio delle Attività, il Mascheramento dei Dati e il Firewall per Database. Applica la conformità dei dati, individua le informazioni sensibili e proteggi i carichi di lavoro attraverso oltre 50 integrazioni supportate per fonti dati cloud, on-premises e sistemi AI.

Inizia a proteggere oggi i tuoi dati critici

Richiedi una demo Scarica ora